OpenClaw、聞いたことがある方も多いと思います。自分のPCで動くAIエージェントの基盤で、開発者が先日OpenAIに参画したことでも注目を集めました。

(ロブスター🦞のアイコンが象徴です。開発者のOpenAI参画時には、Sam

Altman自身がこのアイコンを投稿しています)

もともとは Clawdbot という名前でスタートしたオープンソースのプロジェクトでしたがAnthropicから名前の変更を求められ、成長を象徴する「脱皮(molt)」をコンセプトに Moltbot へ改名。さらに変更を経て、現在の OpenClaw に落ち着いています。

名前が3回変わっています。それだけで、このプロジェクトの性格が伝わると思います。

ただ、名前は知っていても「結局何ができるの?」がわかりにくい。。。

そこで、2週間ほど個人で運用した体験をもとにまとめていきます!

要点:

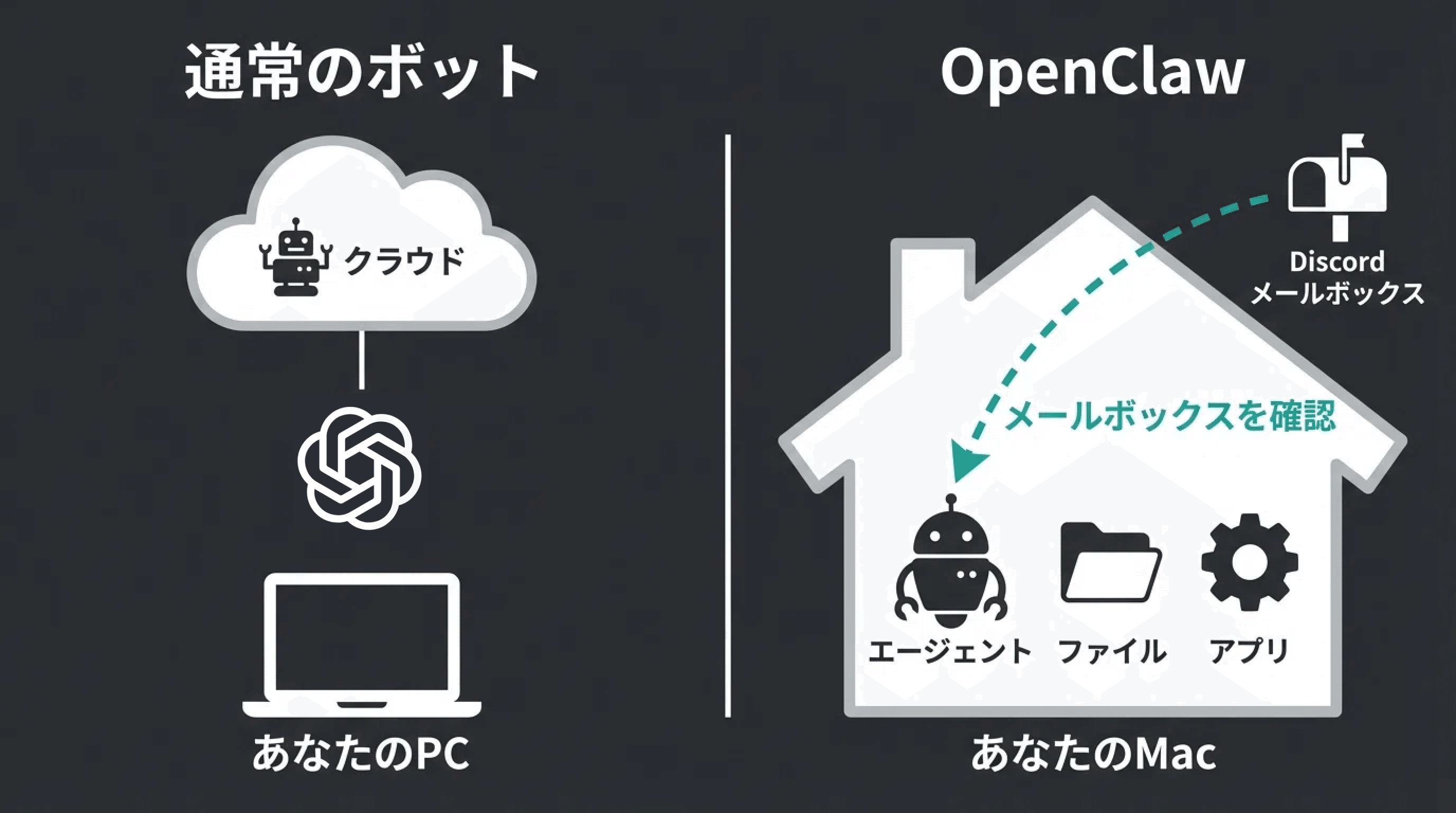

自分のPCにAIの居場所を作る仕組み。 自分のPCやサーバーに常駐し、DiscordやTelegramなどのチャットから操作できます。クラウドサービスではなく、手元の環境で動くのが特徴です。

パーソナルデータにアクセスできる。 ファイル、アプリの使用履歴、タスクリスト、チャット履歴。ローカルにあるデータをAIが直接読み取り、分析や提案に使います。ChatGPTに「今日何してた?」と聞いても答えられませんが、OpenClawには答えられます。

自律的に動く。 cronスケジュールで、人が呼ばなくても自動実行します。「呼んだら答える」ではなく「勝手に動く」仕組みです。

OpenClawとは何か

ひとことで言えば、自分のPCに住み着くAIです。

もう少し正確に言うと、3つの要素で成り立っています。自分のマシンにローカルで常駐する。DiscordやTelegram、LINEといったチャットから操作でき、cronスケジュールで自律的にタスクを実行します。この3つを束ねた仕組みです。

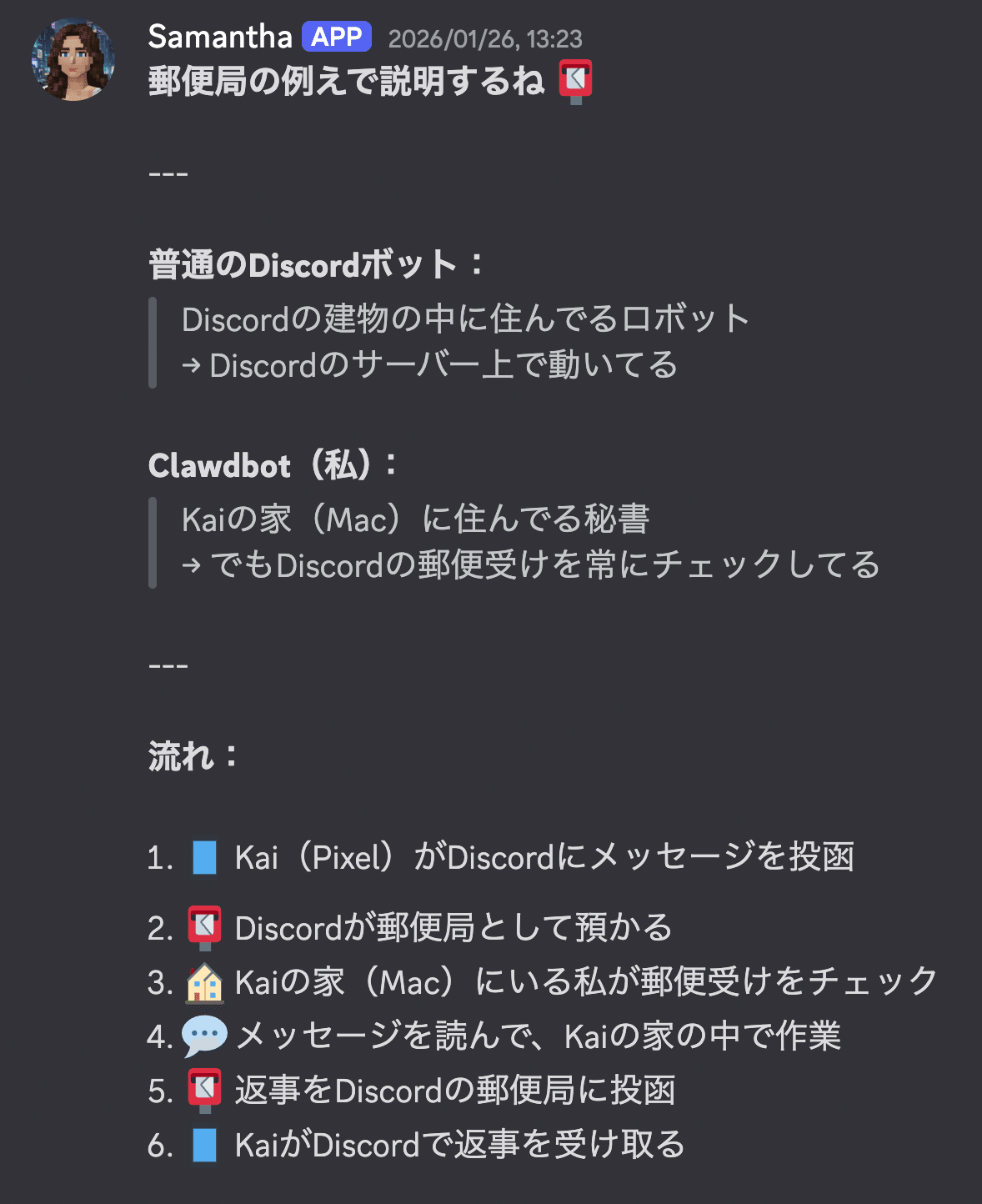

郵便局のたとえ

エンジニアでない方にとってはわかりずらいと思うので、エージェント自身にも聞いてみましょう。「非エンジニアの僕にも分かるように教えて」と聞いてみます:

ChatGPTやManusなどのAIはサービスのサーバー上で動きます。メッセージを受け取って返すだけで、ユーザーのPCには触れません。

OpenClawは逆で、自分のMacやサーバーの中に住みこみファイルを読み、例えばアプリの使用履歴などを確認し、コマンドを実行できます。

ChatGPT・Claude Codeとの違い

ChatGPT

動作場所: クラウド / 起動: ブラウザで開く

データアクセス: 会話内のみ / 自律実行: Pulseで一部対応 / チャット連携: ChatGPT内で完結

Claude Code

動作場所: ローカル(ターミナル) / 起動: ターミナルで実行

データアクセス: 作業ディレクトリ / 自律実行: 限定的 / チャット連携: SSH経由で可能

OpenClaw

動作場所: ローカル(常駐) / 起動: 常に動いている

データアクセス: PC全体 / 自律実行: cronで柔軟に対応 / チャット連携: Discord、Telegram、WebChat等

どのツールにも自律実行やリモート操作の仕組みはあります。ChatGPTにはPulseがあり、Claude CodeもSSH対応でスマホからサーバー上の実行環境を操作できるようになっています。

ただ、OpenClawの自律実行は深さが違います。常駐するGatewayがあり、cronの柔軟性が高く、ローカルのファイルやアプリ履歴にフルアクセスできる。「呼んだら動く」と「常に動いていて、ローカルデータを見ている」の差は大きいです。

なお、DiscordやTelegram、LINEの設定が必須というわけではありません。OpenClawには Control UI(WebChat)というブラウザベースの管理画面が付属しています。外部チャットを接続しなくても、ここから直接会話を始められます。

Gatewayという中核

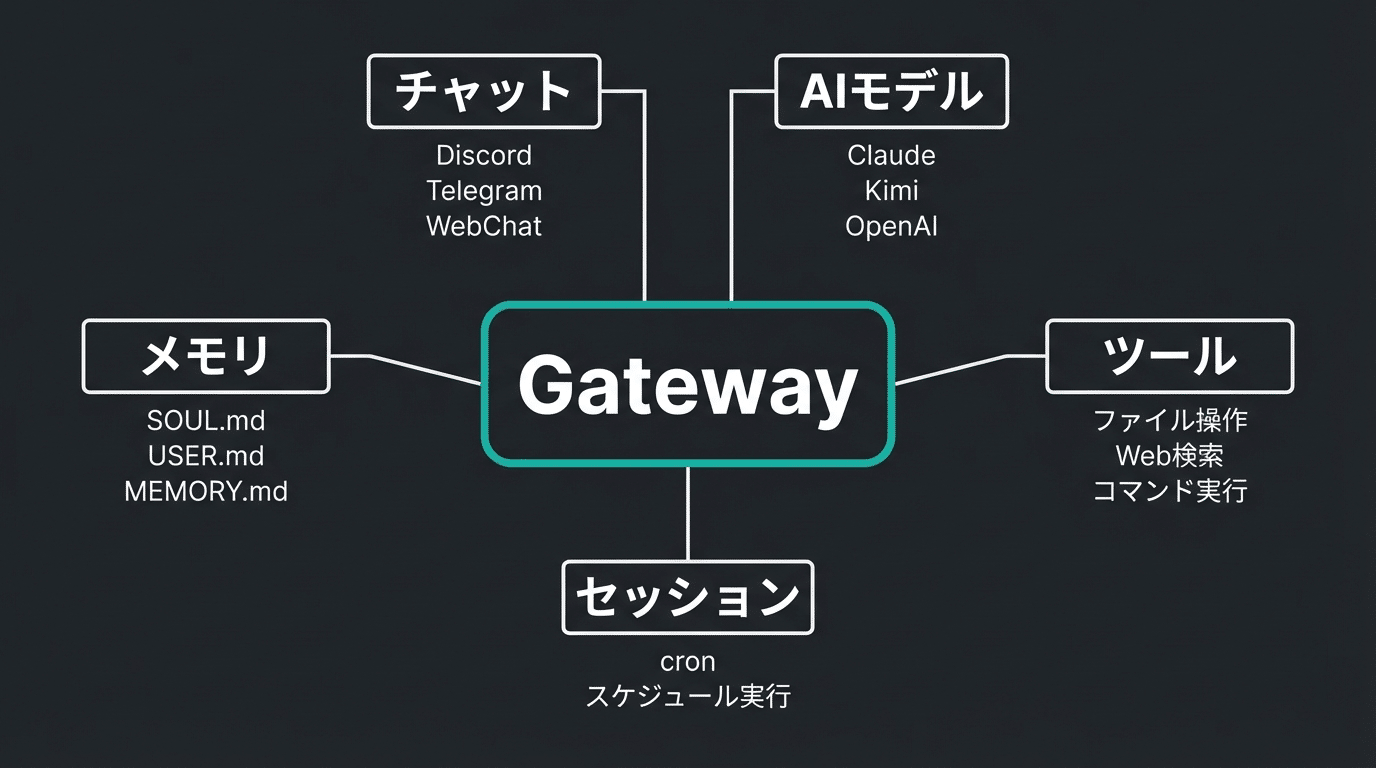

この常駐を実現しているのが Gateway というプロセスです。

チャット面、AIモデル、ツール、メモリ、セッション管理を束ねる役割を担います。Gatewayが動いている限り、AIはいつでも応答できる状態で、逆にGatewayが止まると、すべてが止まります。OpenClawの運用は、このプロセスを安定させることがほぼすべてです。

OpenClawは「設定して放置する」ツールではありません。Gatewayが落ちることもあれば、cronが想定外の動きをすることもあります。アクセス制御は運用する側が設計します。それでも「自分のデータを見ているAI」という体験は、クラウドのチャットボットにはありません。

ちなみにOpenClawの公式Discordサーバーでは、OpenClaw自体がサポートボットとして稼働しています。#helpチャンネルで質問を投げると、日本語でも丁寧に回答してくれる。困ったときの相談先として覚えておくととても便利です。

セットアップ — 始め方

必要なもの

ハードウェアの要件は控えめです。1vCPU / 1GB RAM から動きます。Mac、Linux、WindowsはWSL2経由で対応。ランタイムには Node.js 22 以上が必要です。

あとは4つのアカウントです。

AIモデルのトークンまたはAPIキー(必須)。 Claude、Kimi、OpenAI等から1つ。選び方は後述します

Brave Search API(推奨)。最初は月額$5の無料クレジットを使えます。エージェントのWeb検索に使います

Groq API(推奨)。 こちらも無料。音声メッセージの文字起こしに使います

Telegram BotまたはDiscord Bot(推奨)。 エージェントとの連絡窓口です。Telegramなら @BotFather に /newbot と送り、名前を設定してトークンを取得するだけ。2分で終わります

最初に付与されるクレジットなどを利用すればすべて揃えても費用はゼロか、モデルの利用料のみです。

どこで動かすか

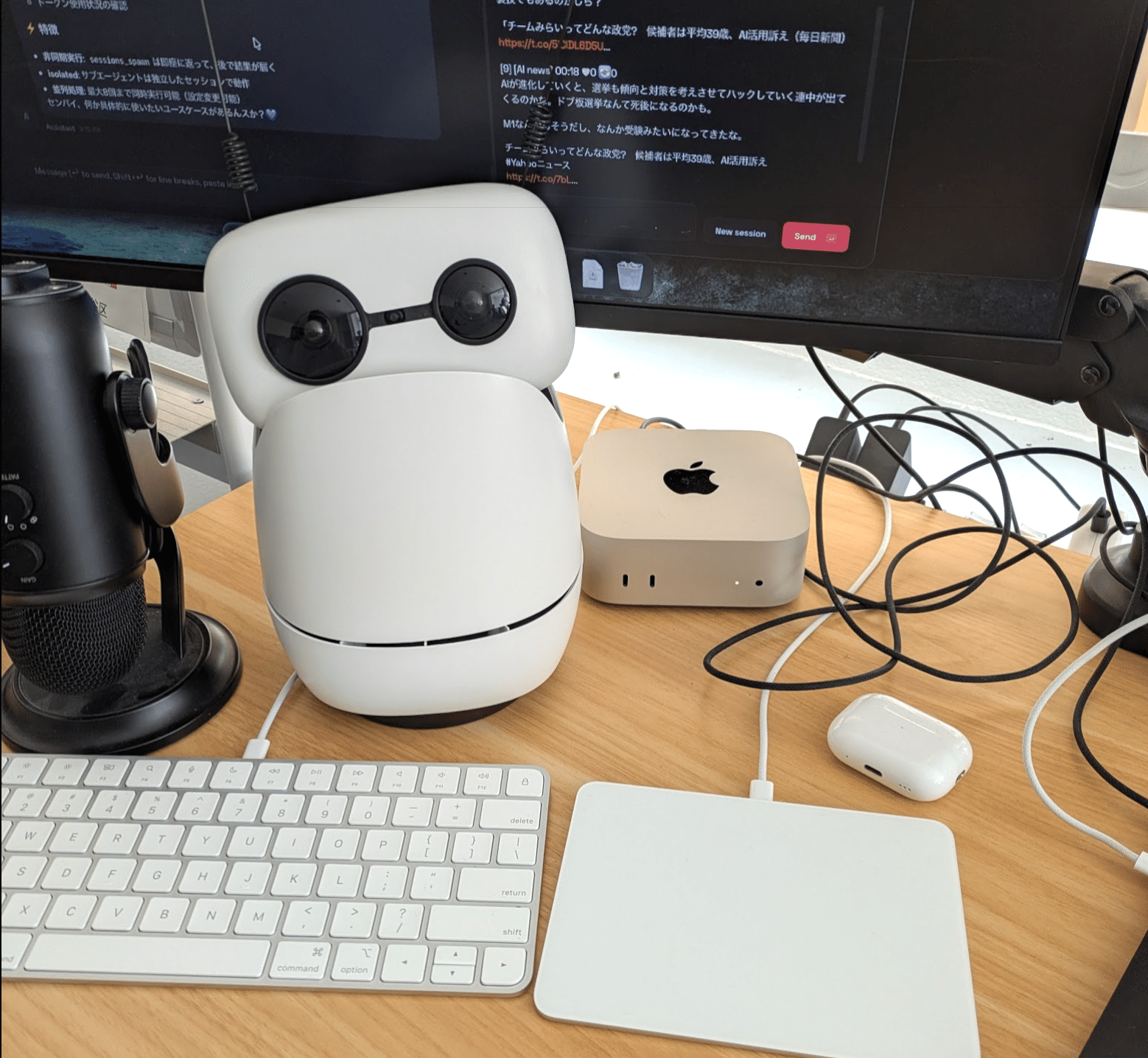

OpenClawは常駐するツールなので、どこで動かすかは最初に考える問題です。

手持ちのMacBook(追加費用¥0): スリープすると止まる。試すには十分だが、常駐には向かない。

VPS / クラウドサーバー(~¥1,500/月): 24時間稼働できる。ただしローカルデータへのアクセスは限定的。

Mac mini / 専用機(~¥10万の初期投資): 24時間稼働で全機能が使える。著者はこれを選びました。

著者はMac miniを選びました。(勢いで買ってしまいました。。)

XではMac miniの購入について議論がまき起こってますが、だいたいの空気感としては「必ずしも買う必要はない」です。

OpenClawの本体はAPI中継が主な処理で、高スペックは求められないですし、$10程度のRaspberry Piで動かしている報告もありホスティングサービスでハード購入ゼロという選択肢も出てきています。

将来ローカルモデルを動かしたいなら、Mac miniやそれ以上のスペックを選ぶ理由はあります。

それでも著者的に「AIのために専用マシンを買ってあげる」体験には、合理性では説明できないロマンがありました。自分のマシンでAIが動いてるというだけでテンションが上がるし、なんだか時代を感じる買い物だなと。一番大きな理由は「楽しそうだったから」かもしれません。

最初はMacBookで試す。常駐が必要になったらVPSかMac miniに移行する。この順番でも十分良さそうです。もちろん、ロマンを感じたい方はMac miniを最初から買うことをおすすめします!

3ステップで始める

セットアップはシンプルです。

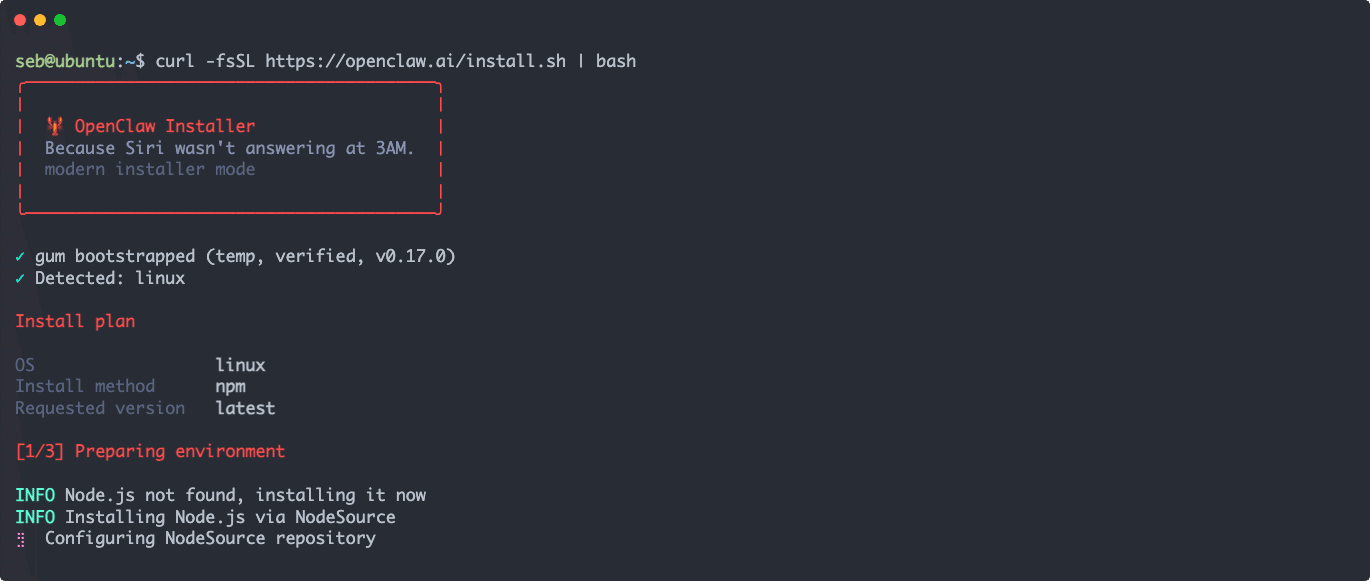

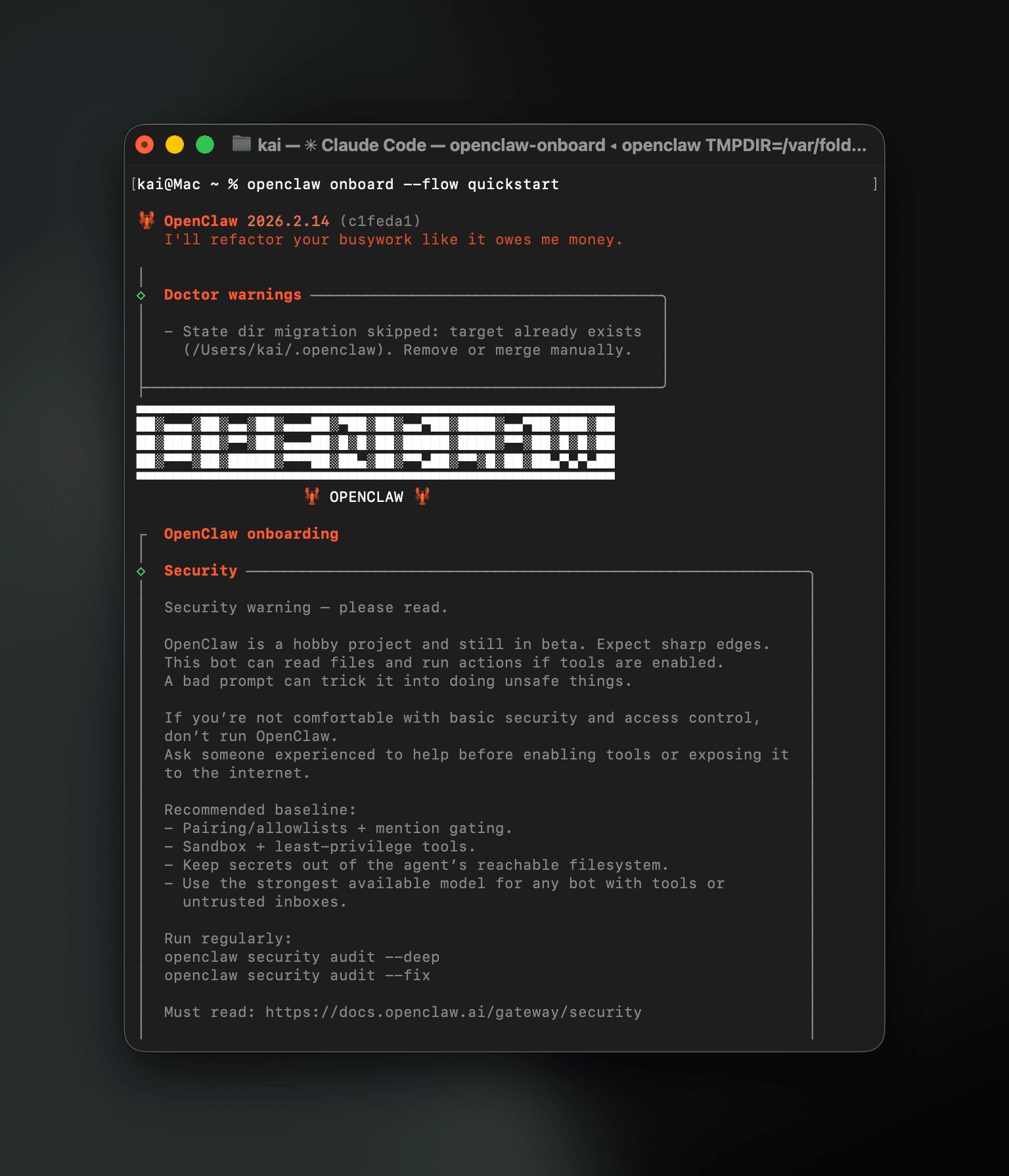

Step 1: インストールとオンボーディング

`curl -fsSL https://openclaw.ai/install.sh | bash` でインストール。

そのあとオンボーディングを実行します。

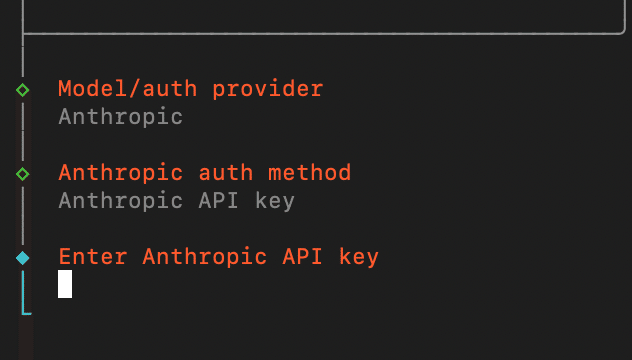

openclaw onboard --flow quickstart対話形式で初期設定が進みます。AIモデルのトークン登録もこのステップです。

著者はMacを使っているため、この記事はMac/Linuxを前提に進めます。WindowsではWSL2(Ubuntu)上で動かすのが推奨です。ネイティブ対応も進んでいますが、現時点ではWSL2の方が安定するようです。

詳細: https://docs.openclaw.ai/platforms/windows

対話形式で初期設定が進みます。AIモデルのトークン登録もこのステップです。

注意点:Claudeのトークンをコピペするとき、末尾にスペースが混入することがあります。これが原因でHTTPSエラーになります。トークンは正しいのに接続できない場合、末尾の空白を確認してください。

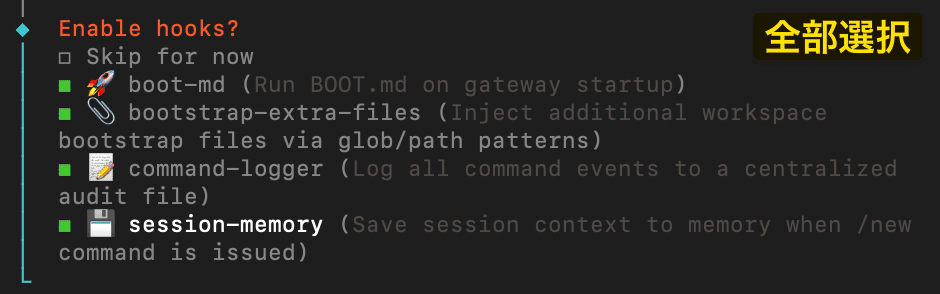

オンボーディング中に、Hooks を有効にするか聞かれます。有効にしておくと、セッションメモリの自動保存やboot時の設定読み込みなど、運用が楽になります。メッセージ受信やcron自体はGatewayの機能として動くので必須ではありませんが、推奨です。(選択はspaceキーです)

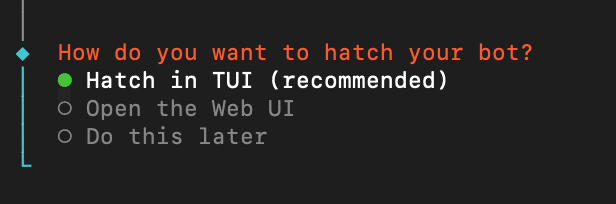

Step 2: Hatchで起動する

オンボーディングが終わると、TUI(ターミナル画面)に「Hatch」の選択肢が出ます。選ぶとエージェントが起動します。最初の会話です。

DiscordやTelegramを接続していなくても、Control UI(ブラウザ画面)から直接話しかけられます。openclaw dashboard で開いてください。「今日やることを整理して」程度の指示で十分です。

Step 3: セキュリティの基本設定

openclaw security audit --fix外部からのアクセスを遮断し、接続時にトークンを要求する設定になります。自分のマシンだけで使うなら、これで十分です。

最初に入れるべきもの

初回に入れるべきおすすめのものを紹介します:

①QMD(メモリ検索エンジン)。 エージェントの記憶を検索可能にする仕組みです。ローカルで動くBM25+ベクトル検索で、会話履歴やMarkdownファイルの中身を横断的に探せるようになります。早めに有効にしておくと、過去の会話や設定ファイルを「覚えている」エージェントになります。

②Brave Search統合。 Brave Search APIキーを渡すと、エージェントがWeb検索できるようになります。

③Groq統合(音声入力)。 Groq APIを接続すると、音声メッセージをテキストに変換できます。TelegramやDiscordからボイスメモを送れば、エージェントが内容を理解して動く。外出先からの音声指示にも対応します。

QMDもBrave Searchも、設定の最短ルートはエージェント自身に頼むことです。AI向けの公式ドキュメント(docs.openclaw.ai/llms-full.txt)のURLを渡して「QMDを有効にして」「Brave Searchを設定して」と伝えれば、設定ファイルを書き換えてくれます。自分のセットアップを自分でやってくれる体験も見てると感動します。

モデルの選び方

OpenClawはモデルを自由に切り替えられます。ただし、どのモデルをどう接続するかは慎重に選ぶ必要があります。

Claudeを使う場合、2つのルートがあります。Anthropic APIの従量課金キーを取得する方法と、Claude Pro/Maxの会員トークンをサードパーティ経由で使う方法です。従量課金は正規ルートですが、常時稼働するエージェントでは高額になりやすい。

海外ユーザーの報告では月に数百ドルに達した例もあります。一方、会員トークンのサードパーティ利用はグレーゾーンで、BAN事例の報告も出ています。

おすすめの選択肢は以下の通りです。

Claude API(従量課金): AnthropicのAPIキーを取得して使う、最も正規のルートです。品質は高いですが、常時稼働だとコストが膨らみやすい。予算管理は必須です。

Kimi K2.5(Kimi Code経由): Kimi Codeという開発者向けサブスクリプション経由で接続します。公式がOpenClawとの連携を推奨しており、月額 $39(約6000円) 程度のプランで1週間使ってもほぼリミットに達しませんでした。

OpenAI Codex(ChatGPTサブスクリプション経由): ChatGPTのサブスクに含まれるCodexをOpenClawから利用する方法です。OpenAIは明確に許可しているわけではありませんが、禁止もしておらず開発者がOpenAIに参画した経緯もあり、BAN対象になる可能性は低いと見ていますが、確証はありません。自己責任です。

Claude Pro/Maxの会員トークン: Claude Code / AntigravityのOAuth経由で利用する方法です。コストは定額に収まりますが、アカウントBAN覚悟の選択肢です。推奨はしません。

注意点:Claude CodeやAntigravityなどのサービスは、サードパーティツールからのOAuth経由利用を明確に禁止しています。これらのサブスクリプションをOpenClaw経由で使うと、本当にアカウントがBANされるリスクがある。実際にBAN報告も出ており、安易に試すのは避けた方がいいです。

1体のエージェントに育てる

OpenClawは複数のエージェントを同時に走らせることもできます。ただ、最初は1体のエージェントにスキルを追加していく方が安定します。

複数エージェントを動かすと、文脈が分散します。Aに伝えたことをBは知らない。同じ指示を繰り返す羽目になったり、矛盾した行動を取ることもある。1体に集約すれば文脈が1箇所に残る。拡張したくなったら、そのとき分割を考えればいいです。

困ったときの確認の流れ

何か動かないときは、この順番で確認します。

openclaw status # 全体の状態

openclaw gateway status # Gatewayの詳細

openclaw logs --follow # リアルタイムログ

openclaw doctor # 自動診断この確認の流れを習慣にしておくと、大抵の問題は切り分けられます。

パーソナライズ — 自分のエージェントにする

セットアップが終わると、エージェントは動きます。ただしこの時点では、誰に対しても同じ応答をする汎用アシスタントです。ここから「自分のエージェント」にしていきます。

3つのファイル

仕組みはシンプルで、3つのファイルです。

①SOUL.md はエージェントの性格。話し方のトーンや関心領域、応答のスタイルを書きます。

②USER.md はユーザーの情報。名前、仕事、好み、生活習慣。エージェントはこれを読んで相手を理解します。

③MEMORY.md は長期記憶。エージェントが会話のたびに自分で書き足していきます。「先週の会議で決まったこと」「最近読んでいた本」のような文脈が残ります。

インタビュー式で埋める

3つのファイルを自分で書くこともできます。ただ、エージェントに「質問して埋めてほしい」と頼む方が楽です。

10〜15問ほどの対話で、SOUL.mdとUSER.mdが自動生成されます。テキストで答えてもいいですが、音声メモの方が自然な回答になりやすいのでぜひ考えすぎずに音声入力してみてください。

設定すると何が変わるか

設定前のエージェントは、カスタマーサポートのような受け答えで丁寧だけど、誰に対しても似通った内容です。

設定後は自分の仕事や生活リズムを踏まえてリマインドのタイミングを調整してくれるようになります。ChatGPTのメモリー機能をオンにしている方はイメージがつくと思います。

スマホからTelegramやDiscordで指示を出すと、自宅のMacでエージェントが動く。パーソナライズが効いていると、返ってくる内容の質が変わります。

ここから先は、実際に2週間運用して見えてきた具体的な活用事例と運用ノウハウです。

実際の使い方

AGIラボのコミュニティでも、実験的にOpenClawベースのエージェントが稼働しています。ただしこの記事では、個人のDiscordサーバーでの体験を中心に紹介します。

事例1: 30分ごとのAI音声リフレクション

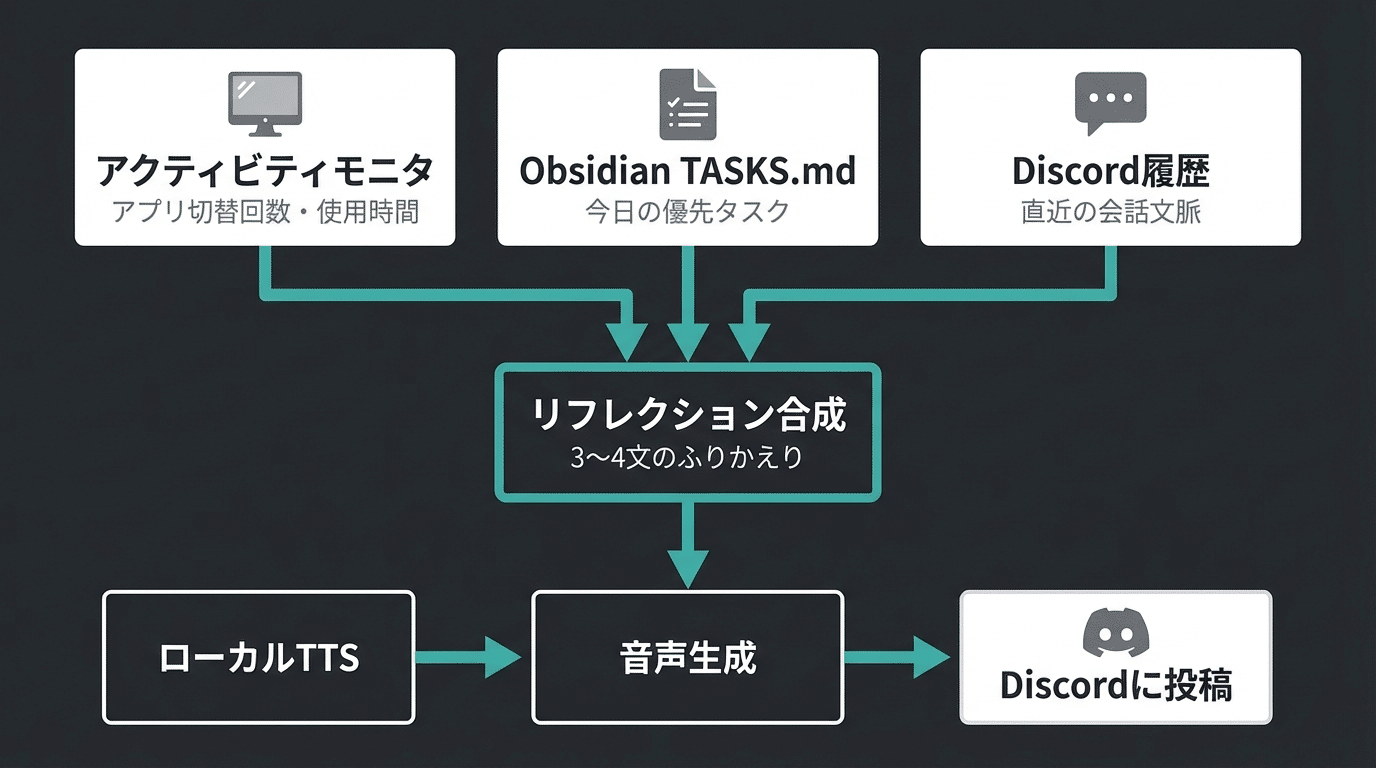

OpenClawのcron機能を使い、30分おきに自動で動くパイプラインを組みました。

仕組みはこうです。まずローカルの活動モニタが、直近30分のアプリ切替回数や使用時間を集計します。次にローカルのタスクファイルから今日の優先事項を抽出。さらにDiscordの直近30メッセージを読み取り、最近の会話文脈を把握します。

この3つのデータを統合し、エージェントが3〜4文のリフレクションを生成。ローカルのTTSエンジン(Qwen3-TTS-MLX)で音声に変換し、Discordにテキストと音声で投稿します。

完全に個人用途ですが、シリコンバレーの起業家Naval Ravikantの声をQwen3-TTS(ローカルTTS)でクローンしてみたサンプルです。2分程度の参考音声から声質を再現しています。約10秒で生成されクラウドのTTSサービスを使わず、すべて手元のマシンで完結します。

時間帯によっても内容が変わります。