今週もAI業界では多くの動きがありました。特にOpenAIが発表した新しいコーディングエージェント「Codex」は、ソフトウェア開発のあり方を大きく変えるものとして注目されています。

また、マイクロソフトによる大規模な人員削減の報道は、AI技術の進化が産業構造に及ぼす影響を改めて示す出来事となりました。

ChatGPT研究所が注目した、今週見逃せない主要なAIニュースとそのポイントをまとめてお届けします。それでは、早速見ていきましょう。

今週のハイライト

今週はAIインフラへの投資が活発で、OpenAIがUAEでのデータセンター開発支援やCoreWeaveとのクラウド契約拡大を発表。一方、マイクロソフトは人員削減でソフトウェアエンジニアが影響を受け、AIによるコード記述の進展も報じられました。Metaは主力AIモデルの開発遅延が伝えられています。

製品・サービス面では、OpenAIが新コーディングエージェント「Codex」や「GPT-4.1」などを発表。GoogleはAndroidとChromeに新AI機能を展開し、Geminiを多デバイスへ導入予定です。Anthropicも「Claude」新版を近日公開と発表しました。

開発ツール分野では、AI動画のMoonvalleyが資金調達、Windsurfが自社AIモデル、Stability AIが小型オーディオAIをリリース。リーガルテックのHarveyも大型調達を協議中です。

業界応用ではNetflixのAI活用広告や中国発のAIドクタークリニックが登場。倫理・規制面ではAIの誤情報問題や不適切発言が課題となり、米国ではファーウェイ製AIチップ規制強化や州レベルのAI規制禁止法案の動きが報じられました。

大手AI企業の製品・サービス更新

「Notion AI for Work」登場。議事録作成、横断検索、リサーチ支援をワークスペースに統合

Notionは、AIを業務に本格的に統合するオールインワンAIツールキット「Notion AI for Work」を発表しました。新機能として、会議の自動文字起こし・要約・アクションアイテム抽出を行う「AIミーティングノート」、連携アプリを含む全情報を横断検索できる「エンタープライズサーチ」、指示一つで詳細なドキュメントを自動作成する「リサーチモード」などが追加されます。これにより、情報検索や資料作成の手間を大幅に削減し、チームの生産性向上を目指します。

https://youtu.be/y-kM5kD2nm0?si=2x-1tYNZ0CnX84GQ

主な特徴とポイント:

AIミーティングノート: 会議内容を自動で文字起こし・要約し、アクションアイテムを抽出。Notionカレンダーとも連携。

エンタープライズサーチ: Notionワークスペースと連携アプリ(Slack、Microsoft、Google Workspace、GitHubなど)を横断検索し、必要な情報を即座に発見。

リサーチモード: 指示に基づき、社内外の情報源から情報を収集・整理し、共有可能な詳細ドキュメントを数分で自動作成。

最先端AIモデルへのアクセス: OpenAIやAnthropicの高性能AIモデルをNotion内で直接利用可能。

オールインワン料金体系: 複数ツールの個別契約が不要。1ユーザー月額20ドルから全てのAI機能を利用可能(ビジネスプランの無料トライアルあり)。

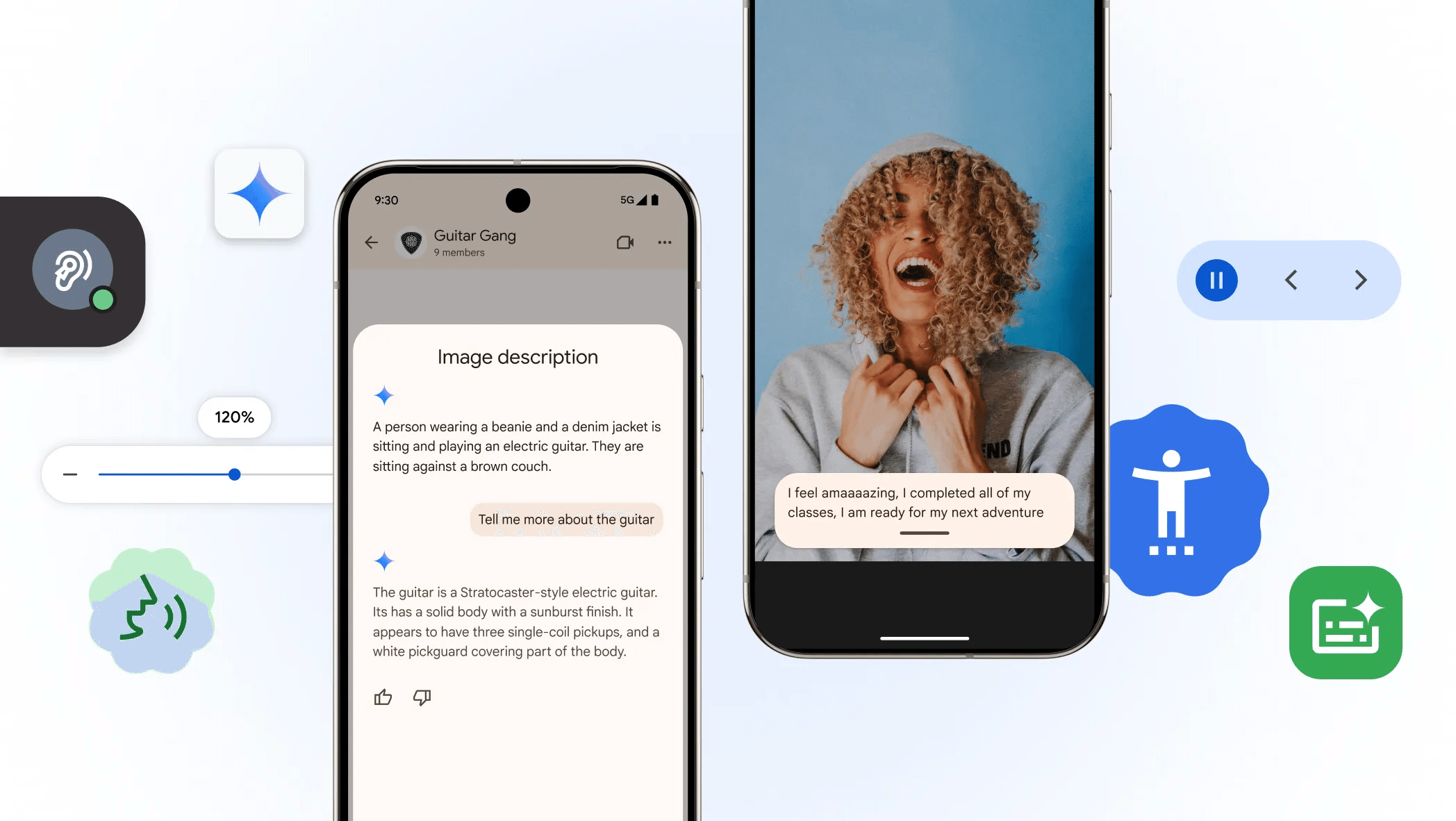

Google、AndroidとChromeに新たなAI・アクセシビリティ機能を展開

Googleは、AndroidおよびChrome向けに新しいAIとアクセシビリティ機能を導入すると発表しました。特に、AndroidのスクリーンリーダーTalkBackでは、画像や画面上の内容についてGeminiに質問できるようになり、より詳細な情報を得られます。また、リアルタイム字幕機能Expressive Captionsも更新され、言葉の抑揚や特定の音の表現が豊かになります。

主な特徴とポイント:

TalkBackとGemini連携強化: 画像の内容説明に加え、画像や画面全体に関する質問と回答が可能に。

Expressive Captions更新: AIによるリアルタイム字幕機能で、言葉の長音表現や口笛などの音ラベルを追加。

ChromeのPDFアクセシビリティ向上: スキャンされたPDFでもOCR機能によりテキスト操作やスクリーンリーダー読み上げが可能に。

Chromeのページズーム改善 (Android): テキストサイズを拡大してもウェブページのレイアウトが崩れにくく、サイト毎の設定も可能。

OpenAI、新AIコーディングエージェント「Codex」を発表。タスク依頼型で自律処理

OpenAIが2025年5月17日にクラウドベースのAIソフトウェアエンジニアリングエージェント「Codex」を発表しました。新AIモデル「codex-1」を搭載し、機能開発やバグ修正などのタスクを自律的かつ並行して処理します。インターフェースはチャット型ではなく「タスク依頼型」で、具体的なコーディングタスクを依頼し成果物を受け取る形式です。

https://agi-labo.com/articles/nf7a356a356f9

主な特徴とポイント:

新モデル「codex-1」搭載: OpenAI o3をソフトウェアエンジニアリングに特化して最適化し、人間のコーディングスタイルやPRの慣習を模倣。

非同期・並列タスク処理: 複数のコーディングタスクを同時にバックグラウンドで実行可能。タスクキューで進捗を管理。

タスク依頼型のインターフェース: ChatGPTのような継続的なチャットではなく、明確なタスク指示に特化。

AGENTS.mdによるカスタマイズ: リポジトリごとにAGENTS.mdファイルでエージェントの動作を詳細に制御。

シームレスなGitHub連携: タスク完了後、生成されたコード差分を元にGitHubプルリクエストを容易に作成。

Anthropic、思考とツール使用を繰り返す次世代AIモデル「Claude Sonnet」「Claude Opus」新バージョンを近日公開へ

Anthropicが、主力AIモデル「Claude Sonnet」と「Claude Opus」の新バージョンを数週間以内にリリース予定とThe Informationが報じています。これらの新モデルは、問題解決のために「思考(複数の解決策を探る)」と「ツール使用(外部ツールやデータベースの活用)」を柔軟に行き来し、自己修正する能力が特徴です。これにより、より複雑なタスクを少ない人間の介入で処理できるようになることが期待されています。

主な特徴とポイント:

思考とツール使用の反復: 問題解決中に行き詰まった場合、「思考」モードに戻り戦略を練り直し、自己修正。

複雑タスクの自律処理: より少ない指示や修正で、市場調査やコード生成・テストなどの複雑なタスクを実行可能。

ソフトウェアエンジニアリングへの応用: 高度な指示(例:「アプリを高速化」)で自律的に様々な方法を試行。

テスト時間計算の重視: 以前のモデルに対する賛否両論にもかかわらず、推論モデルの「テスト時間計算」アプローチを継続。

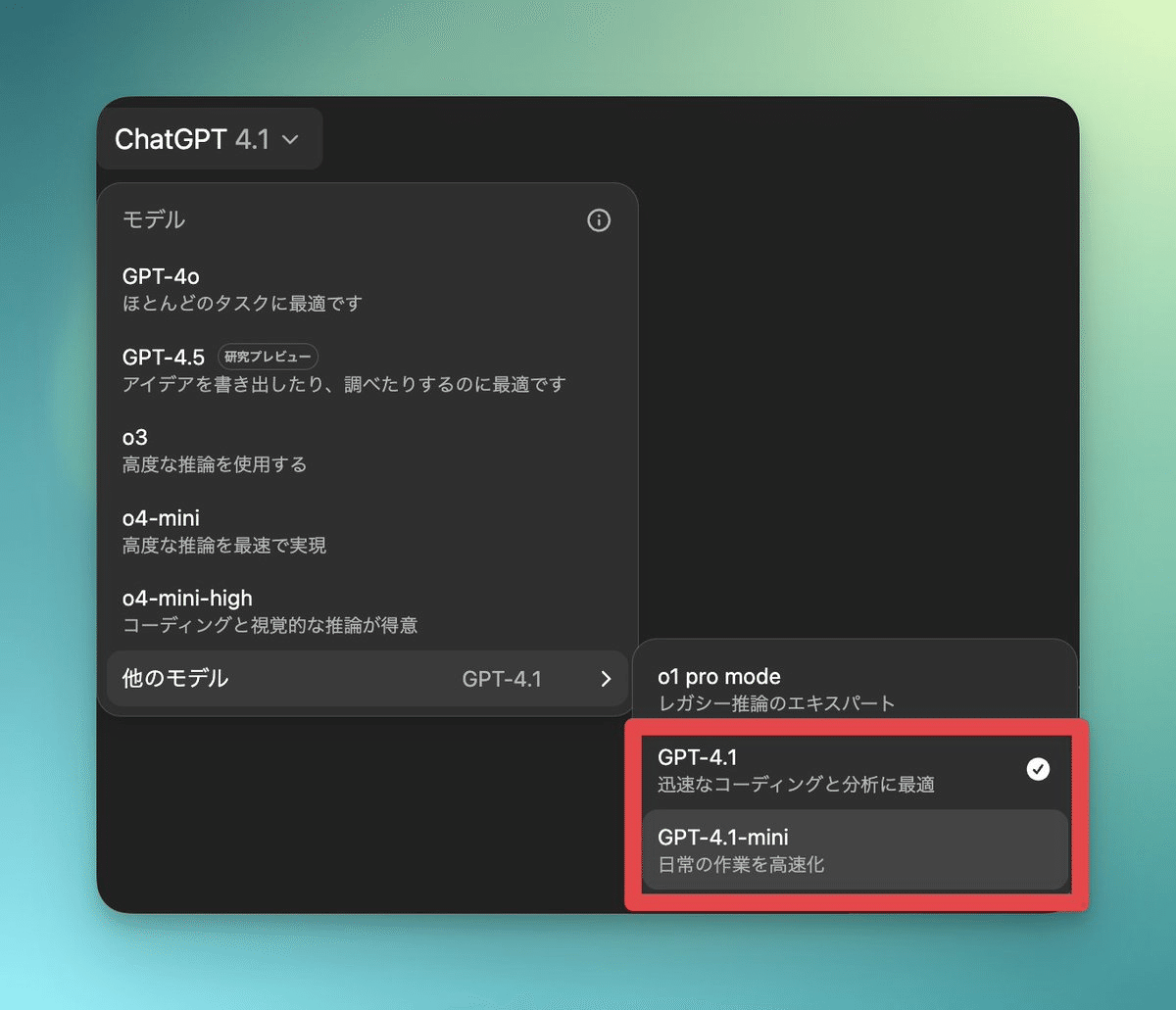

OpenAI、コーディング特化モデル「GPT-4.1」と「GPT-4.1 mini」をChatGPTで提供開始

OpenAIは、コーディングタスクと指示追従に優れたAIモデル「GPT-4.1」および「GPT-4.1 mini」をChatGPT内で提供開始しました。これにより、ソフトウェアエンジニアはChatGPTを使ってより効率的にコード作成やデバッグを行えるようになります。GPT-4.1はChatGPT Plus、Pro、Teamユーザー向けに、GPT-4.1 miniは無料ユーザーを含む全ユーザーに提供されます。

主な特徴とポイント:

コーディング特化モデル: GPT-4.1はGPT-4oと比較してコーディングと指示追従に優れ、oシリーズより高速。

提供対象: GPT-4.1はPlus/Pro/Teamユーザー、GPT-4.1 miniは全ユーザーがChatGPTで利用可能に。

安全性情報公開: OpenAIはAIモデルの安全性評価結果をより頻繁に公開する方針を発表し、Safety Evaluations Hubを開設。

ChatGPTでのトークン長: リークされた情報からはChatGPT (Pro)でのGPT-4.1 miniの最大トークン長は129,024、GPT-4.1は34,815トークンとみられています。

https://twitter.com/ctgptlb/status/1922776717342425355

Salesforce、AIツールの新たな従量課金モデルと柔軟な支払いオプションを発表

Salesforceが、AI製品向けに新たな料金モデルを導入し、一部のAIエージェント利用時に1アクションあたり約10セントを課金すると発表しました。また、顧客が従来のソフトウェアサブスクリプションからAIエージェント製品へ契約支出を再配分できる柔軟な支払いオプションも提供します。これにより、企業は従業員とAIエージェント間の支出をより柔軟に調整できるようになります。

主な特徴とポイント:

アクションベース課金: 一部AIエージェント利用に対し、1アクション約10セントの新料金モデル導入。

柔軟な支出再配分: 従来のアプリ契約額をAIエージェント製品に振り替え可能に。

既存料金モデルも維持: 顧客サービスなど一部用途では、従来のAIエージェント1会話あたり2ドルの料金モデルも継続。

AI収益化への期待: AI製品の収益化が投資家から求められる中、新たな支払い方法で顧客獲得を目指す。

Metaのスマートグラス、AIが視覚情報をより詳細に説明する新機能。視覚障碍者支援も強化

Metaは、Ray-Ban MetaスマートグラスのカメラとMeta AIを活用し、視覚障碍者や低視力者を支援する2つの新機能を発表しました。米国とカナダで提供される新機能では、ユーザーが周囲の環境について尋ねると、Meta AIがより詳細な説明を提供します。また、「Call a Volunteer」機能も提供国を拡大し、ボランティアがリアルタイムで視覚情報を伝え、日常生活を支援します。

主な特徴とポイント:

詳細な視覚情報説明: Meta AIがスマートグラスのカメラ映像に基づき、周囲の状況をより詳しく説明(米・カナダで提供開始)。

「Call a Volunteer」機能拡大: Be My Eyesとの連携で、ボランティアが視覚情報を遠隔支援する機能をMeta AIサポート全18カ国に展開予定。

アクセシビリティ向上: グローバル・アクセシビリティ・アウェアネス・デーに合わせて発表された、視覚障碍者支援機能。

利用方法: 詳細応答機能はMeta AIアプリの設定から有効化。ボランティア呼び出しは音声コマンド「Hey Meta, Be My Eyes」で起動。

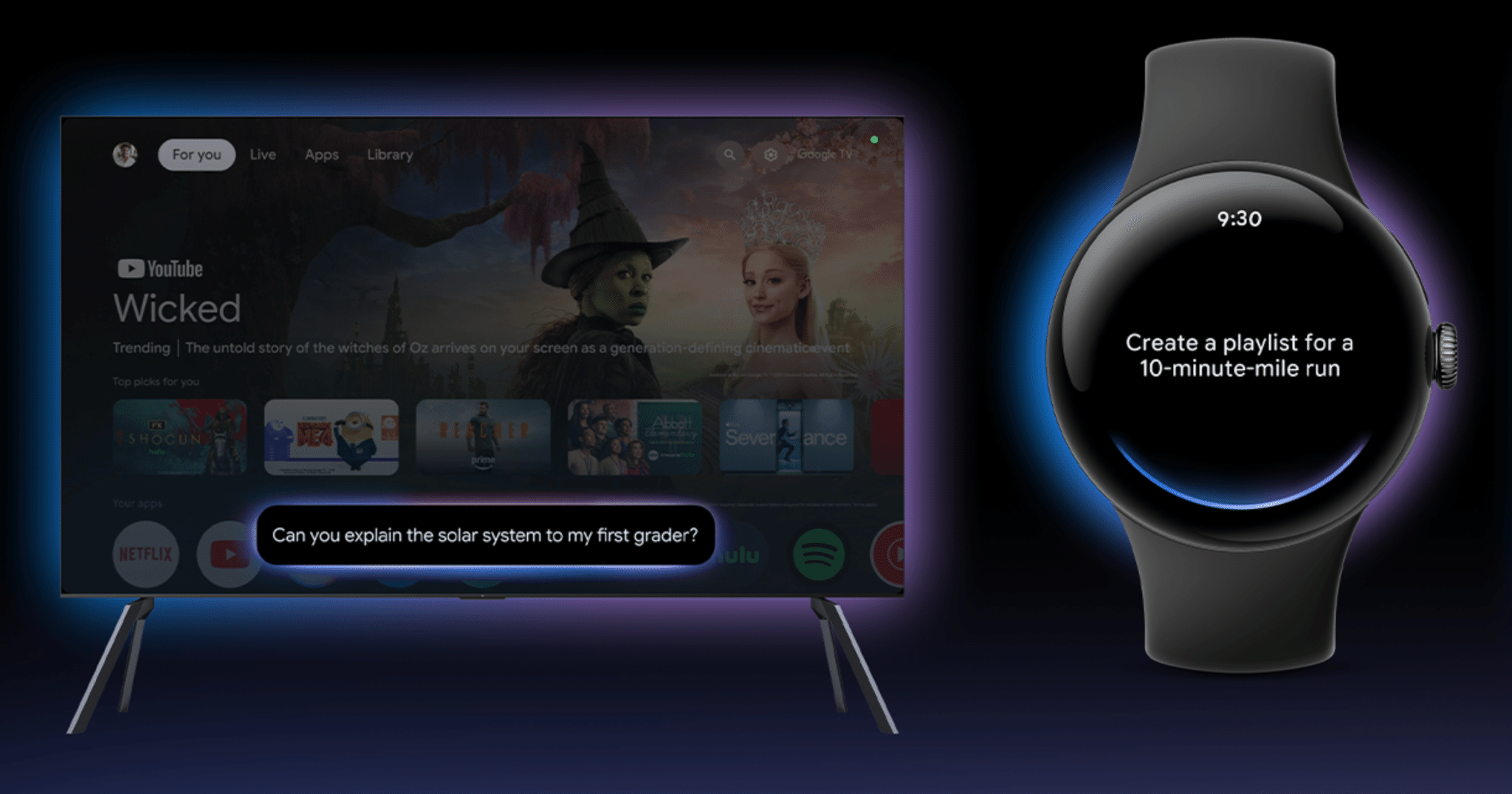

Google、AIアシスタント「Gemini」をWear OSスマートウォッチとGoogle TVに導入へ

Googleは、AIアシスタント「Gemini」をWear OS搭載スマートウォッチおよびGoogle TVにも導入すると発表しました。これにより、ユーザーはスマートフォン以外のデバイスでもGeminiの機能を利用できるようになります。スマートウォッチではリマインダー設定やアプリ連携、Google TVではパーソナライズされたコンテンツ推薦や質問応答などが可能になる予定です。

主な特徴とポイント:

Wear OS対応: 数ヶ月以内にGeminiがWear OSスマートウォッチで利用可能に。ハンズフリー操作やアプリ連携を強化。

Google TV対応: 年内にGeminiがGoogle TVに登場。コンテンツ推薦や質問応答、教育ビデオ検索などが可能。

Android XRにも統合: 新しいXRプラットフォームAndroid XRにもGeminiを統合し、没入型体験での活用を目指す。

Android Auto対応: 数ヶ月以内にAndroid AutoにもGeminiを導入。ルート検索、メッセージ要約、ニュース再生などを支援。