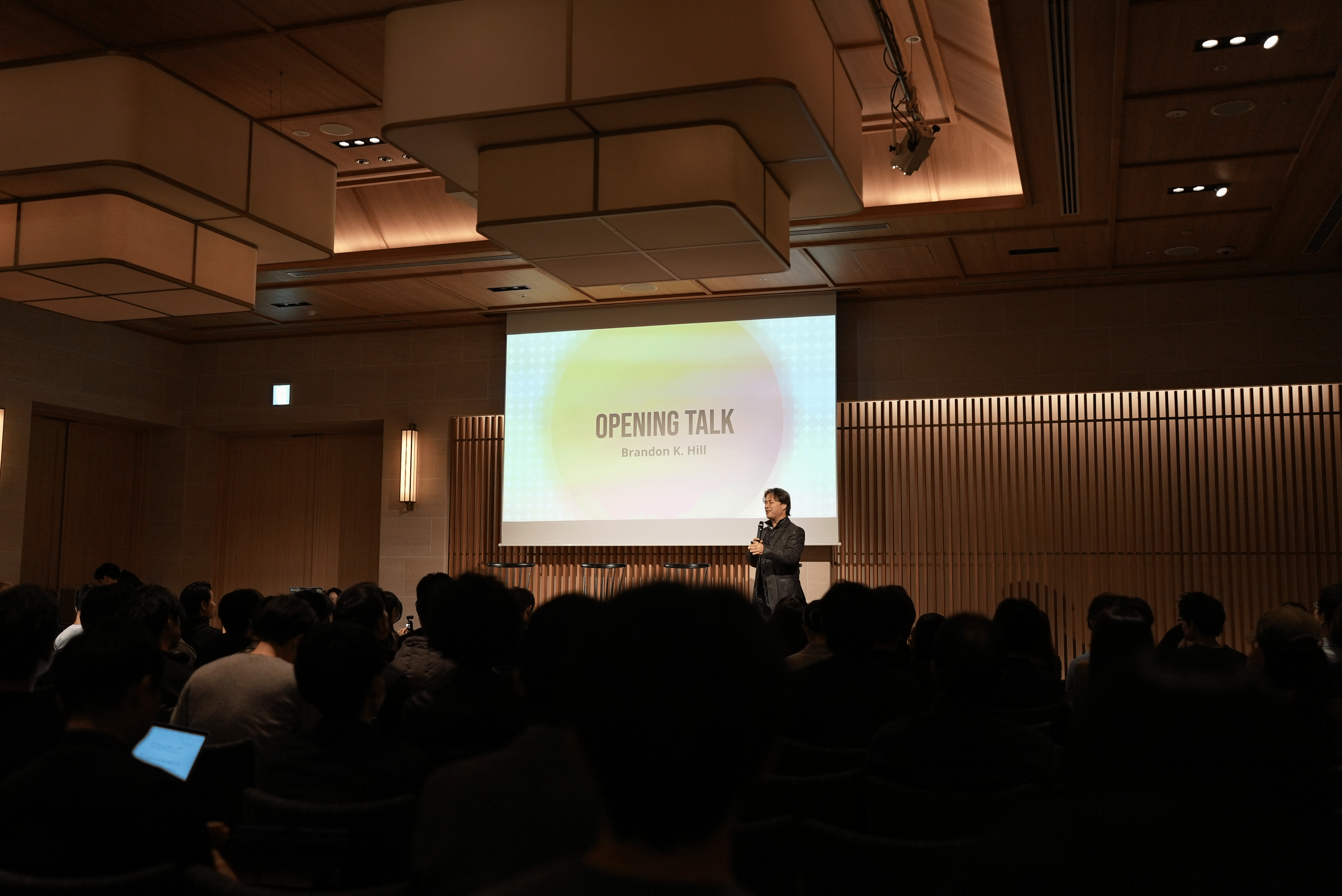

2026年2月27日、渋谷・TRUNKにて The AI Collective Tokyo のイベントが開催されました。タイトルは「AIが"聞き"、AIが"動く"時代へ — Manus from Meta & Aqua Voiceが拓く次世代エージェント体験」。登録者数は400名越え。

この日の主役は、AIエージェントの Manus と音声入力プロダクトの Aqua Voice です。

The AI Collective Tokyoとは

The AI Collective は世界最大級のAIコミュニティで、各都市にチャプターを持ち定期的にイベントを開催しています。東京チャプターのRegional Director(日本代表)を務めるのは、btrax Founder & CEOの Brandon K. Hill さん(@BrandonKHill)。

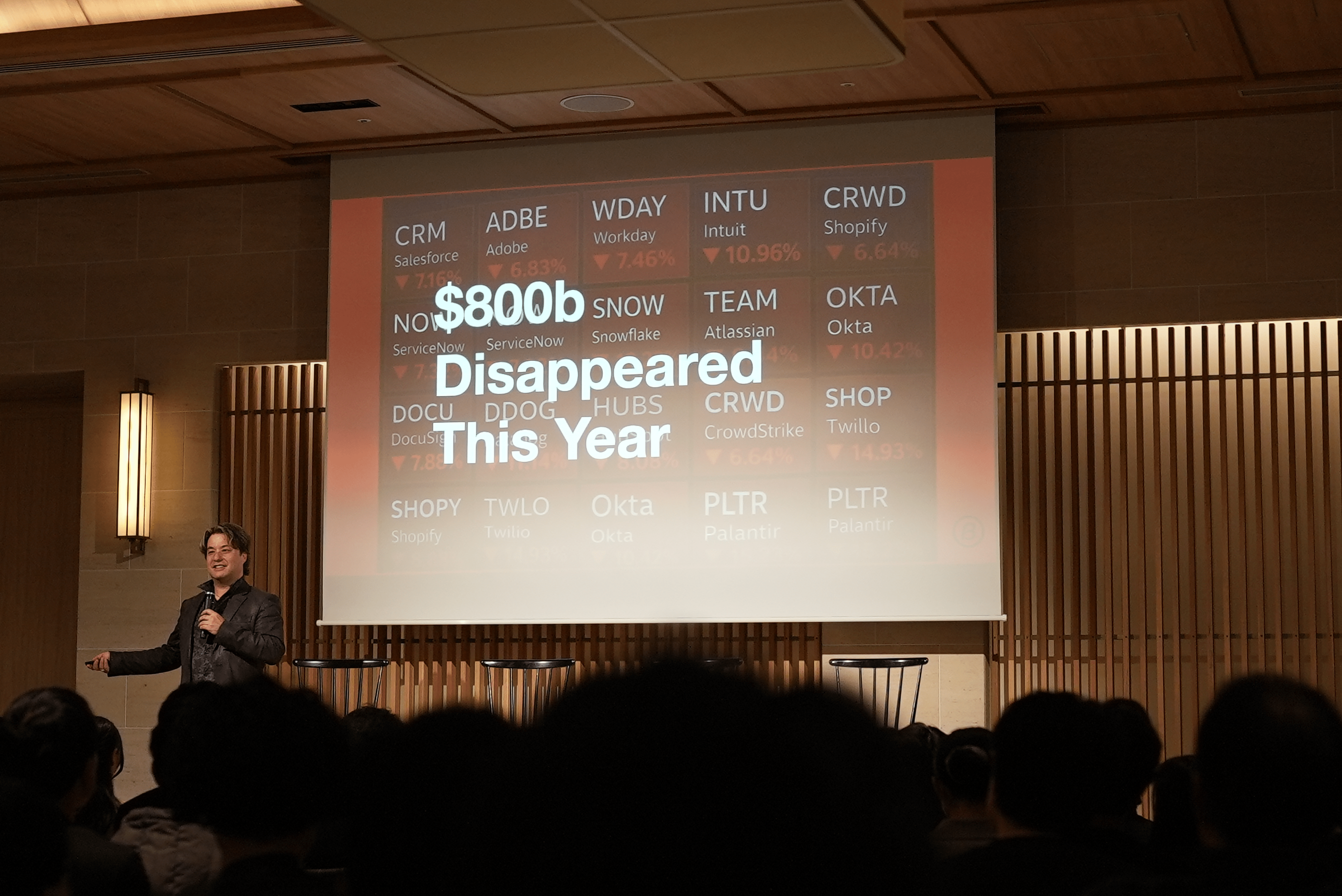

オープニングでは、サンフランシスコのAIシーンの現状が紹介されました。街中にAI企業の広告があふれ、毎日3〜4件のAIイベントが開催され、仕事終わりに駆けつけて学ぶ人たちで溢れているとのこと。

続いて、Manus from MetaのAshleyさん、Aqua VoiceのFinn Brownさんのセッション。

Manus:「AIに手を与える」

Manus from Metaの Ashley Shu Harayama さん(@Ashley_ManusAI)のセッションでは、Manusの現在地と今後の方向性が語られました。

Manusは自社発表によればローンチ8カ月でARR(年間経常収益)1億ドルに到達したスタートアップ。2025年12月29日にMetaによる買収が発表され、現在は「Manus from Meta」としてシンガポール拠点で自社サービスの提供を継続しています。

「実世界のAI自動化率」のベンチマークでもトップを記録しており、最新のManus 1.6ではモバイルアプリの開発に対応し、テスト配布に向けた機能も拡充しています。

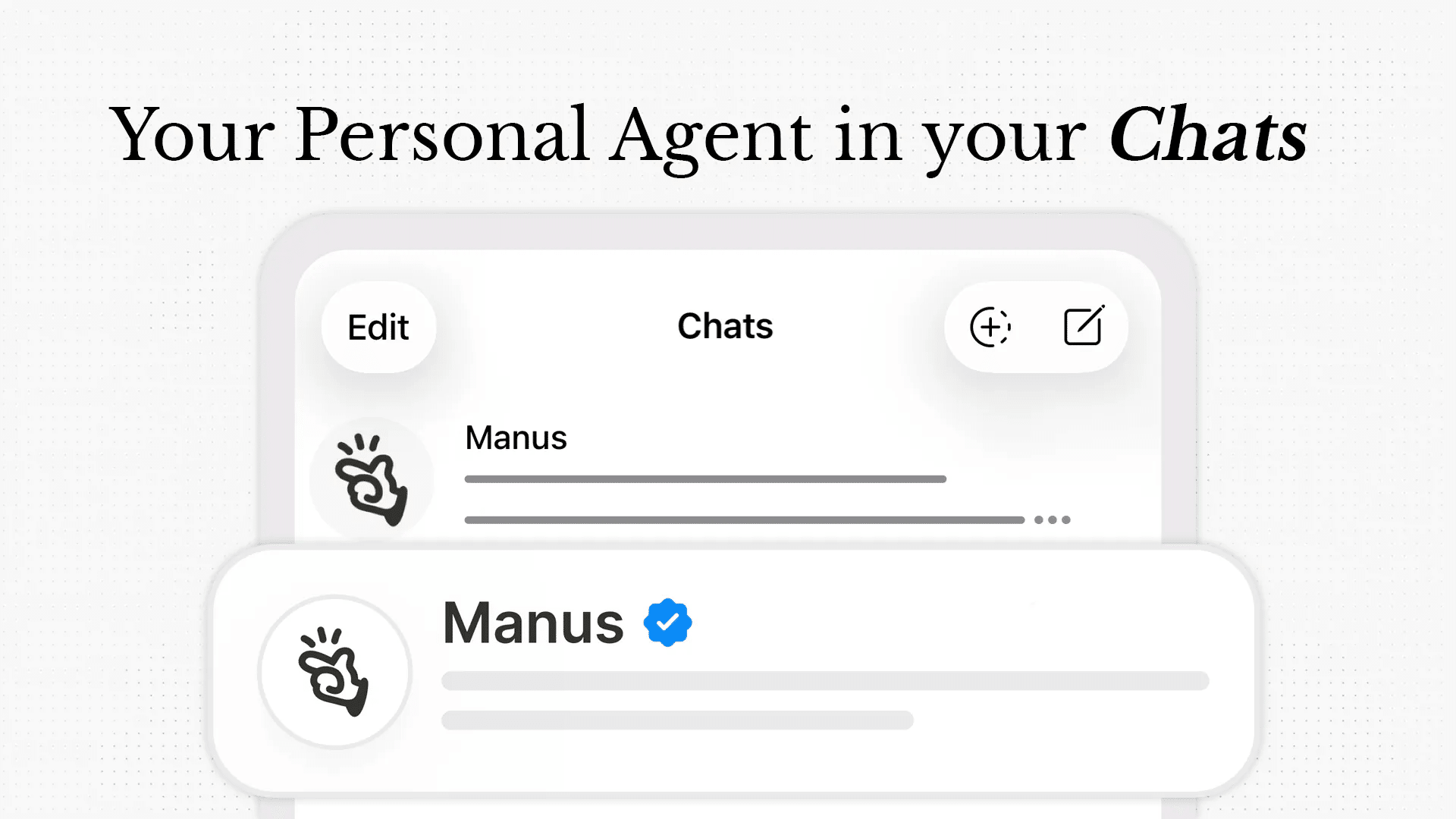

Ashleyさんが特に時間を割いて紹介したのは、2026年2月にリリースされた Manus Agents です。Telegram内からManusの主要機能を呼び出せる仕組みで、QRコードをスキャンするだけで連携が完了します。Ashleyさんによれば、今後はWhatsApp、Messenger、LINEにも対応予定とのこと。

OpenClawのようなローカルPCにインストールするタイプのAIエージェントはセットアップの手間やセキュリティリスクがあるのに対し、Manus Agentsは普段使いのメッセージアプリからそのまま使える点が強みです。

いちいちAIのアプリを開かなくなる。ユーザーの方に1番近いレイヤーから指示を出して、裏でAIが全部動いて成果物を返してくれる。(Ashleyさん)

ちなみにManusのロゴは「指をパチンと鳴らした後の手」をモチーフにしており、「AIに手を与える」という設計思想がロゴにも反映されています。

Aqua Voice:「AIに耳を与える」

続いてAqua VoiceのCEO、Finn Brown さん(@finnatsea)が登壇。セッションは英語で進行し、リアルタイム翻訳ツールが活用されていました。

Finnさんにはディスレクシアがあり、子どもの頃からDragon DictationやApple音声入力を使ってきた経験を持っています。

― ディスレクシア:知的能力とは無関係に、文字の読み書きに困難が生じる学習上の特性。英語圏では人口の約10〜15%が該当するとされる

従来の音声入力は精度が低く、送るつもりのなかったメッセージを送ってしまうような不自然さがあったと話していました。

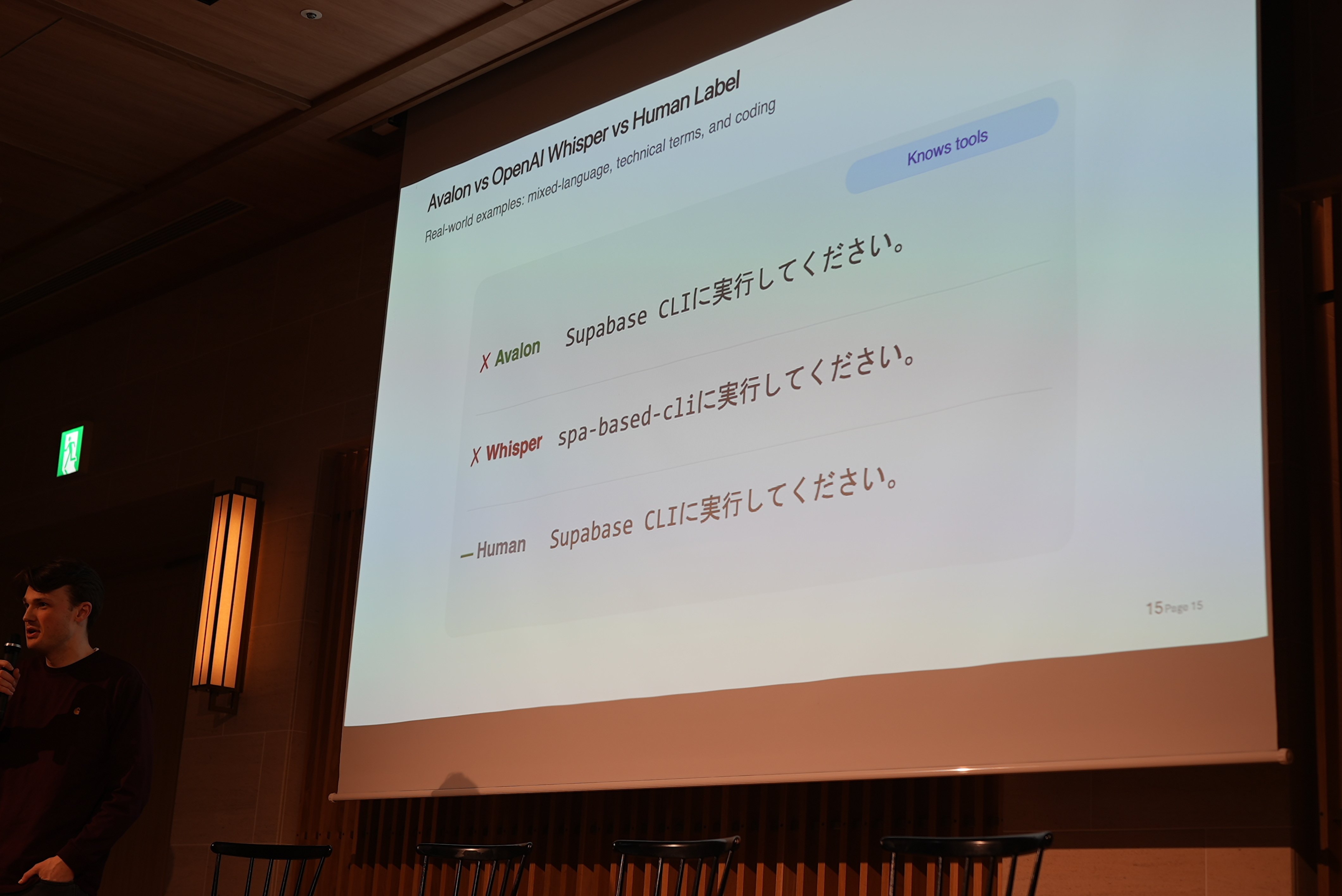

この日発表されたのは、新モデル Avalon 1.5 です。主なアップデートは以下の通りです。

当日の発表では、日本語を含む6言語対応の初の多言語モデル

技術用語やコードの文脈を理解する精度の向上

コードスイッチング ― 1つの発話内で言語を切り替えても正しく認識する技術 ―

自動言語検出の改善

iOSアプリのデモ

ベンチマーク上の数値だけでなく、「実際の開発ワークフローで使えるか」にフォーカスしている点が特徴的でした。既存のベンチマークは古いデータで構成されているため、技術用語やコード文脈での精度を重視して開発を進めているとのことです。

セッションの終盤、Finnさんはプロメテウスの神話を引き合いに出しました。

What if the AI is Prometheus? What can it give to us? ... You still have your voice. There is no cleaner way to reflect your internal state.(Finnさん)

訳:もしAIがプロメテウスだとしたら、それは私たちに何をもたらしてくれるのでしょうか。……あなたにはまだ「声」があります。自分の内面を映し出すのに、これほど純粋な方法はありません。

― プロメテウス:ギリシャ神話で神々から火を盗み、人間に与えた存在。火は文明の始まりであり、人間が自らの力で世界を変える手段でもあった ― Claudeによる解説

パネルディスカッション:実践者が語るリアルな使い方

後半は、Michikusa CEO usutaku さん(@usutaku_channel)、デジライズ代表 チャエン さん(@masahirochaen)、AlphaByte CEO Taishi さん(@taishiyade)の3名が登壇し、Brandon K. Hillさんがモデレーターを務めるパネルディスカッションが行われました。

Manusの使い方

Taishiさんは、Manusの用途を明確に切り分けていると話していました。

Manusを使う時はめっちゃ巨大なリサーチをさせるんですよ。大体1日中やってます。(Taishiさん)

チャエンさんは、資料生成と動画制作のワークフローでManusを活用しているとのこと。台本作成、画像生成、動画化、字幕付け、音声生成までを1つのチャットで完結させられる点を評価していました。

usutakuさんからは、ChatGPTとManusの違いについてこんな説明がありました。ChatGPTは指示したタスクだけを実行するのに対し、Manusは複数の情報源を横断して調査できる。YouTube、ネット記事、SNSなど複数の場所に「寄る」ことができるのがエージェントならではの強みだとのことです。

Aqua Voiceの使い方

音声入力については、3名とも日常的に使っていることが話題になりました。

チャエンさんは「全部音声入力しかしないぐらいいい。ほとんどタイピングほぼしない」と話し、OpenClawの開発者であるPeterさん(@steipete)も音声入力だけで作業し、声が出なくなったというエピソードを紹介していました。

usutakuさんは、CursorやClaude Codeでの開発における音声入力の価値について語りました。

Aqua Voiceなしで入力しろって言われたら、普通に面倒になりまくって無理なんですよ。(usutakuさん)

1回のプロンプトで5行程度の指示をAqua Voiceで入力し、返ってきた結果をさらに音声で修正する。同じことを何度言っても、言い間違えても、ある程度理解してくれるので、「とにかく量を話す」のがコツだと。

もう1つ興味深かったのは、DM返信への活用です。usutakuさんはフォロワーからのメッセージに対し、タイピングだとつい簡潔に済ませてしまうところを、音声入力で丁寧に返せるようになったと話していました。

僕の言葉で伝えたいなと思ってるけどタイピングが難しい。それに関してはAIにやってもらうけど、ちゃんと伝えるのは僕。(usutakuさん)

働き方の変化

パネル全体を通じて、働き方そのものの変化も話題に上がりました。

Brandonさんは、サンフランシスコではAirPodsをつけて歩きながらAIに指示を出す人がすでに日常的に見られると紹介。

Taishiさんも「リビングから離れることがない。子どもと遊びながらエージェントに指示を出している」と、場所や時間に縛られない働き方を実践していることを話していました。

机の前にずっと8時間いること自体が、もうちょっと時代遅れになるかもしれない。(Brandonさん)

Q&Aで出てきた問い

あるエンジニア採用の会社を経営する方からは「エンジニアの需要は今後もあるのか」という問いが出ました。

これに対し、チャエンさんは「採用ではコミュニケーション力しか見ていない。技術面の差がだいぶなくなってきている」と回答。usutakuさんも同様に、AI活用スキルを備えた人材の方が価値が高くなりつつあるという見方を示していました。

視覚に障害のある参加者からは、AIツールがアクセシビリティにどう貢献できるかという問いがありました。usutakuさんは「手が使えなくてタイピングができない人でも、声で入力できること自体がイノベーション」と応じ、チャエンさんはMeta Ray-BanグラスとAIを連携させて視覚情報を音声で受け取る仕組みを実際に構築していると紹介していました。

企業内でのAI導入については、usutakuさんからこんな見方が共有されました。

結局、今のAIの進化についていくのって義務感じゃできない。本当に好きだからやってるしかない。好きになるためには、自分自身が1回でもAIで「やった」と思える小さな成功体験が必要。(usutakuさん)

終盤には、AIが自発的に動くようになった先で人間の役割は何になるのか、という問いも投げかけられました。usutakuさんの回答は「最終的に残るのは思想。AIが何でもやれるようになっても、どこに向かうかを決めるのは人間」というものでした。

まとめ

ManusとAqua Voiceは異なるプロダクトですが、共通しているのは「AIと人間の接点を自然にする」という方向性です。Manusは「AIに手を与える」、Aqua Voiceは「AIに耳を与える」。

AIの性能そのものよりも、人間がAIにどうつながるかが問われるフェーズに入りつつあることを感じるイベントでした。

イベント情報

イベント名:AIが"聞き"、AIが"動く"時代へ — Manus from Meta & Aqua Voiceが拓く次世代エージェント体験

主催:The AI Collective Tokyo

日時:2026年2月27日(金)17:30〜20:20

会場:TRUNK(HOTEL)(東京都渋谷区神宮前5-31)