はじめに

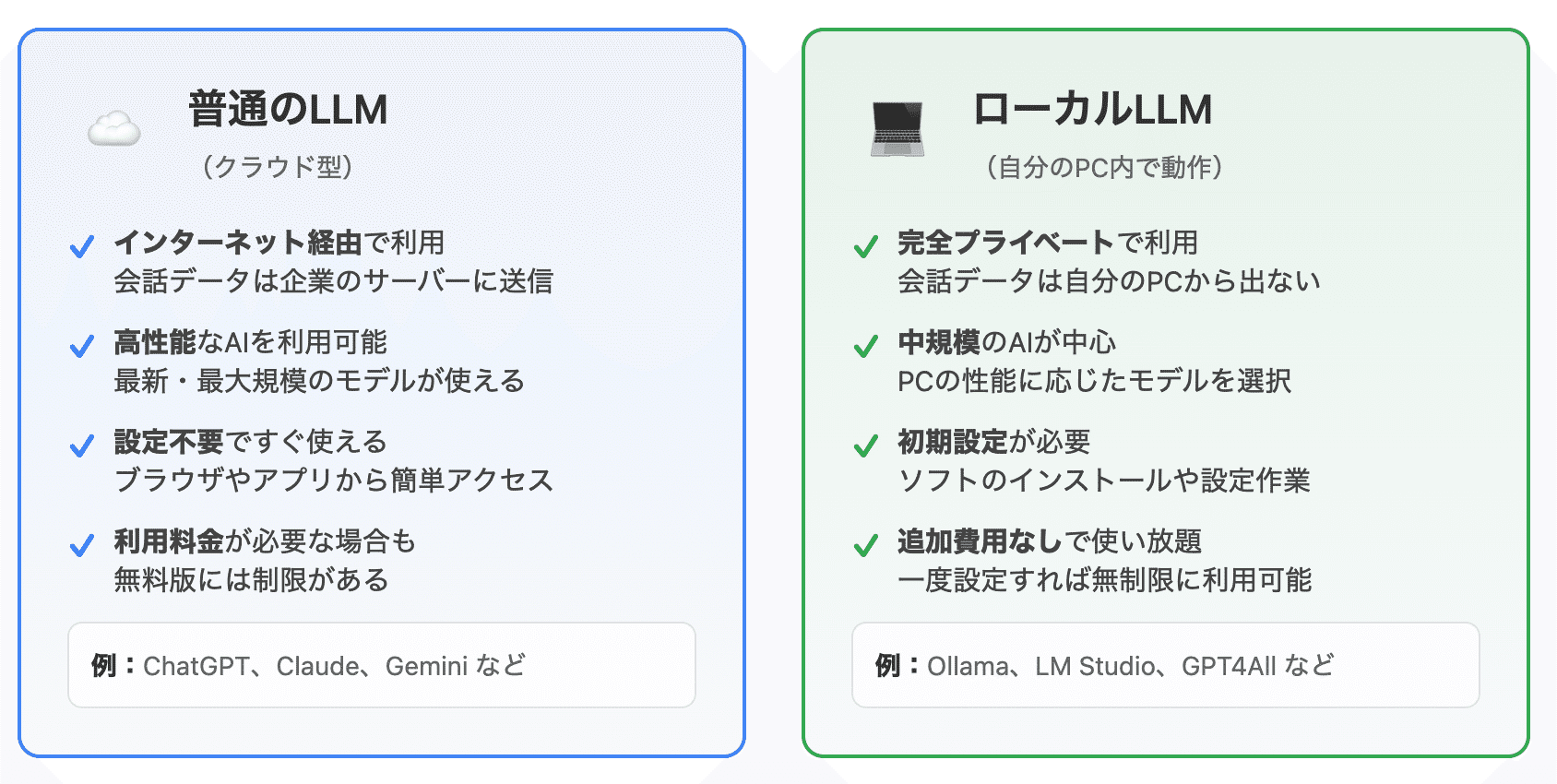

ChatGPT などの生成 AI は、多くがクラウド上の大規模言語モデル(LLM)で動いています。

近ごろは、LLM を自分の PC で動かす「ローカル LLM」も注目されています。ローカルなら通信せずに使えるので、プライバシーを守れ、従量課金も気になりません。

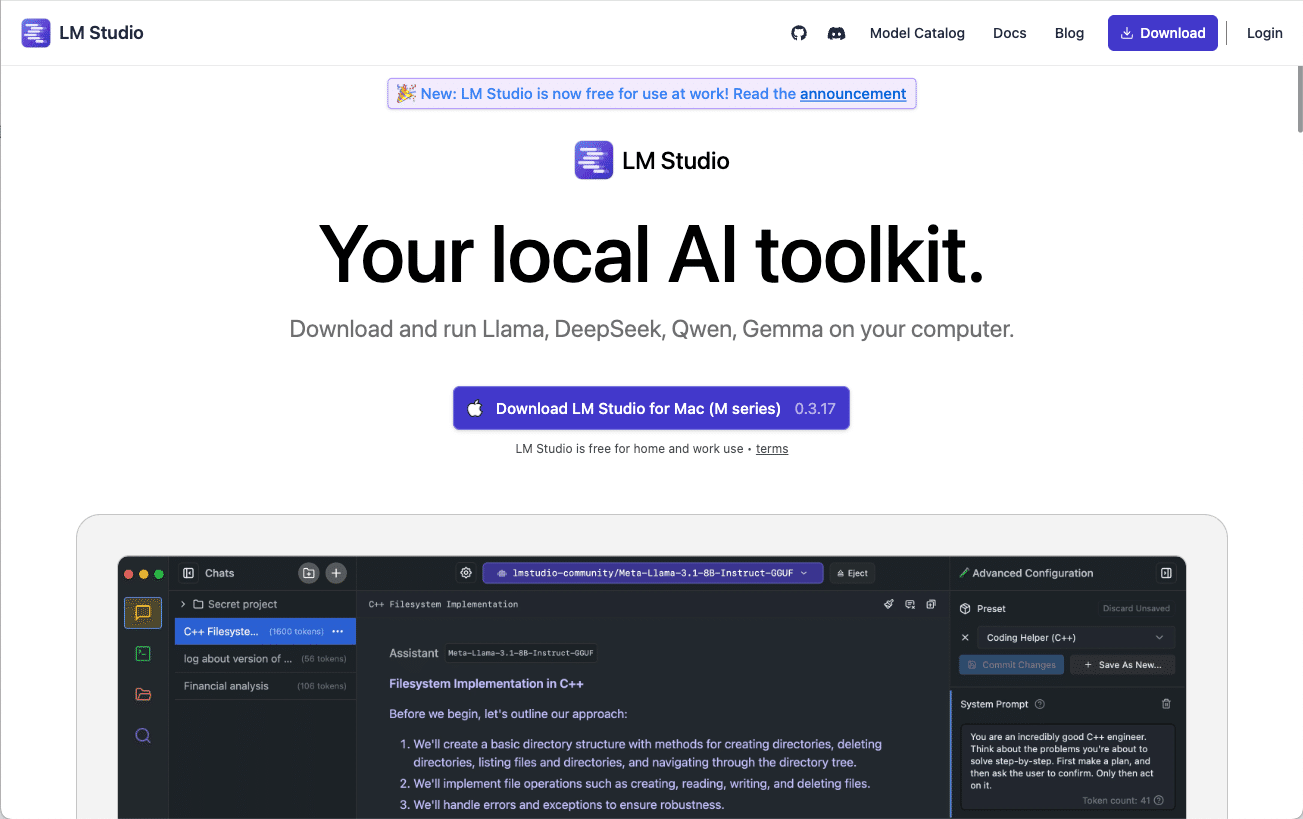

米 Element LabsのLM Studioを使えば、ご自身のPCで、手軽にローカル LLM を試せます。本記事では LM Studio の特徴と料金、導入手順、さらにDifyとの連携方法をわかりやすく紹介します。

LM Studioとは

LM Studioは、大規模言語モデル(LLM)を手軽に試せるツールです。プログラミングの知識がなくても、GUIベースの操作で文章生成やチャット対話ができます。

特に嬉しい点は、高性能な専用GPUがなくてもローカルLLMを実行できることです。また、GUIによる直感的な操作でオープンソースのLLMを気軽にダウンロード・実行でき、非常に多くの言語モデルに対応しています。

有名なGoogleの「Gemma(ジェマ)」やMeta社の「Llama(ラマ)」といった著名モデルはもちろん、特定のモデルをベースにファインチューニングされた派生モデルなど幅広くサポートしています。

https://agi-labo.com/articles/n57abfeb23461

さらに、中国のAIスタートアップが開発した大型LLM「DeepSeek(ディープシーク)」にも対応しており、そのサポート範囲の広さも魅力です。

https://agi-labo.com/articles/naa4ce8391345

一般にパラメータ数(モデルの規模)が大きいほどLLMの性能は高い傾向がありますが、近年では小型でも高性能なモデルも登場しています。

LM Studioを使えば、日本語での応答に優れたモデルやプログラミングに特化したモデルなど、用途に応じて自分好みのモデルを簡単に切り替えて試すことができます。

ローカルLLMとは

ローカルLLMとは、大規模言語モデルをクラウドではなく手元のPCやサーバーなどのローカル環境で実行することを指します。

最大の利点はインターネットを介さずAI処理ができるため、入力したデータが外部に漏れる心配がない点です。プライバシーやセキュリティを重視したい場面でも安心して利用できます。

また、クラウドのサービスと異なり利用料を気にせずに試せるのもメリットです。一方で、高度なLLMをローカルで動かすには相応のCPU性能やメモリ容量といった計算リソースが必要になります。

しかし最近はモデルの軽量化・最適化が進んでおり、LM Studioのようなツールのおかげで環境構築のハードルも下がりつつあります。

LM Studioの料金

LM Studioは基本無料で利用できます。個人利用はもちろん、現在では社内利用も追加料金なしで行えるようになっています。

MacでLM Studioを使うにはAppleシリコン(M1/M2などのMシリーズ)を搭載したMacが必要です。Intel製CPUを搭載した古いMacでは動作しないので注意しましょう。

ただしローカルLLMを快適に動かすにはPCのスペックも重要です。RAMは16GB以上が推奨で、モデルによっては処理に時間がかかる場合もあります(高性能GPU非搭載でも動作自体は可能です)。

LM StudioでローカルLLMを動かす手順

それでは、実際にLM Studio上でローカルLLMを動かす方法を見ていきましょう。ここではMac(Appleシリコン搭載)環境を例に、インストールからモデル実行までの基本的な流れを説明します。

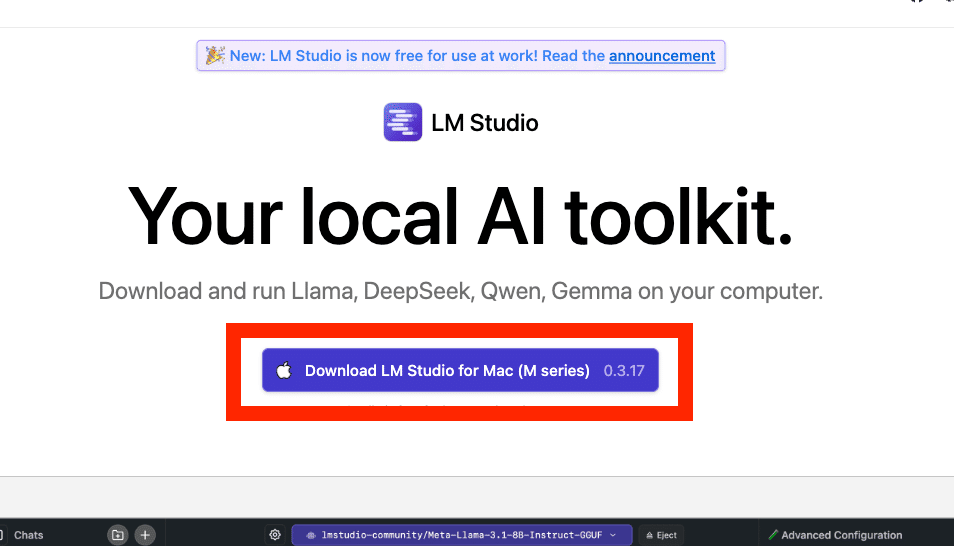

LM Studioのダウンロードとインストール

まず公式サイト(LM Studio公式ページ)からMac向けのインストーラをダウンロードします。

サイトの「Download LM Studio for Mac」ボタンをクリックし、Appleシリコン用のmacOS版を選択してダウンロードしてください。

ダウンロードしたディスクイメージ(.dmgファイル)を開き、中の「LM Studio」アプリをアプリケーションフォルダへコピーすればインストール完了です。

LM Studioの基本的な画面構成

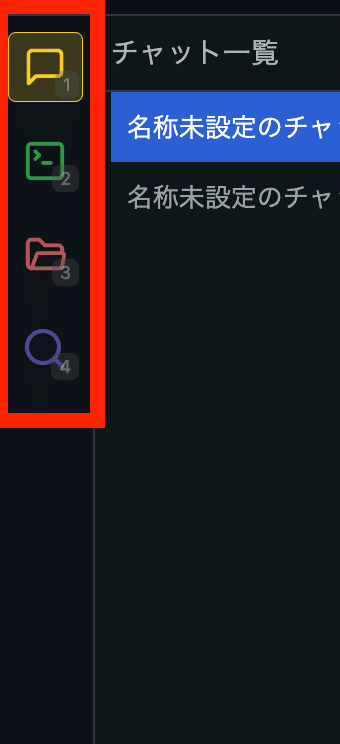

インストールが完了しアプリを起動すると、LM Studioのメイン画面が表示されます。

チャット (吹き出しアイコン 💬)

ダウンロードしたモデルと会話する画面です。モデルを読み込んだ後、この画面の下にある入力欄から質問や指示を送ります。開発者 (ターミナルアイコン >_)

LM Studioをサーバーとして動かすための画面です。後述するDifyのような外部ツールと連携させる際に使います。マイモデル (フォルダアイコン 📂)

PCにダウンロードしたモデルの一覧を確認・管理する画面です。ここから不要になったモデルを削除することもできます。探索 (虫眼鏡アイコン 🔍)

モデルを探す画面です。ここからHugging Faceなどで公開されている様々なLLMを検索し、PCにダウンロードできます。

言語モデルのダウンロード

LM Studioのメイン画面が表示されたら、ローカルで動かすLLM(言語モデル)を選んでダウンロードします。

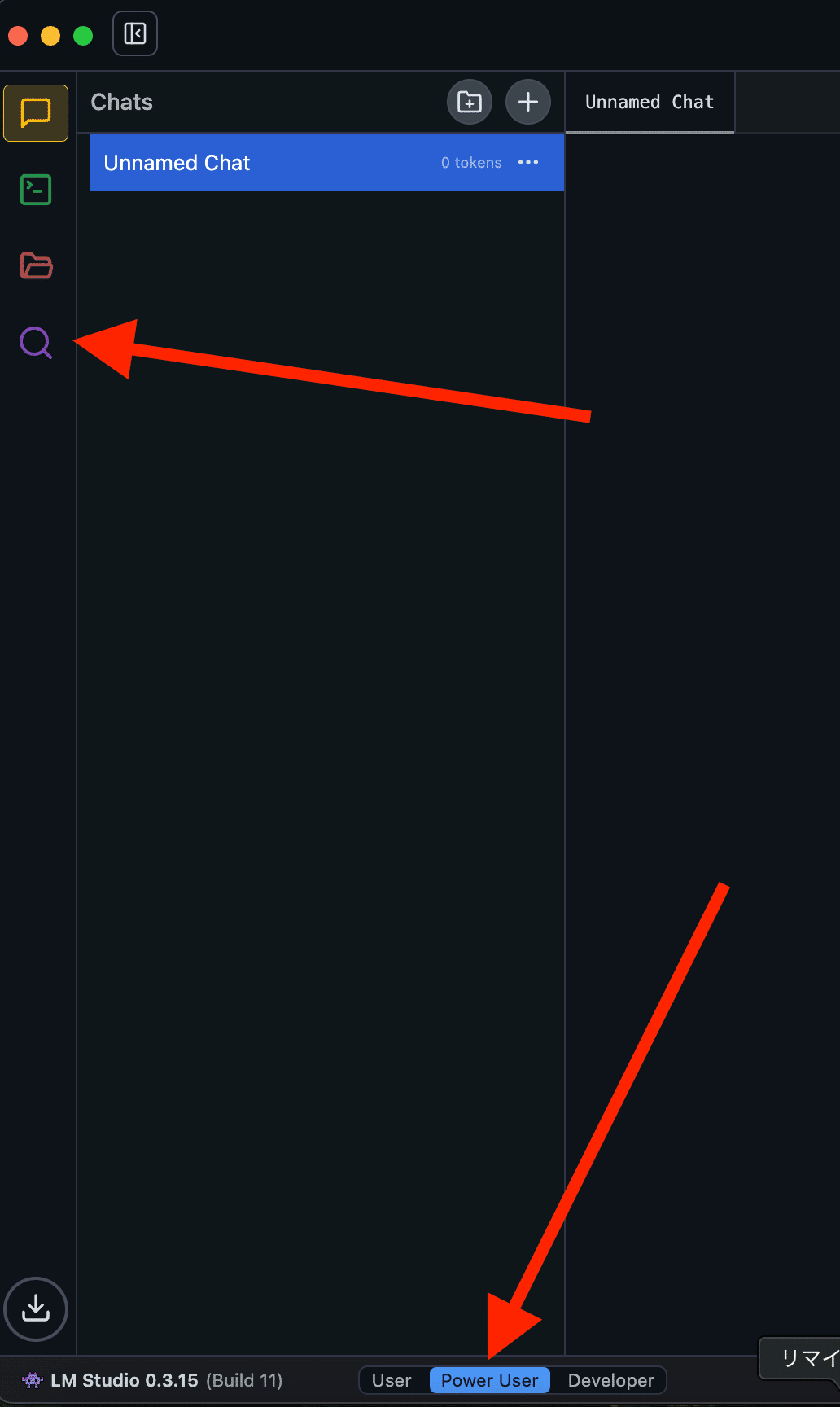

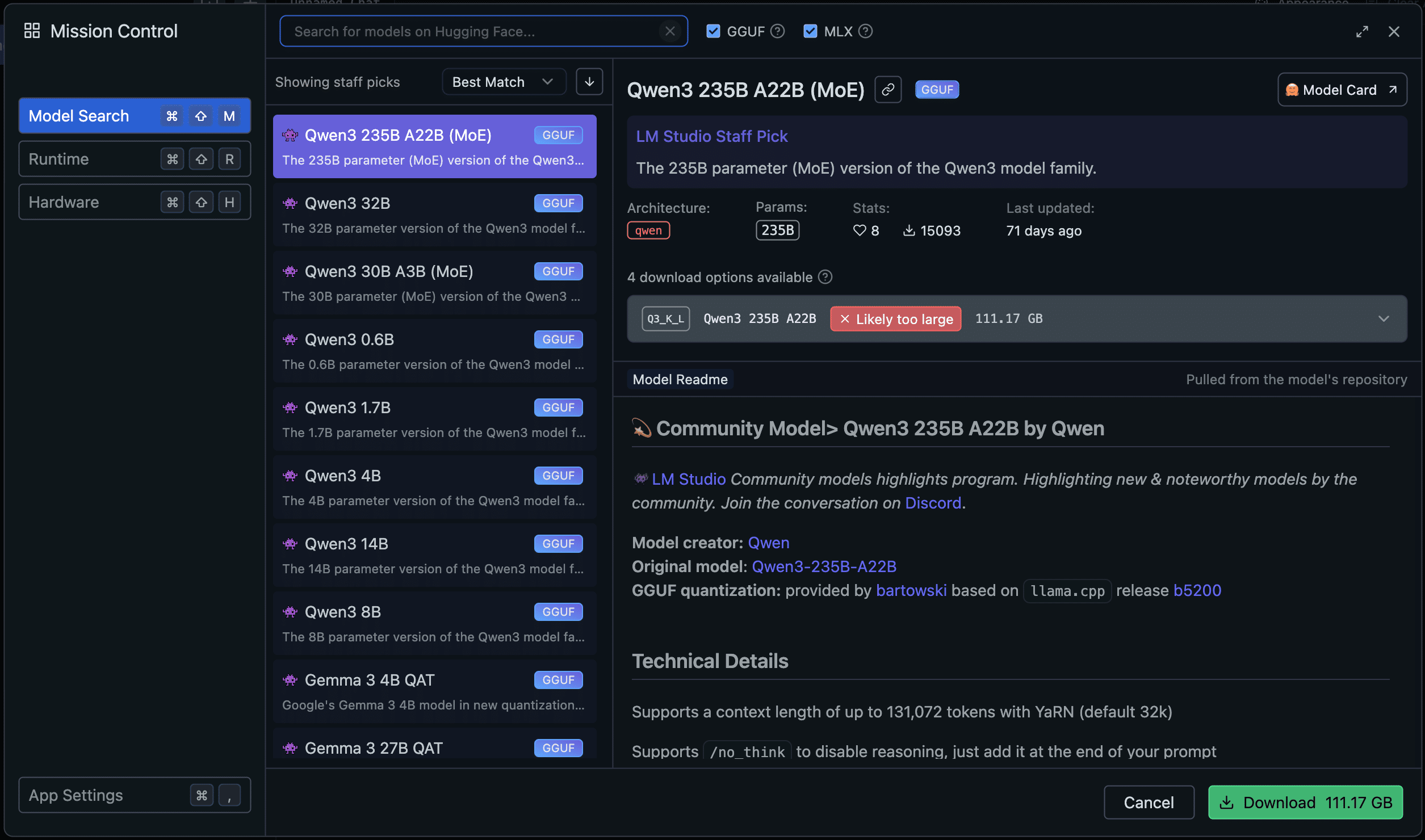

LM Studioにはモデルを検索して追加できる探索機能があります。画面下部でモードを「Power User」に切り替えると左サイドバーに検索アイコンが現れるので、クリックします。

検索画面が表示されるので、そこでモデル名やキーワードを入力して探します。

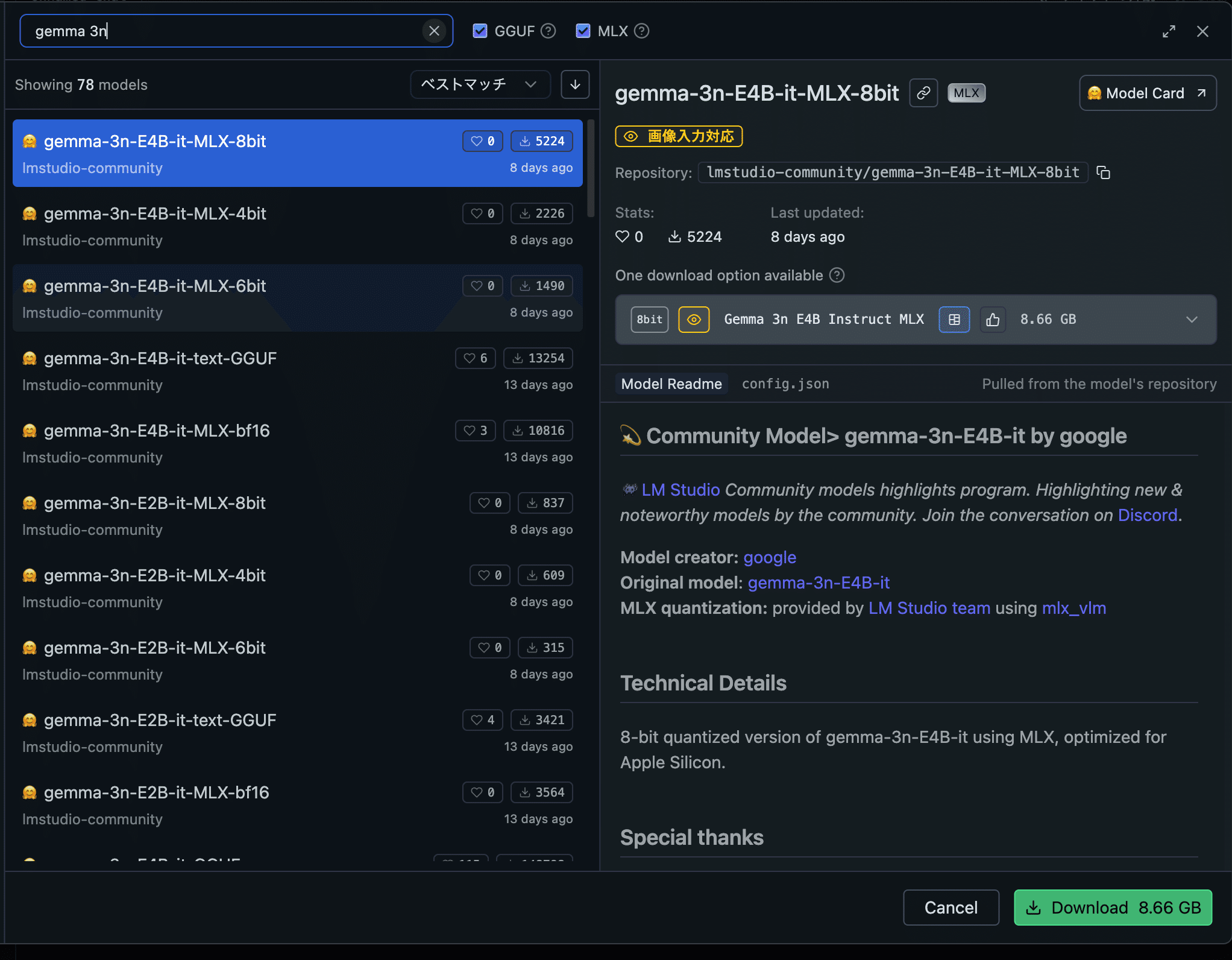

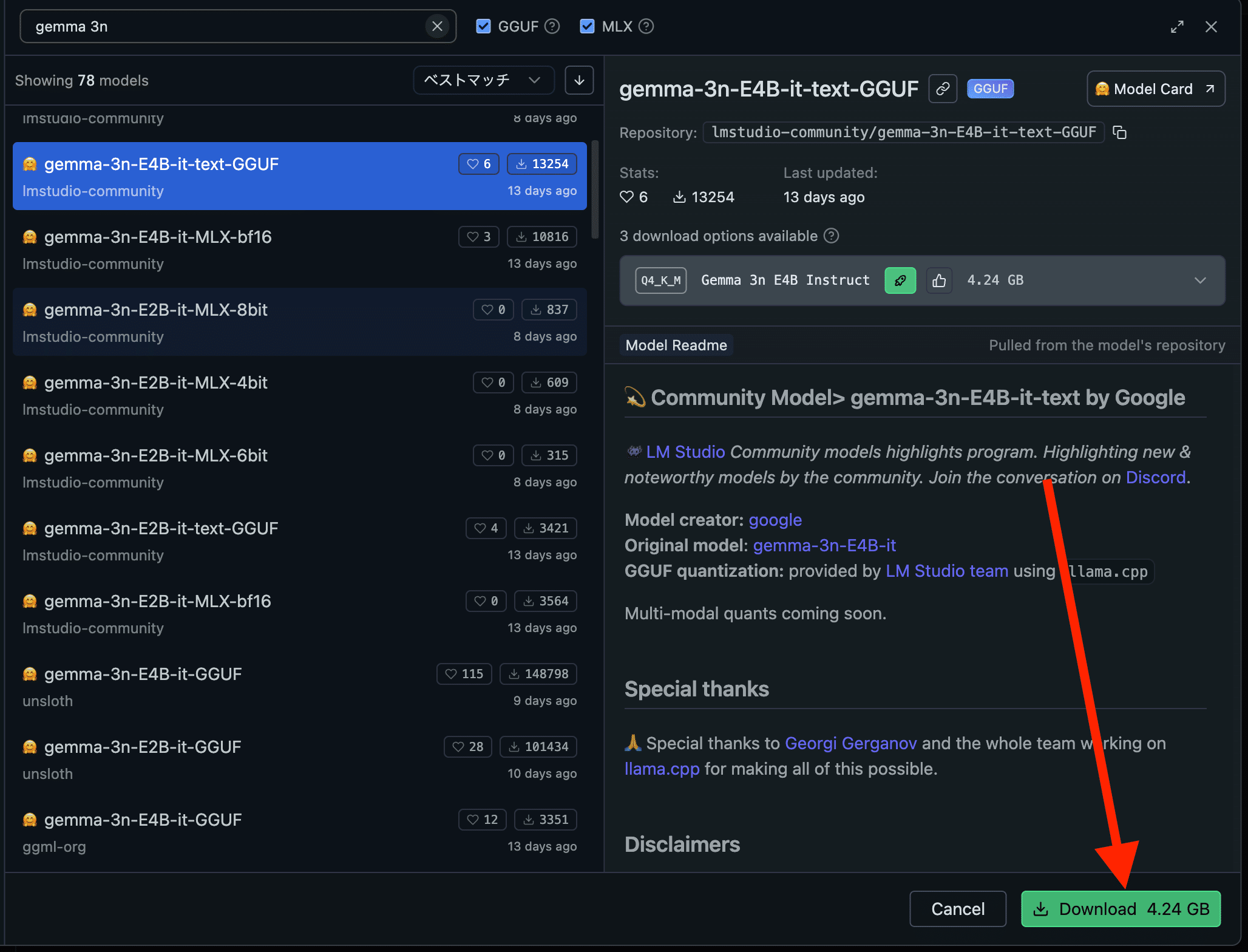

例として、Gemma 3nと検索してみます。Hugging Faceに公開されているモデルが一覧表示されます。

モデルを選択したら、「Download」ボタンをクリックします。

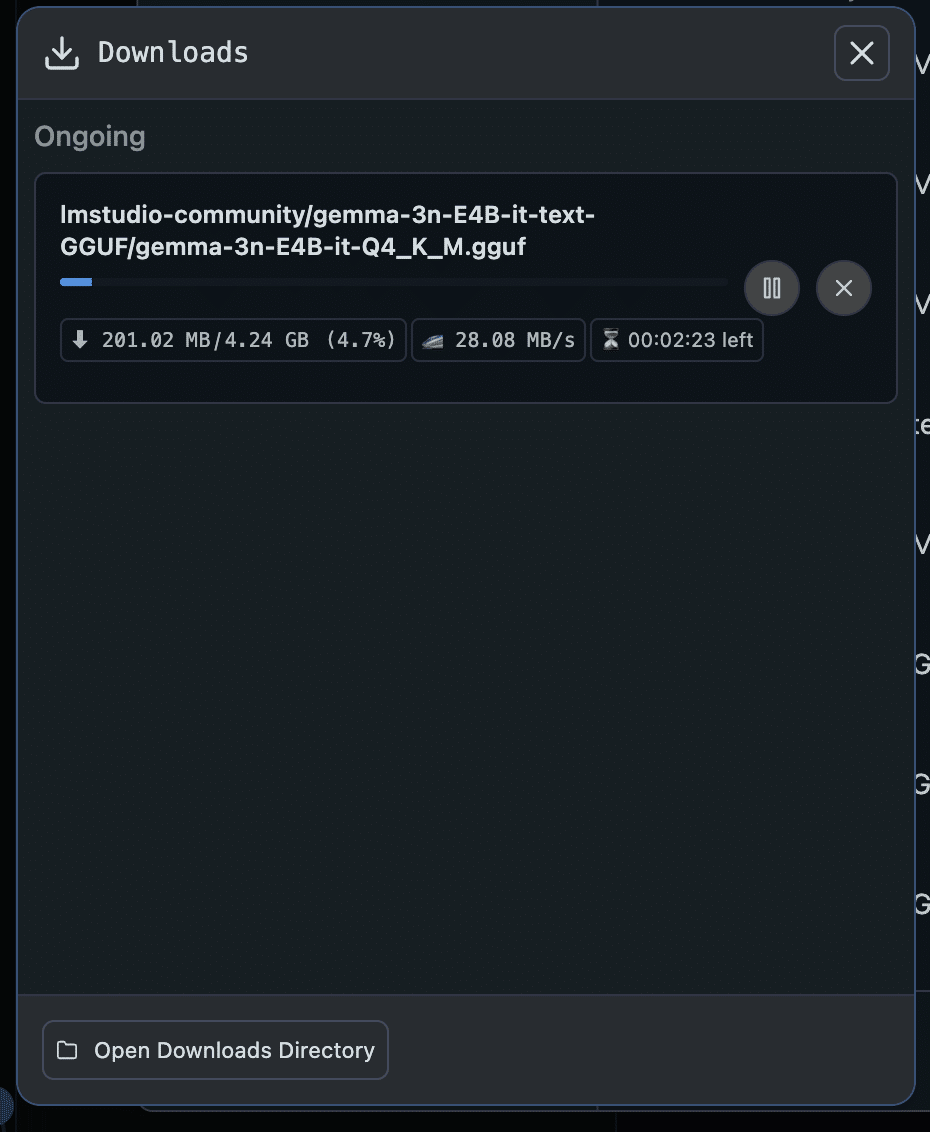

すると、ダウンロードが始まります。ダウンロードには数分かかる場合があります。

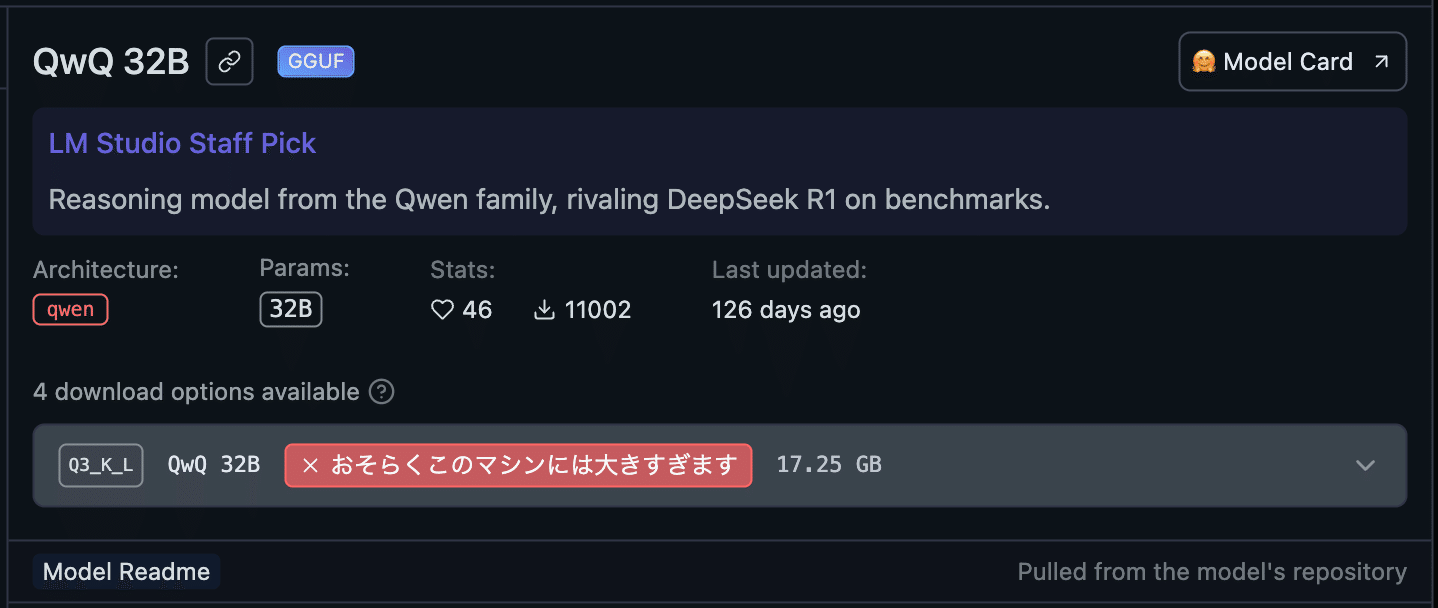

※極端に大規模なモデルを選ぼうとすると「おそらくこのマシンには大きすぎます」といった警告が出る場合があります。まずは自分のMacで無理なく動きそうなモデルから試すと良いでしょう。

モデルの読み込みと動作確認

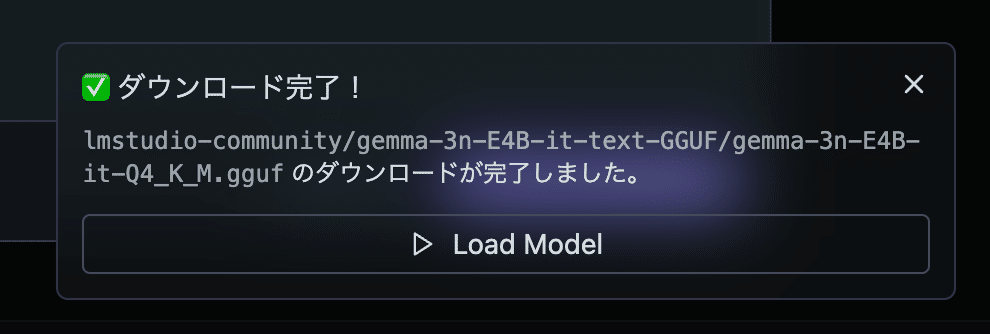

モデルのダウンロードが完了したら、そのモデルをロード(Load)します。「Load Model」ボタンをクリックしてください。

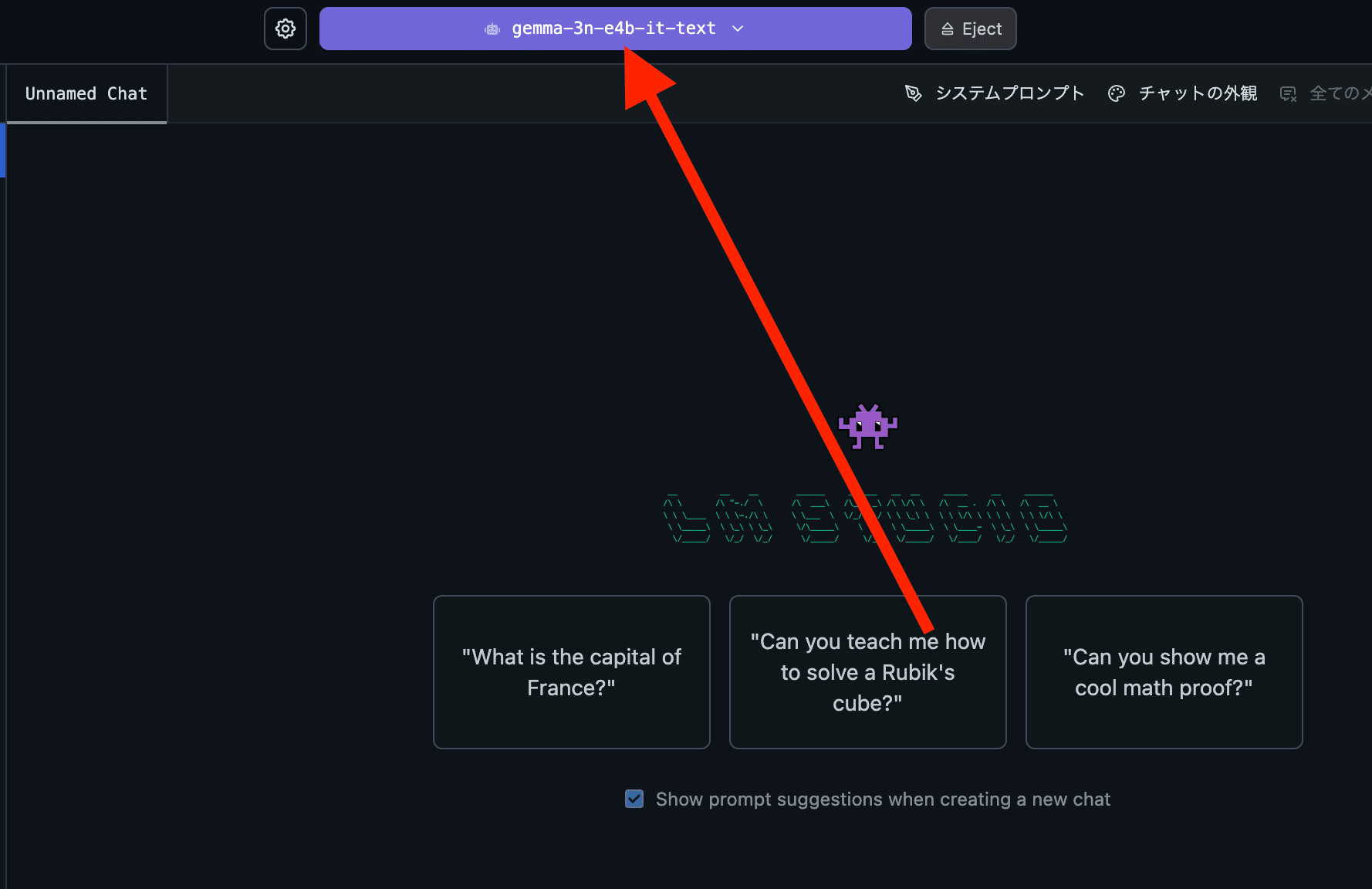

ロード処理が終わるとウィンドウ上部にモデル名が表示され、モデルが起動した状態になります。

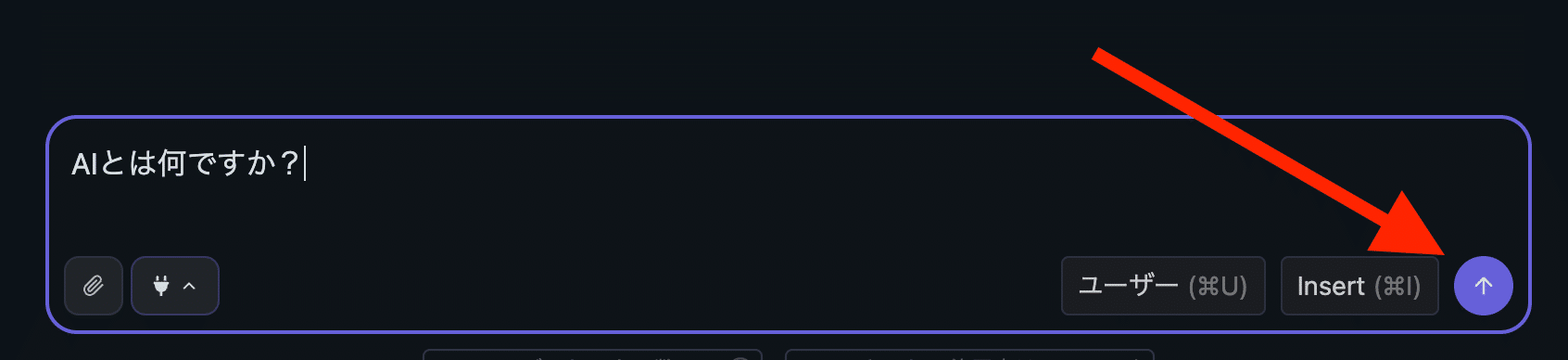

あとは、画面下部のチャット入力欄に質問やメッセージを入力し、送信ボタンをクリックすればモデルが回答を生成してくれます。

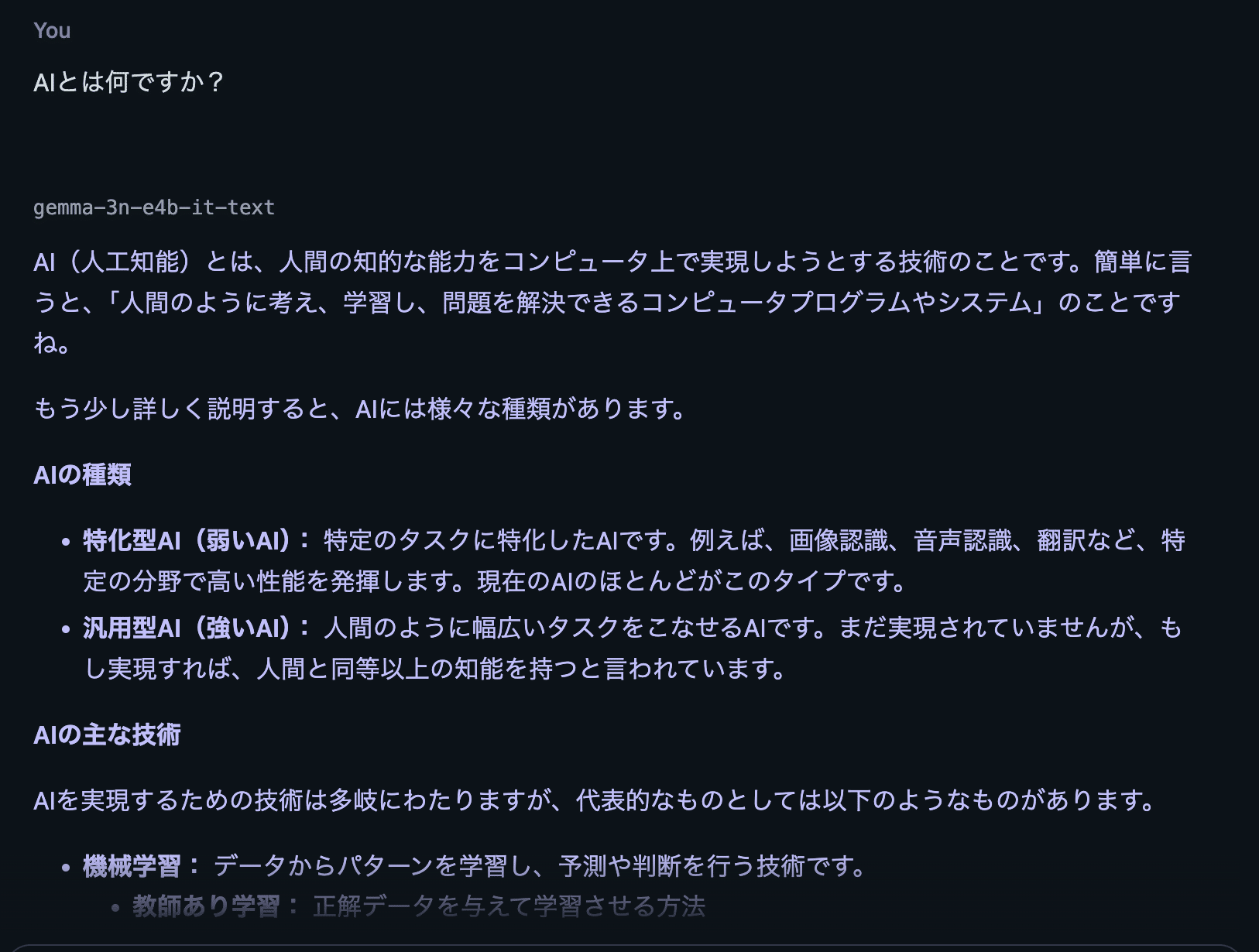

例えば「AIとは何ですか?」といった問いかけに対し、少し待つと回答が表示されます。ただし、応答が得られるまでの時間はモデルの規模やMacの性能によって変わります。

クラウド上のChatGPTなどと比べると、モデルによって、ローカルで動かすLLMは応答までに時間がかかる傾向がある点は覚えておきましょう。

特に大規模モデルでは処理が重くなりますので、最初は軽量なモデルからスムーズに試してみることをおすすめします。

これらの手順によって、インターネット接続なしで自分のMac上にLLM環境を構築できます。

ローカルで動作しているとはいえ、基本的なチャットAIとしての使い勝手はクラウドサービスと変わりません。自分だけのAIアシスタントを手元で動かせるのはとても画期的な体験です。