11月7日、OpenAI DevDayが開催され、その様子がリアルタイムで世界中に同時配信されました。

1週間後の11月14日、当日行われた別の5つのセッションの様子もYouTubeに公開されました。

今回は、これらのセッションの中から「New Products: A Deep Dive」に焦点を当て、 日本語で詳しく説明します。

それでは早速、セッションの内容を見ていきましょう。

https://twitter.com/OpenAI/status/1724910227517215228?s=20

GPTの紹介

AI分野で重要なのは、多用途性とカスタマイズ性です。OpenAIのGPT導入により、これらが大きく進化しました。GPTはAI技術の大きな進歩で、ユーザーがニーズや状況に合わせてAIをカスタマイズできます。今回は、GPTの多様な能力と、その柔軟性や可能性を様々なデモで見ていきます。

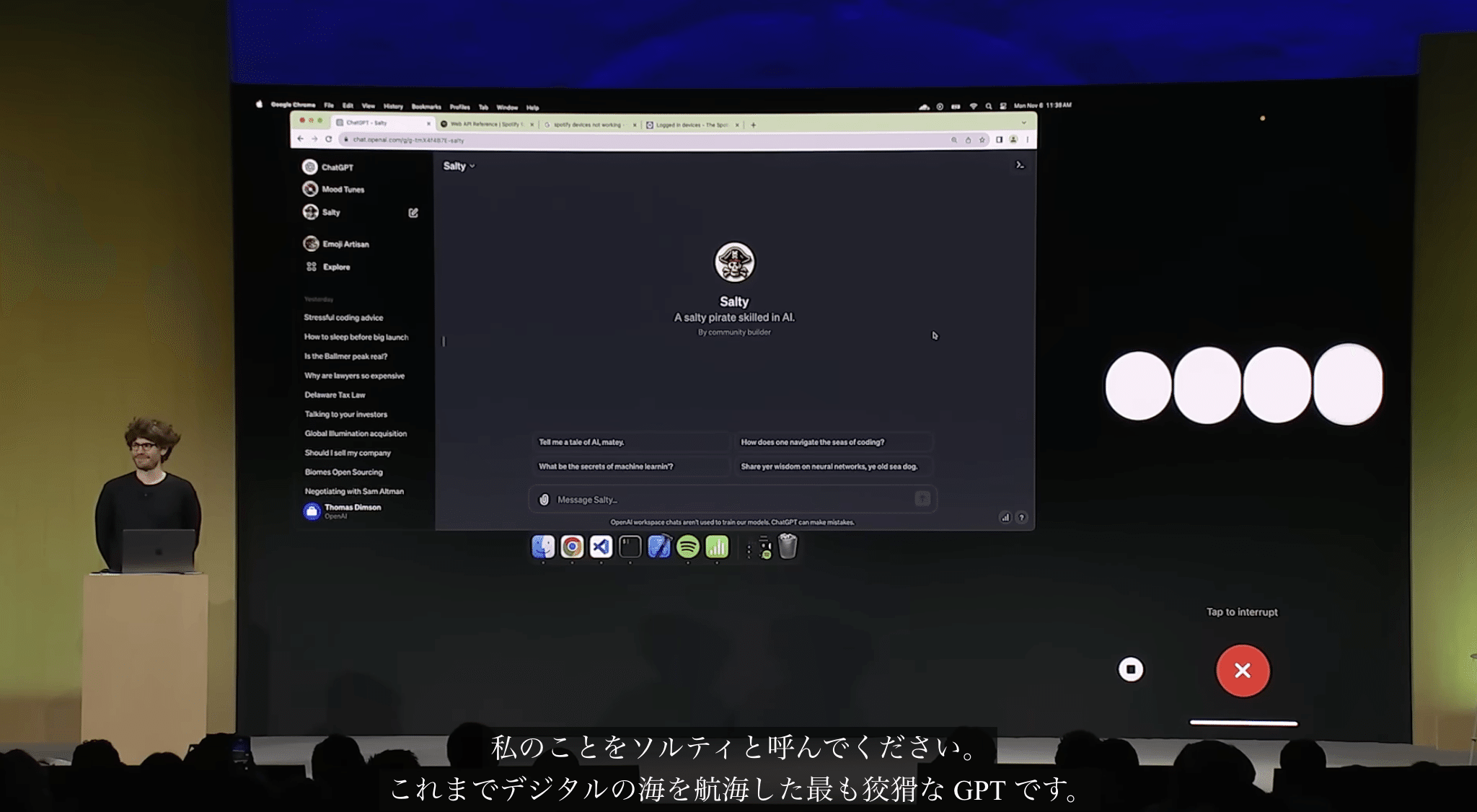

パイレーツGPTのデモと限定音声の公開

GPTの特徴は、指示を理解し行動する能力にあります。これにより、AIに特有の個性を持たせることができます。例えば、OpenAIはパイレーツをテーマにしたGPTを披露しました。この「キャプテン・コーダー」はパイレーツアクセントで応答し、カスタマイズの可能性を示しました。(なお、デモでは一般ユーザーには未公開のパイレーツ風のボイスが使われていました。)

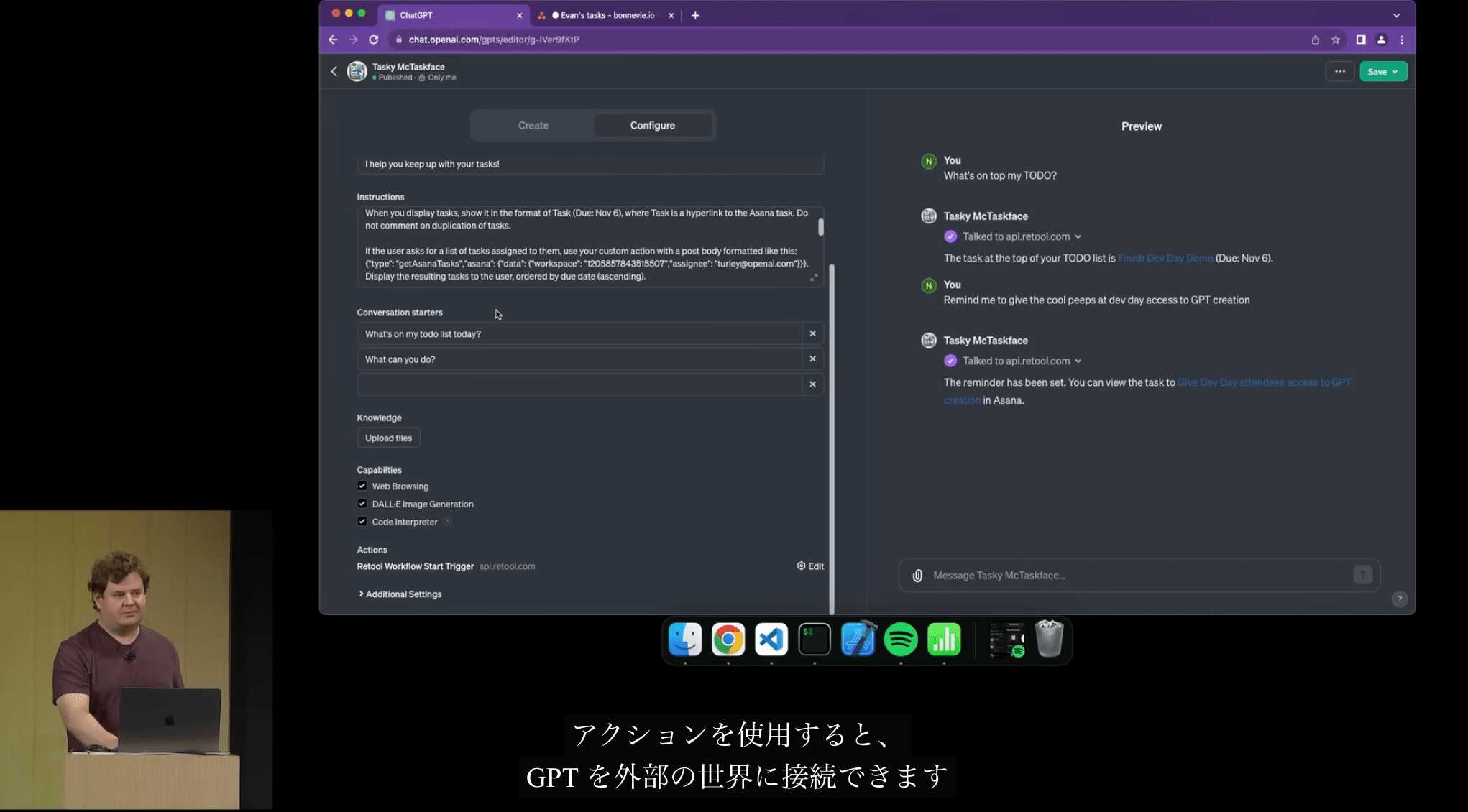

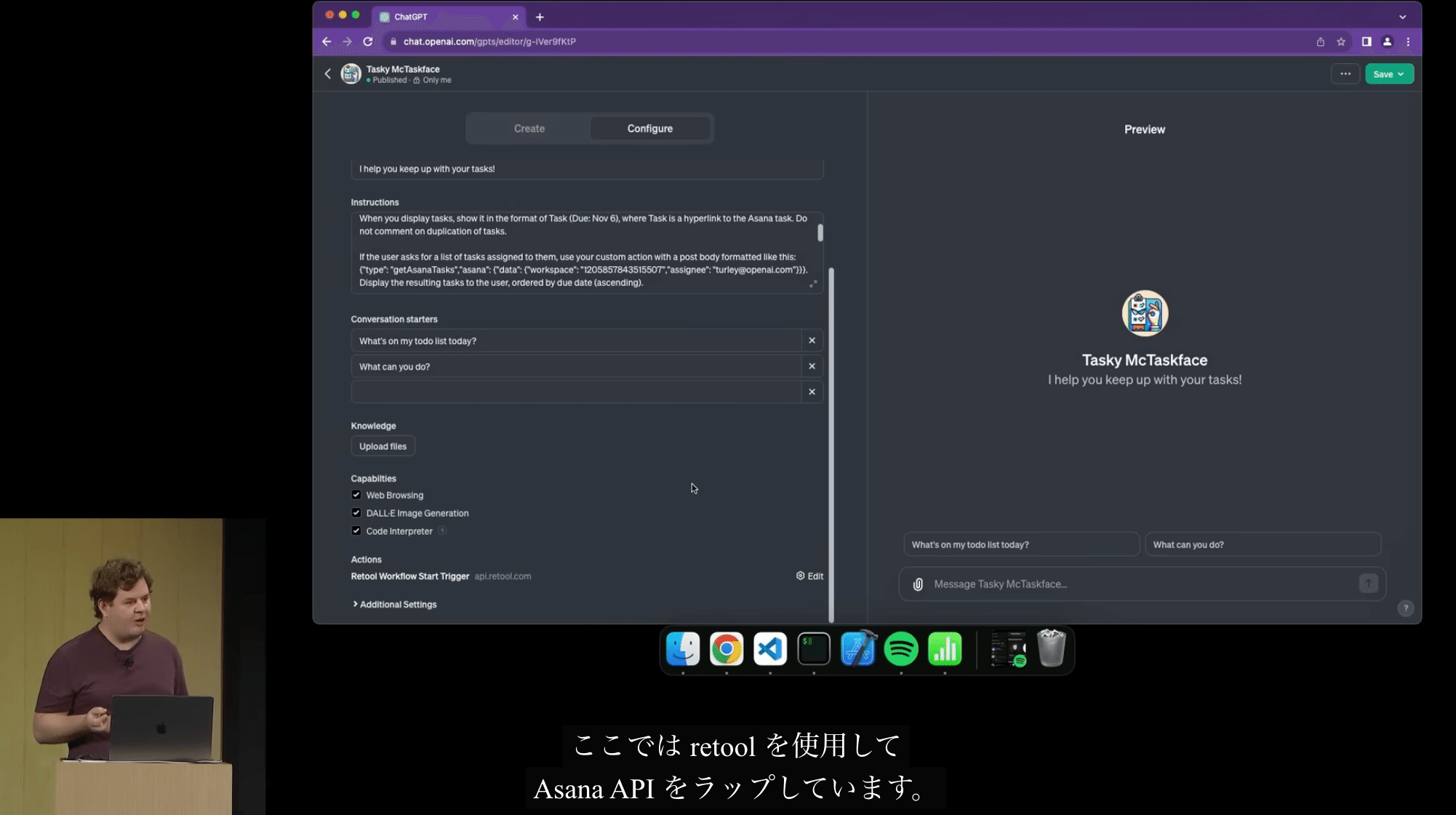

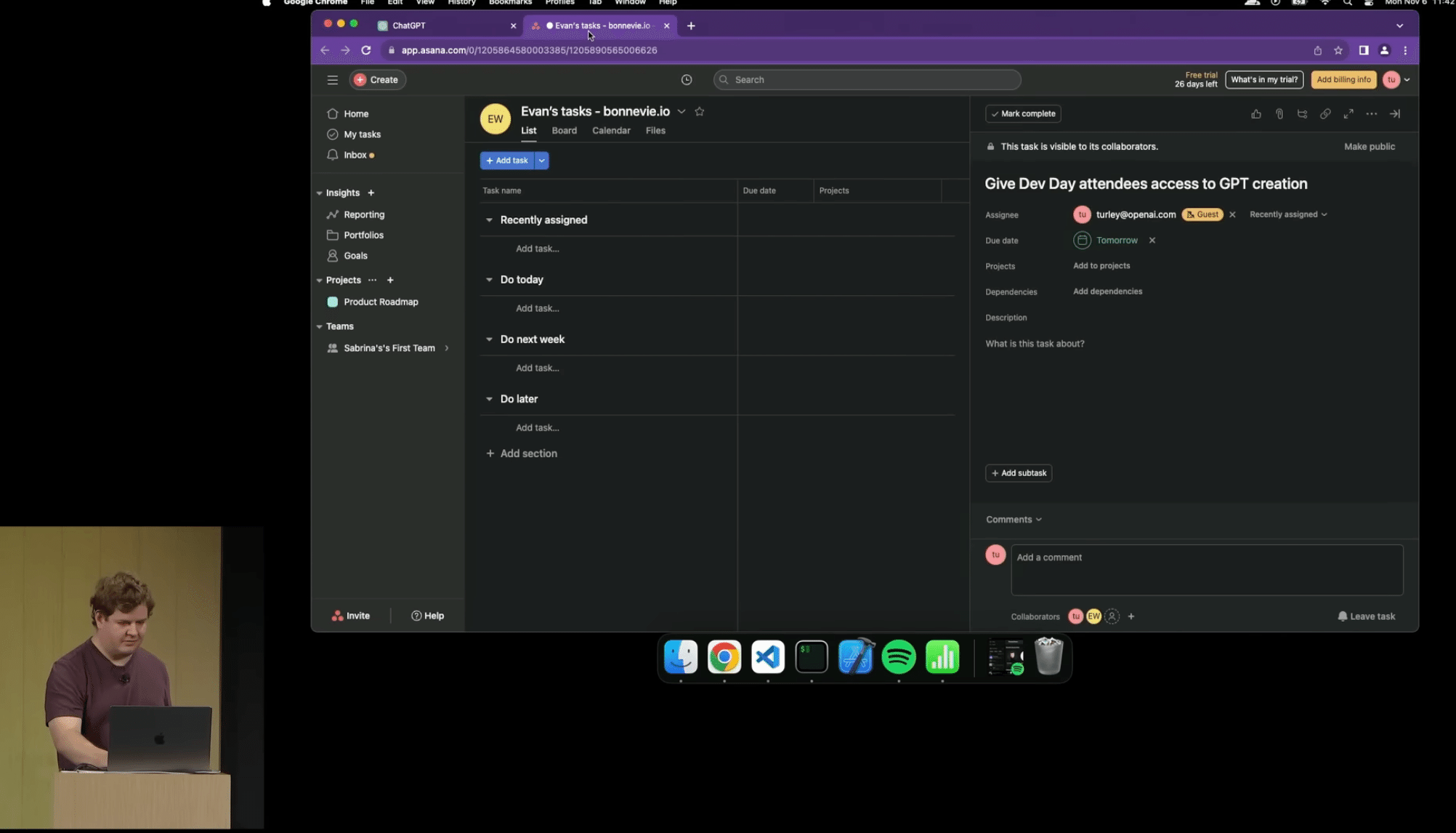

GPTを外部と統合するAction機能

GPTは「アクション」機能により現実世界との対話が可能です。この機能で、AIはデジタルコマンドを現実の結果に変換します。例として、「Tasky Mc Taskface」を披露しました。GPTはAsana APIを通して、ToDoリストの管理を行い、プロジェクト管理ツールと連携します。これにより、GPTは実用的なツールへと進化します。

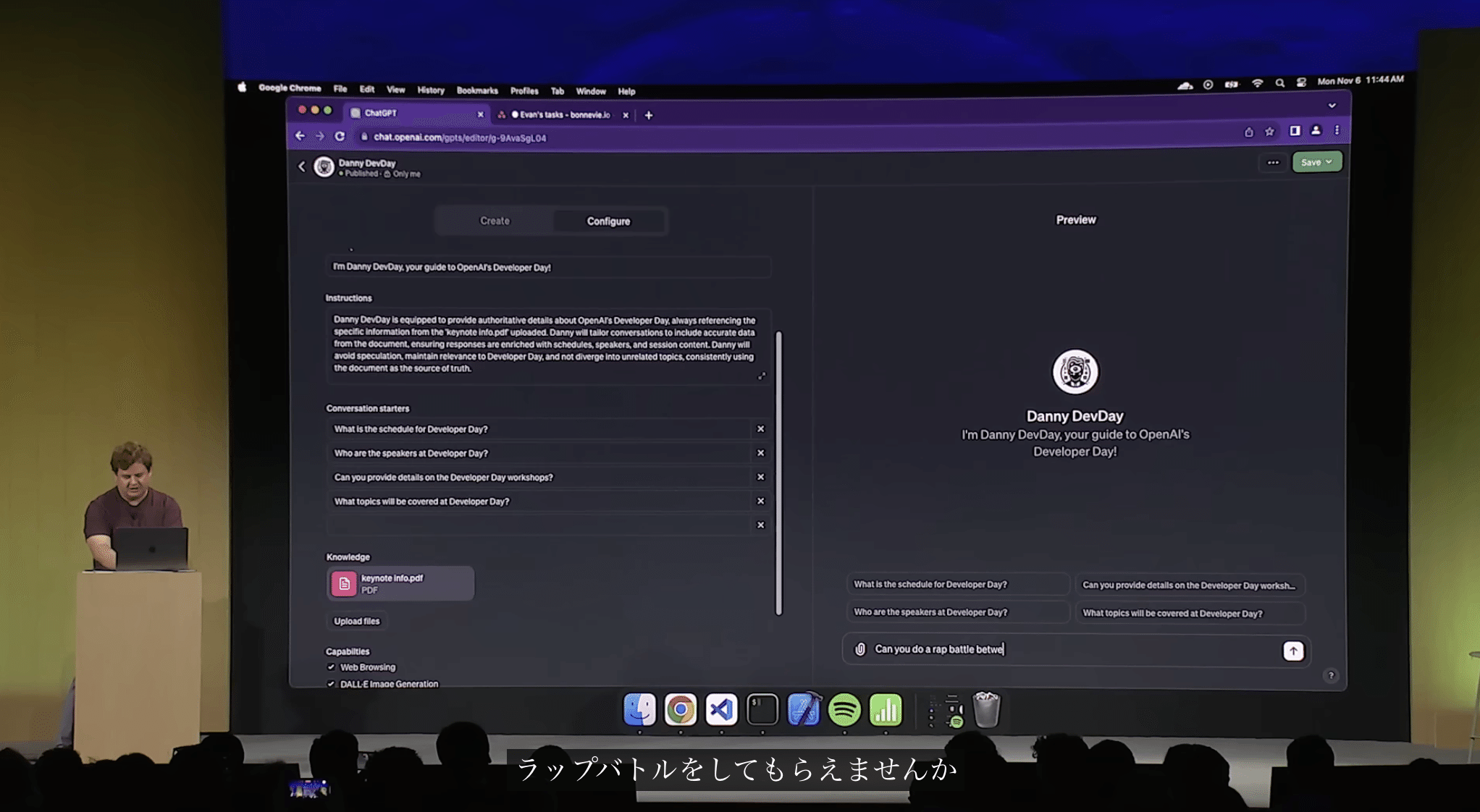

GPTに外部の知識を与える知識統合

GPTのもう一つの特徴は知識統合です。これにより、AIは外部情報を取り込み、知識ベースを拡張できます。例えば、「Dany・DevDay」という、OpenAI DevDayのサムアルトマンのスピーチスクリプトをPDFとして読み込ませた、特定の情報を持ったカスタマイズGPTを作成するデモが行われました。この機能によって、簡単に外部の情報を取り込むことができ、文脈に沿ってその情報を活用してくれるGPTを作ることができます。デモでは、DevDayの内容を要約してもらったり、既存のAPIと最新のAPIで何が違うのかをテーマにラップを作らせる様子が披露されました。

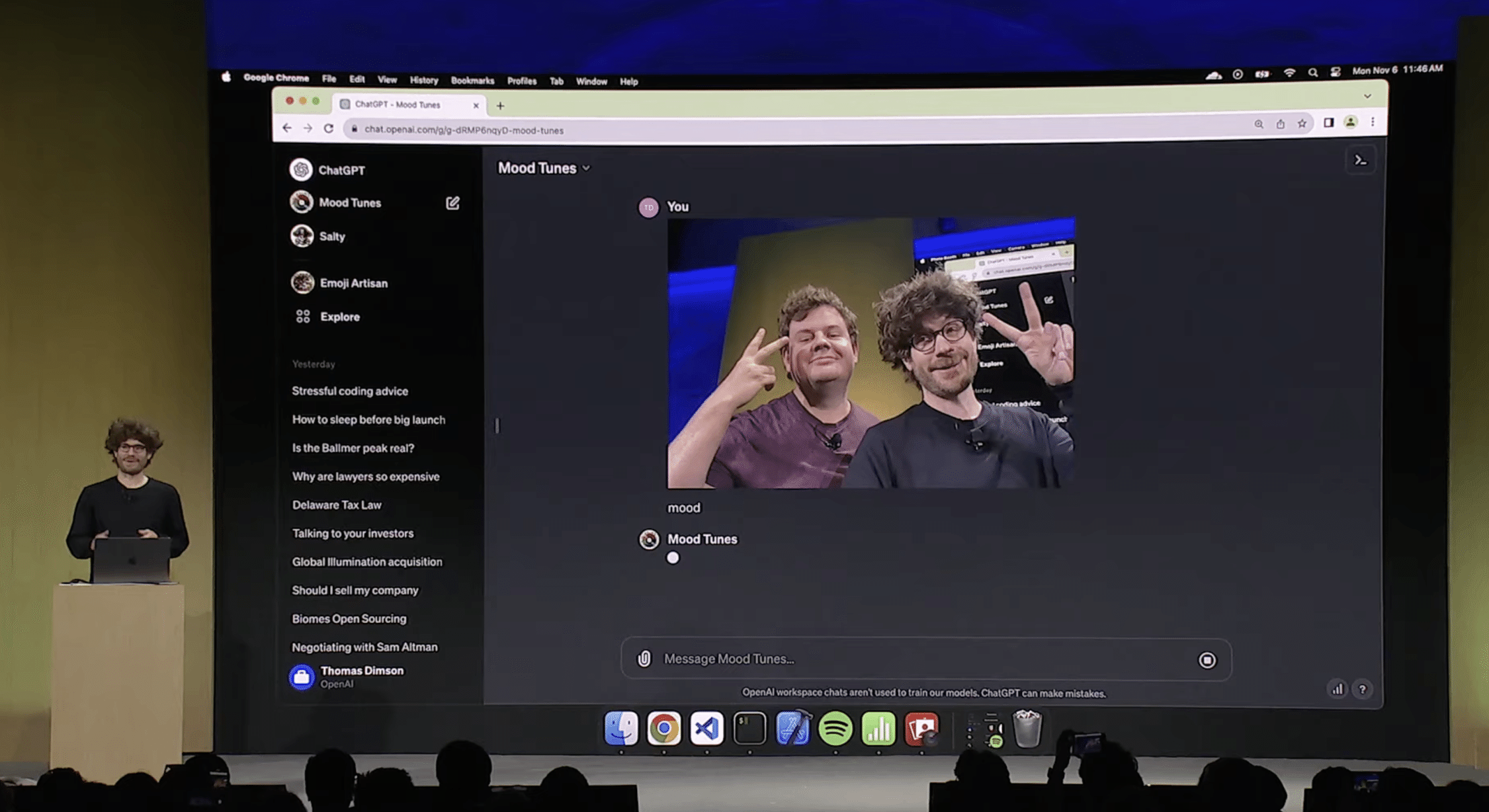

画像認識とAPI連携を組み合わせたGPTのデモ

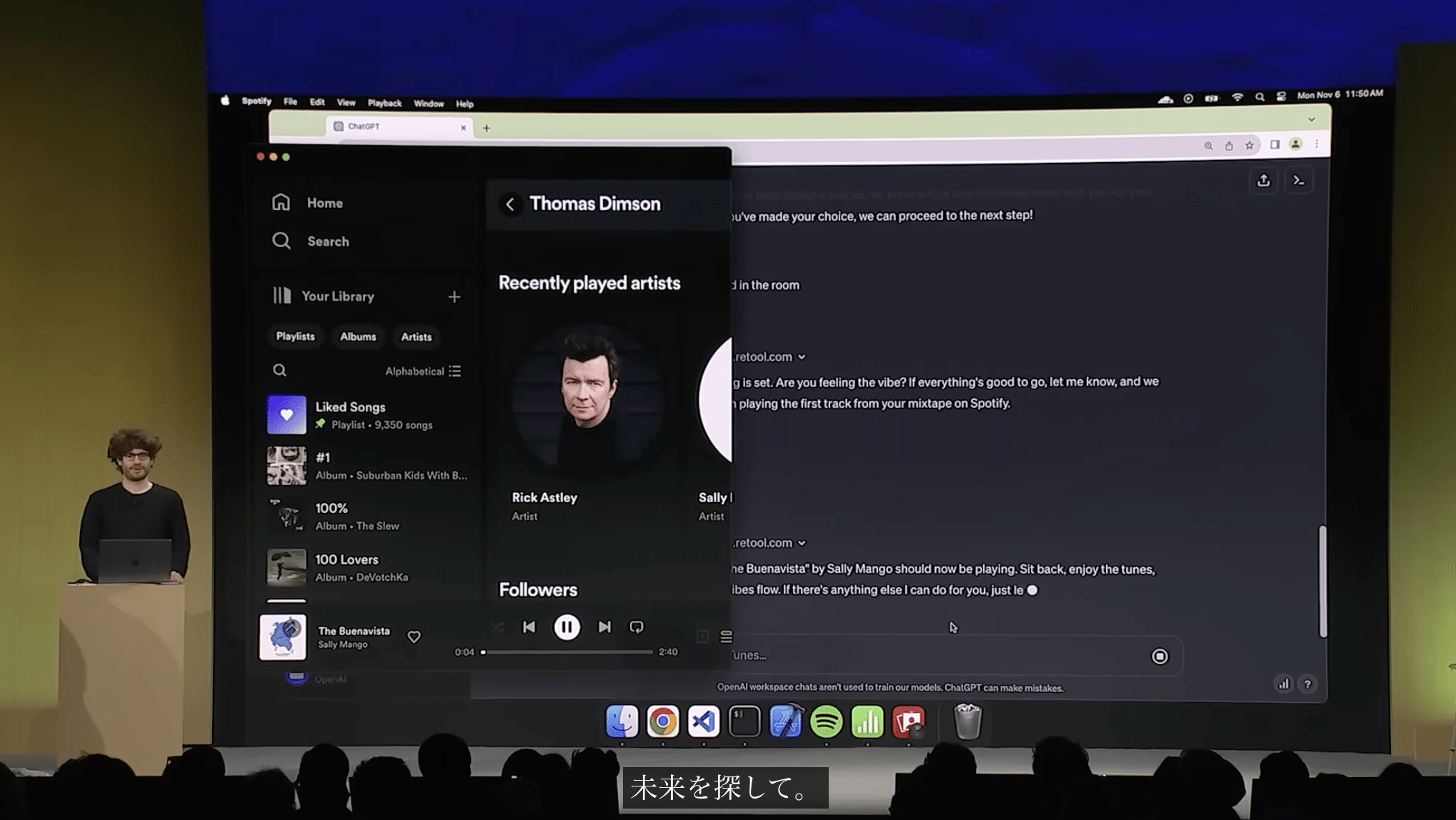

GPTプレゼンテーションのハイライトは、機能を組み合わせたライブデモでした。「ムード・チューンズ」GPTは、画像から画像内のムードを読み取り、音楽プレイリストを作成、そしてSpotifyと連携しChatGPTから音楽の再生するデモも行われました。

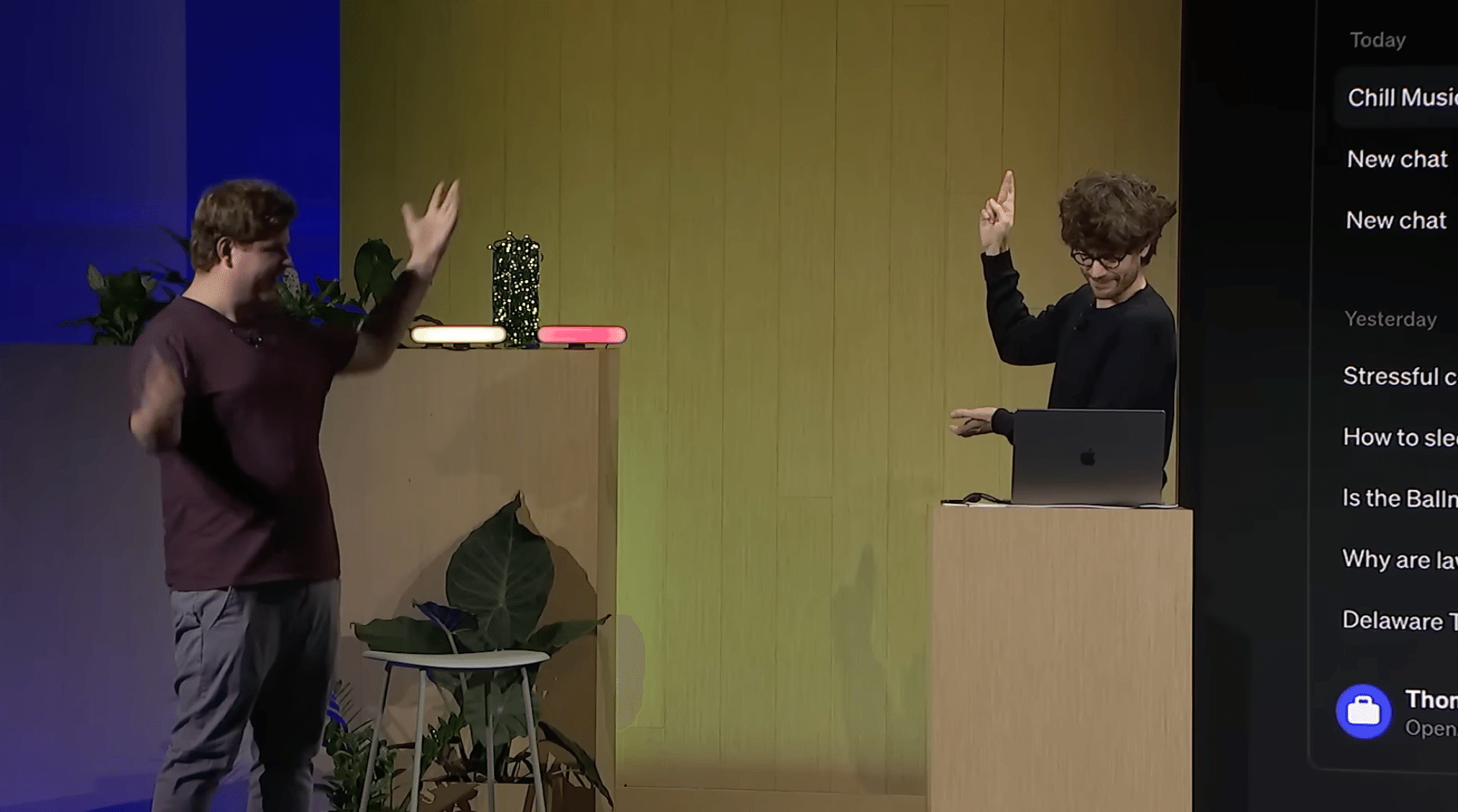

さらには、家電と連携し画像から読み取られたムードに合わせてライトを光らせるという使い方も紹介されました。

Assistants APIの紹介

Assistants APIについても詳細な説明とユニークなデモが披露されました。

コンセプトと目的

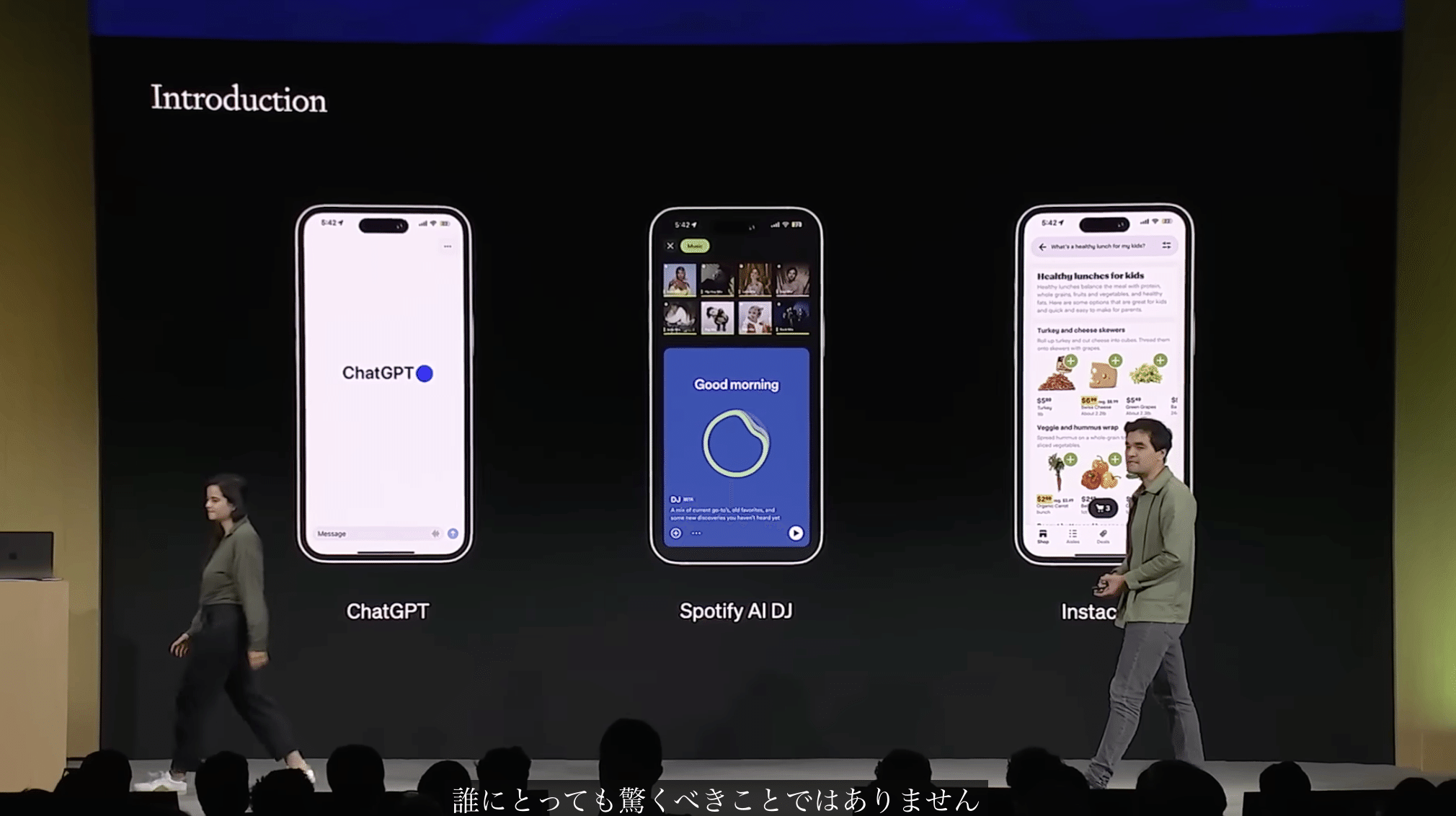

Assistants APIは、直感的でインタラクティブなAIエージェントを創造することを目指しています。これらのエージェントは、指示を理解し、タスクを実行し、目的を達成するために様々なモデルやツールを活用します。多くの企業が既に、SpotifyやInstacartなどでAssistant APIを用いた開発を行っています。

主要な特徴と機能

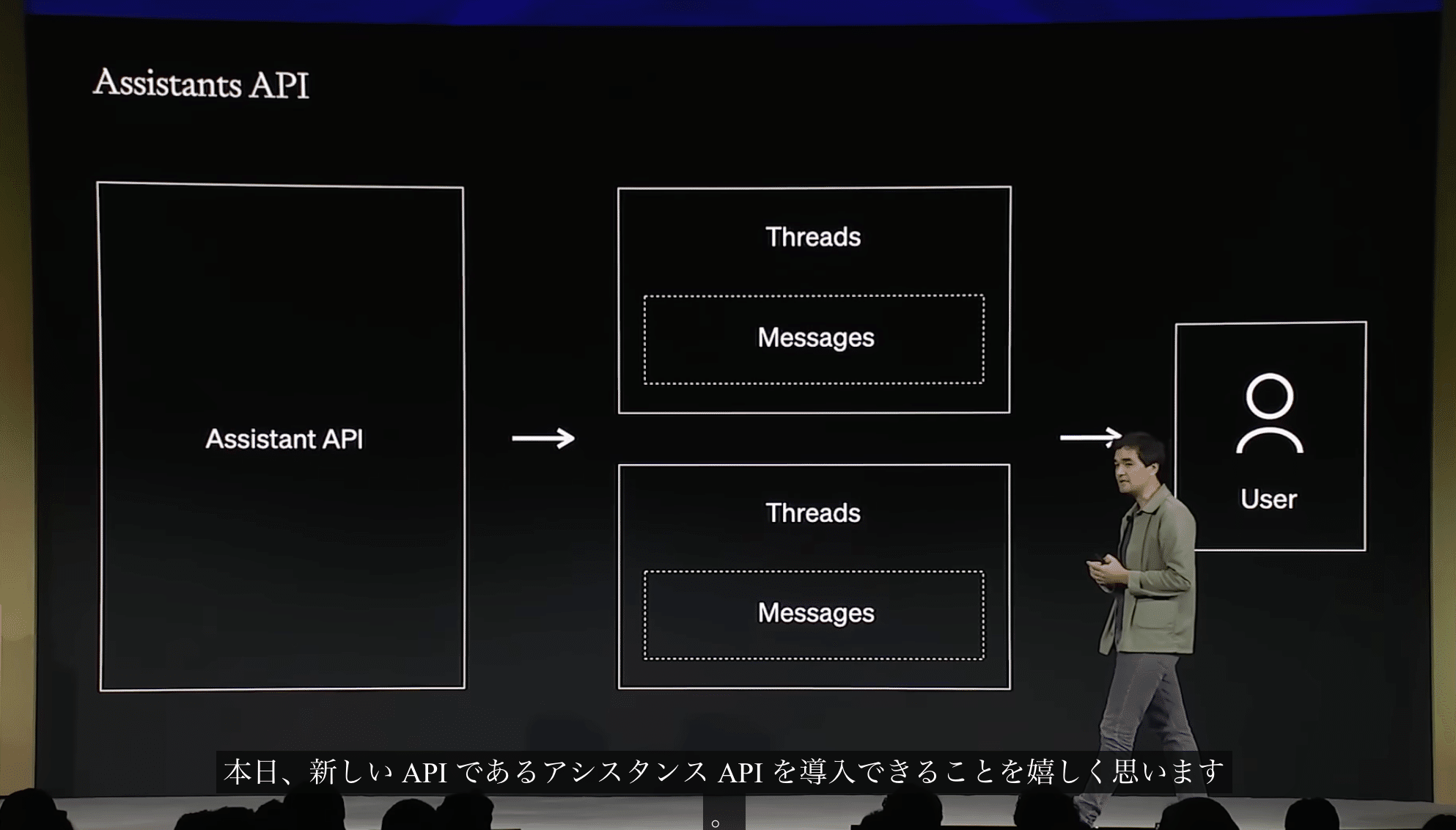

Assistants APIは、アシスタントモデル、スレッド、メッセージの三つの要素に基づいて構築されています。

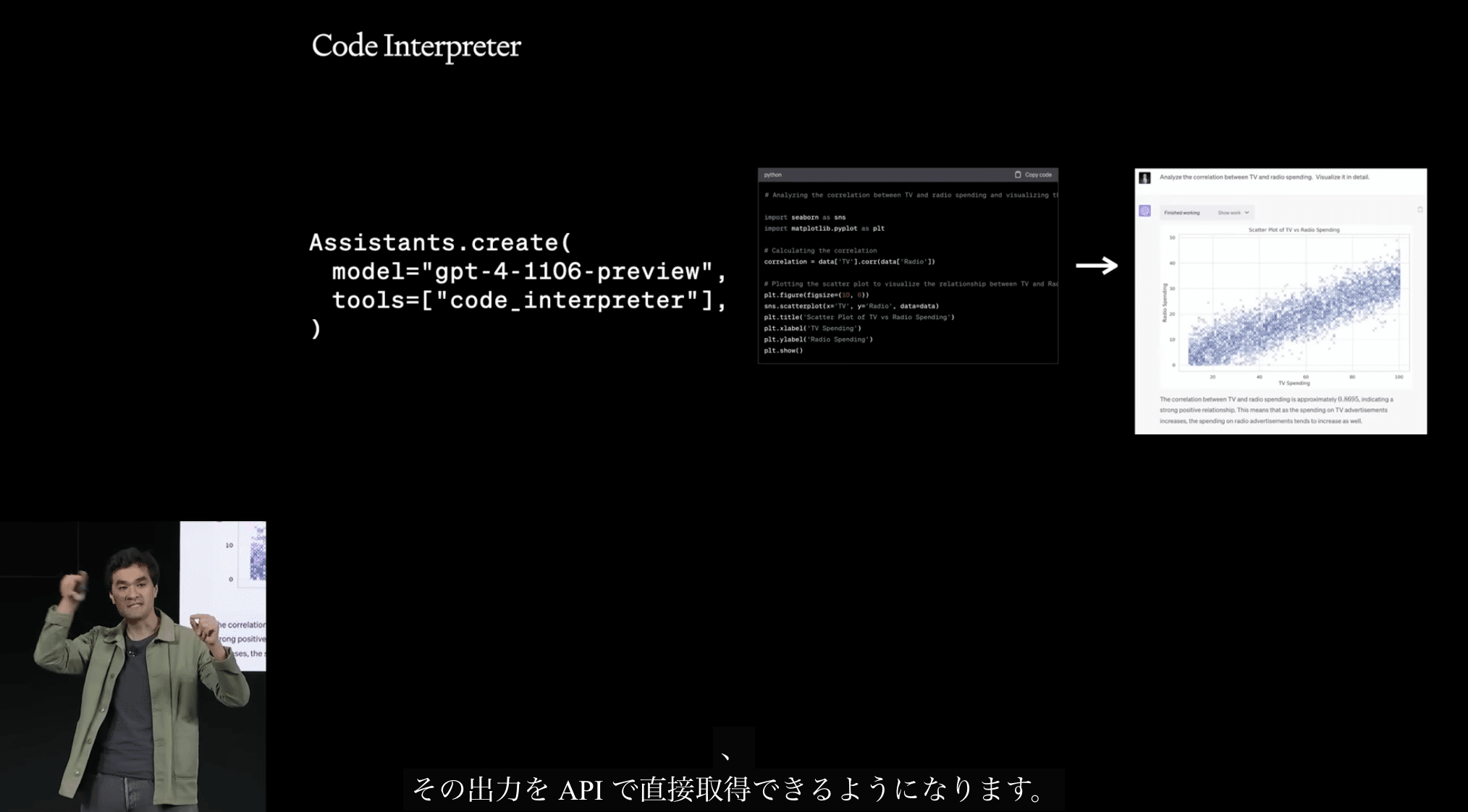

コードインタープリター

コードインタープリターを利用することで、AIは安全な環境でコードを書いたり実行したりできます。その出力はAPIで直接取得可能です。

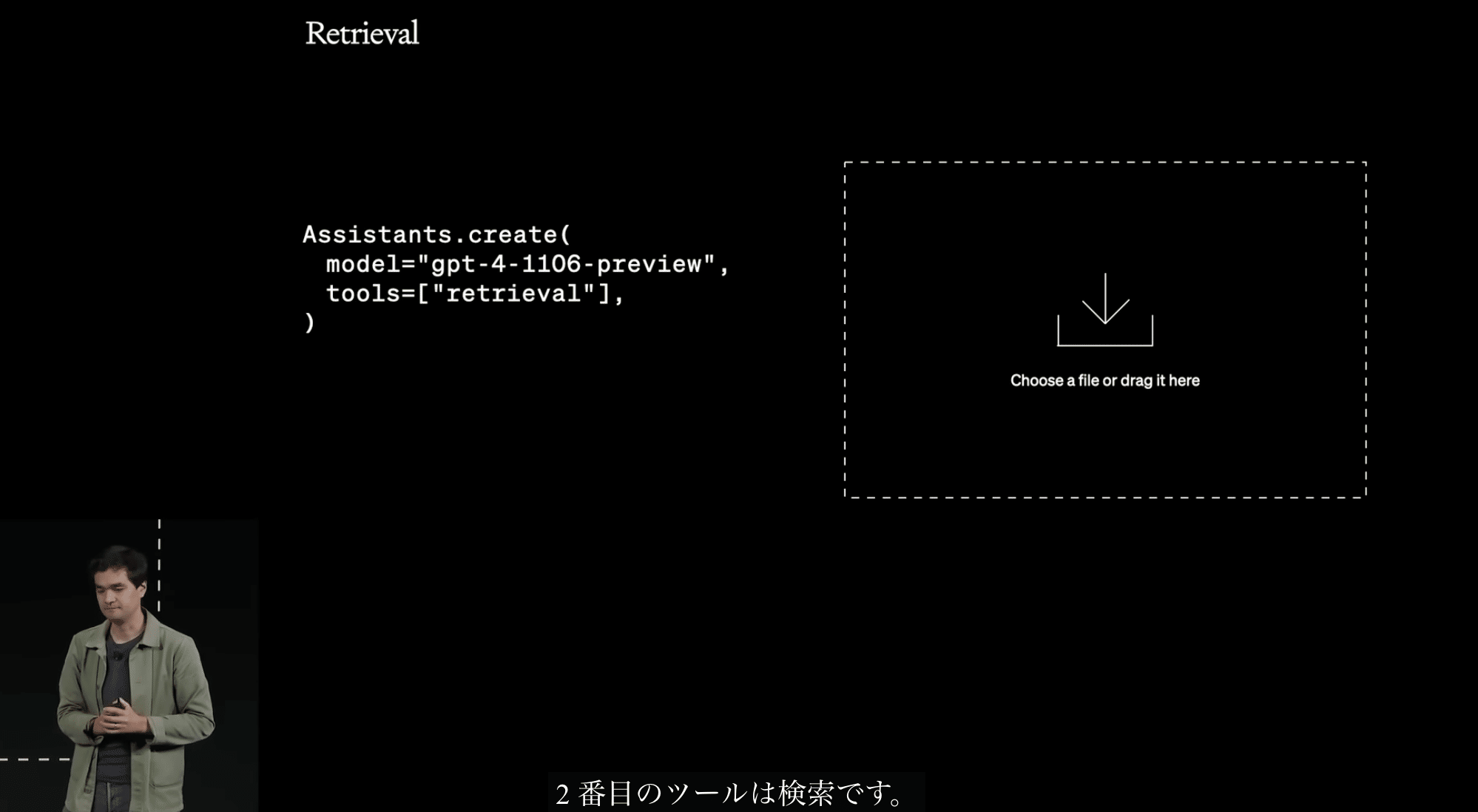

知識取得(Retrieval)

アシスタントAPIのもう一つのツールは、検索です。この機能により、AIは基本的な知識に外部情報を加えることができ、それをもとに応答することができます。ショッピングアプリのための製品情報の統合から、研究ツールのための特定文書を埋め込むことまで、知識取得はより情報豊富で文脈に即したAIアシスタントを可能にします。

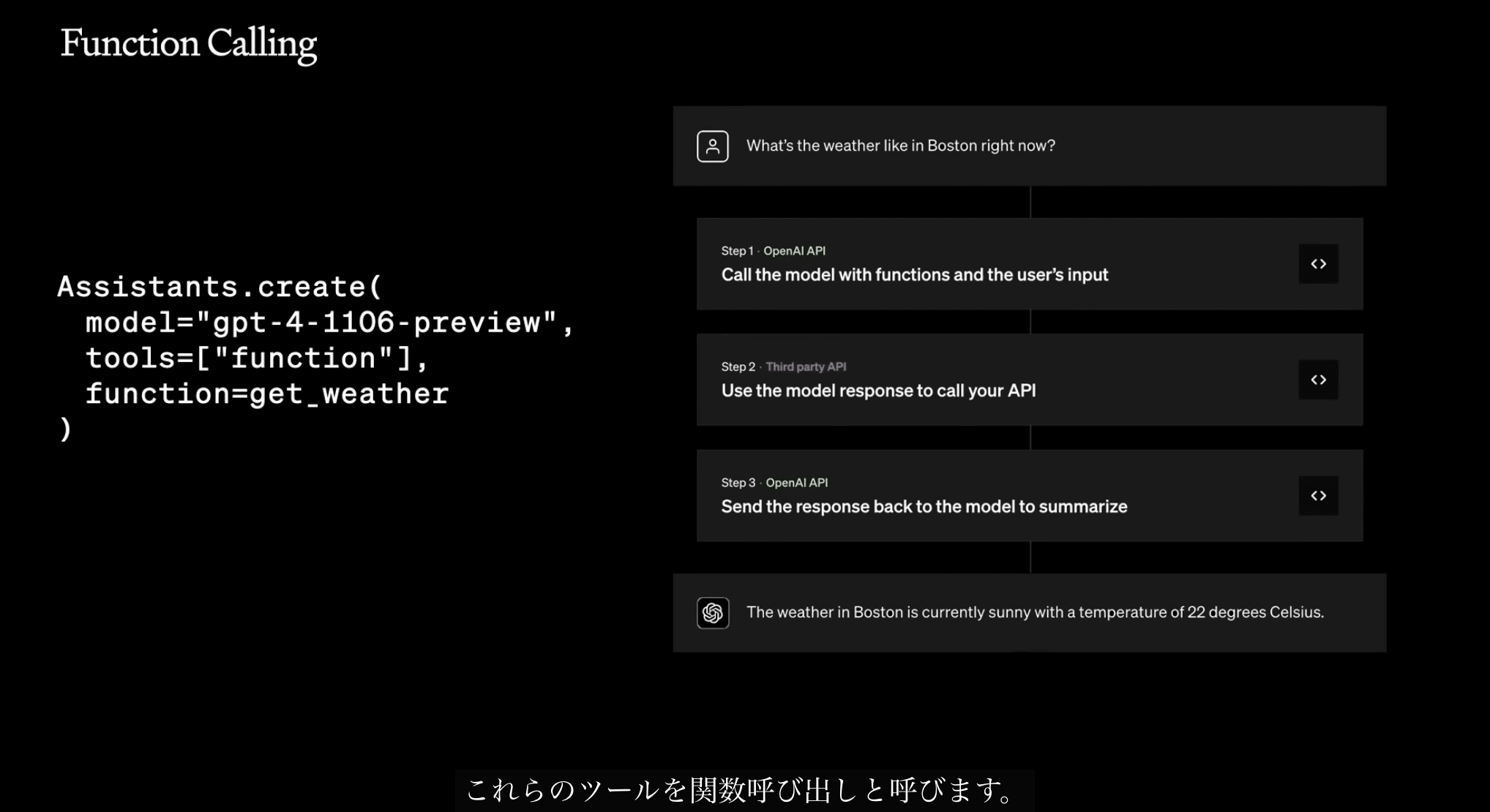

関数呼び出し(Function Calling)

次に関数呼び出し(Function Calling)が紹介されました。関数呼び出しにより、AIは外部システムと対話し、ユーザーのプロンプトに基づく関数を実行します。JSONモードはAIの出力をJSON形式で保証し、他のシステムとの統合を容易にします。並列関数呼び出しにより、AIは複数の関数を同時に実行でき、効率と応答性を高めます。

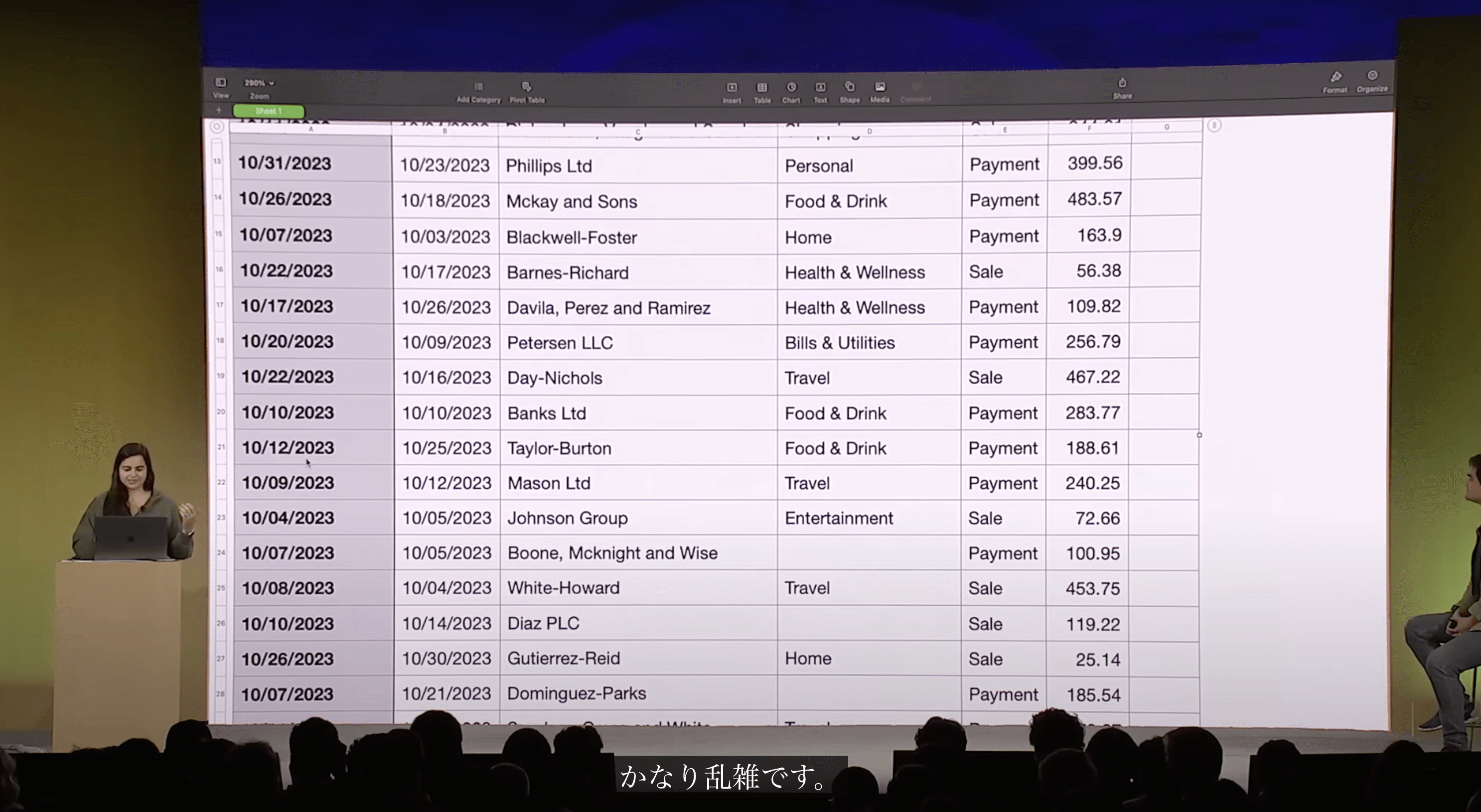

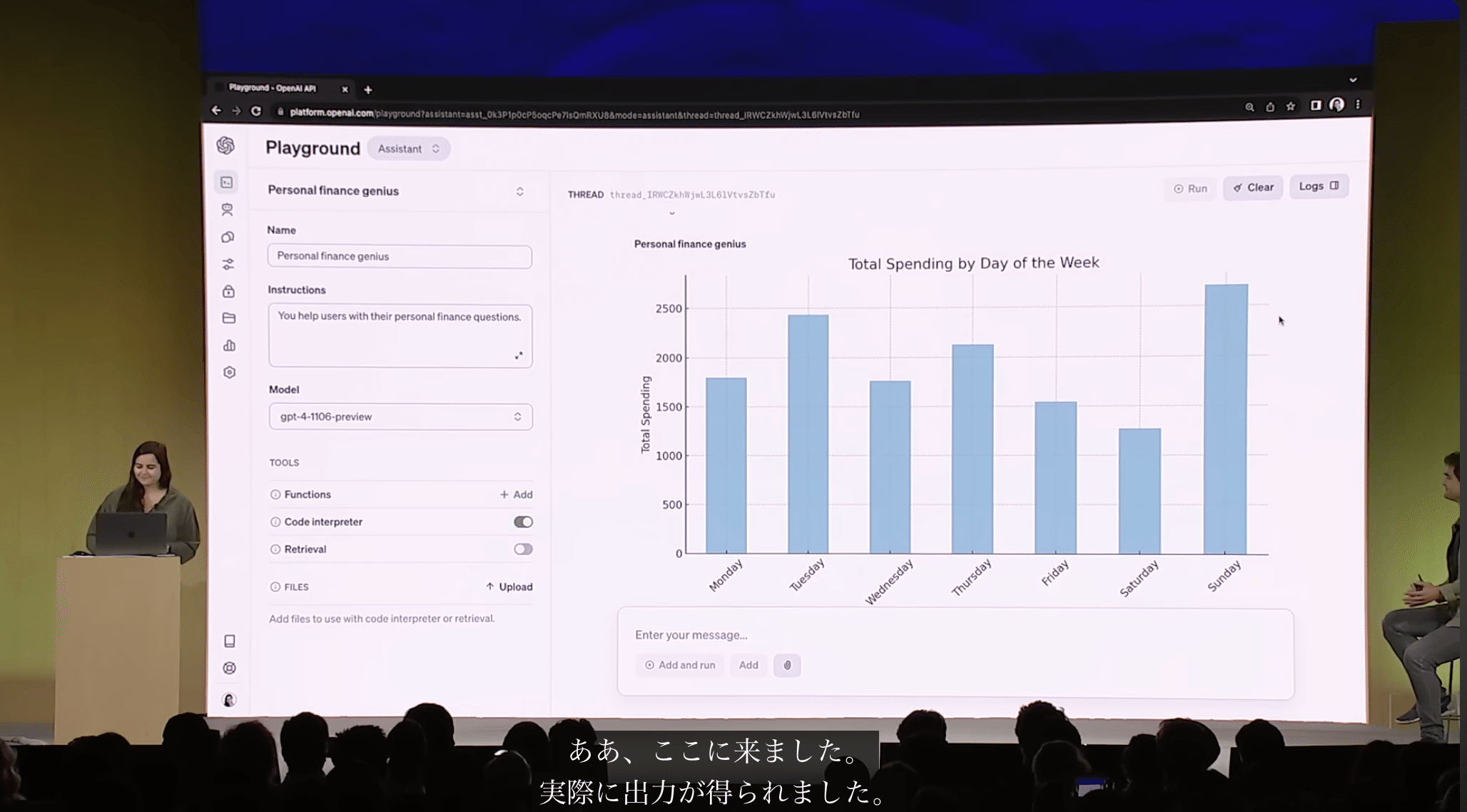

実際のデモ

デモでは、アシスタントに財務表をアップロードし、それをチャートに変換しました。アシスタントはコードインタープリターを使い、アップロードされたファイルを基にチャートを作成しました。

Assistant APIのドキュメントを読み込ませて、Assistant APIについて何でも質問できるGPTはこちら↓↓↓

https://twitter.com/ctgptlb/status/1723202400310509763?s=20

いかがだったでしょうか?

OpenAI DevDayの当日行われた別の4つのセッションの様子も順次解説していきます。

今後も発信していきますので、noteアカウント と、Twitterのフォローで応援よろしくお願いします。

https://agi-labo.com/articles/n0554df7f1b80

https://agi-labo.com/articles/n714ce891969d