要点

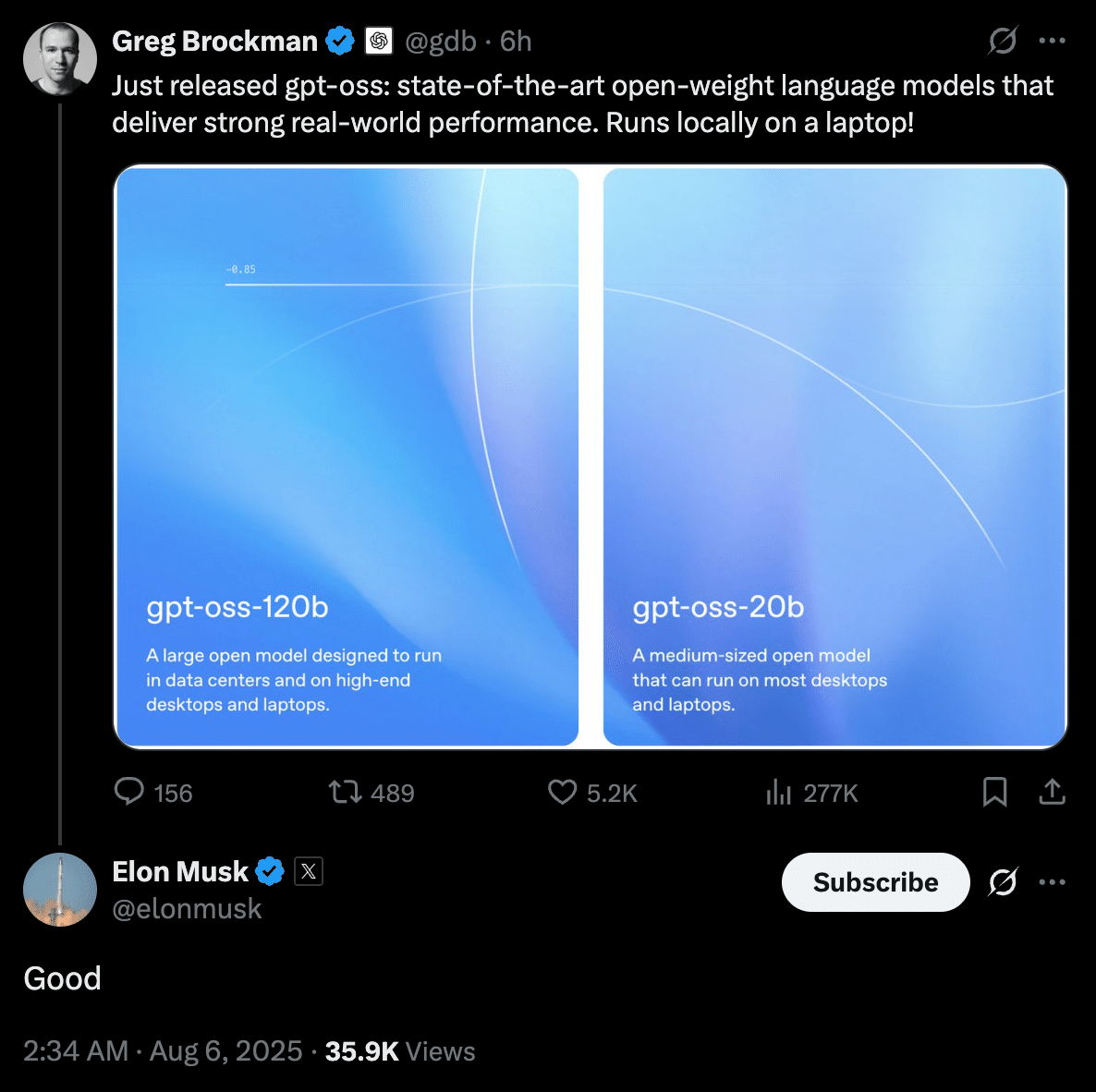

OpenAI、新オープンウェイトモデル「gpt-oss」を発表。120bと20bの2サイズ。

性能はo4-miniに匹敵。20bは個人PCでも動作。

Apache 2.0ライセンスで商用利用も自由。

Web検索やPython実行など、強力なエージェント機能も搭載。

概要

OpenAIが2025年8月6日、新たなオープンウェイトモデル「gpt-oss」をリリースしました。

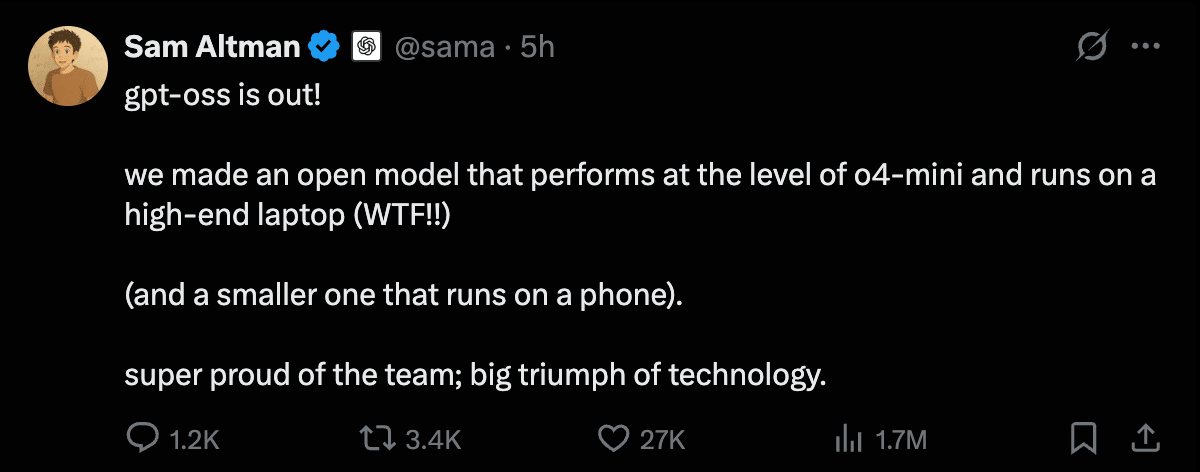

CEOのサム・アルトマンは自身のXで「o4-miniレベルの性能で、ハイエンドなラップトップで動く(WTF!!)」と発表。

GPT-2以来となるオープンウェイトモデルの公開は、AI業界に大きな衝撃を与えています。

gpt-ossの強み

ローカル実行: gpt-oss-20bは普通のPCで動作。プライバシーも安心。

エージェント機能: Web検索やコーディングを自律的に実行。

自由な改変・商用利用: Apache 2.0ライセンスで、誰もが自由にカスタマイズや製品組込みを行える。

思考プロセスの透明性: Chain-of-Thoughtを完全公開。AIの判断根拠が追えるため、デバッグも容易に。

なぜ今、オープンモデルなのか?

今回の発表の背景には、激化する市場競争と、透明性を求める声という2つの側面がありそうです。

一つは、MetaのLlamaシリーズやDeepSeek, Alibabaをはじめとする高性能オープンソースモデルとの競争です。

そしてもう一つは、設立当初の理念に反して「ClosedAI」と揶揄されることもあった同社が、原点に立ち返り、開発の透明性を示すことで市場の期待に応える狙いもあると考えられます。

ちなみに今回の発表には、そのイーロンも「Good」とリプ。肯定的な反応を見せてます。

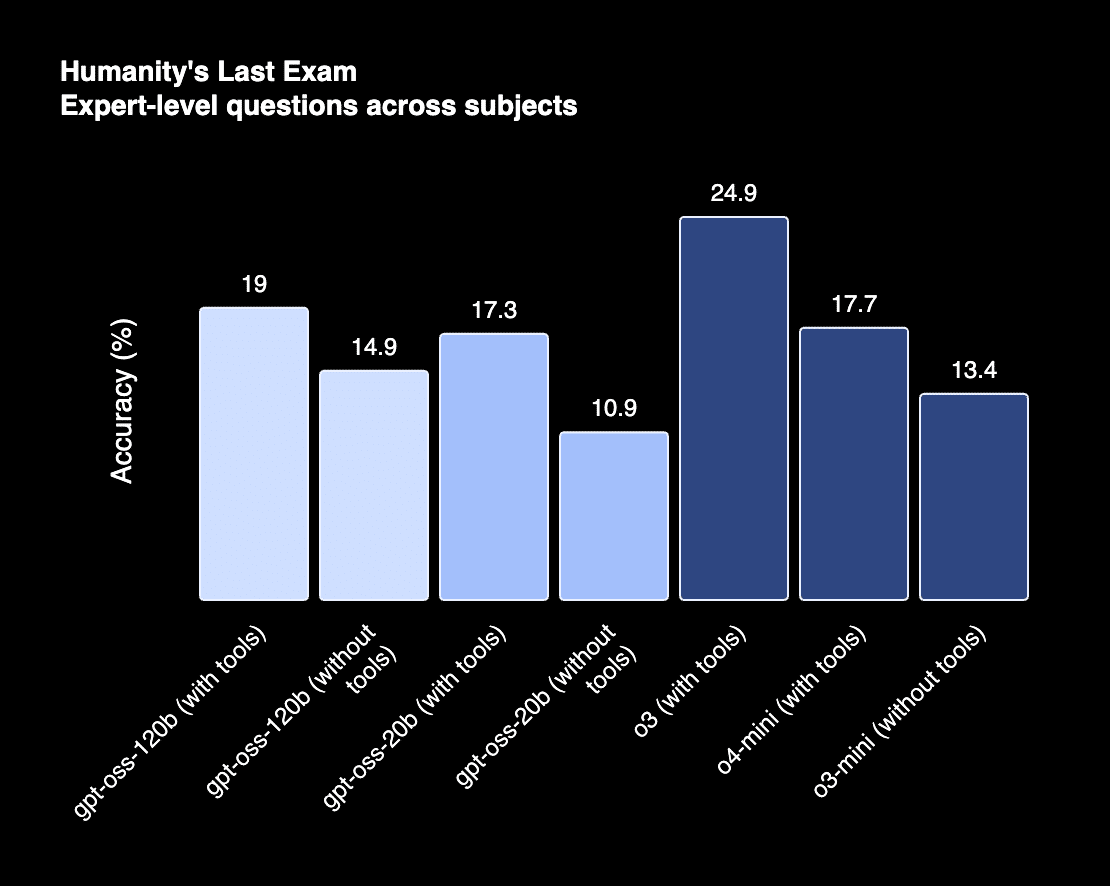

ベンチマーク性能:o3に匹敵、項目によっては凌駕

gpt-ossは各種ベンチマークで高いスコアを記録。特にgpt-oss-120bは、多くの項目でクローズドモデルに匹敵、あるいはそれを凌駕する結果を示しています。

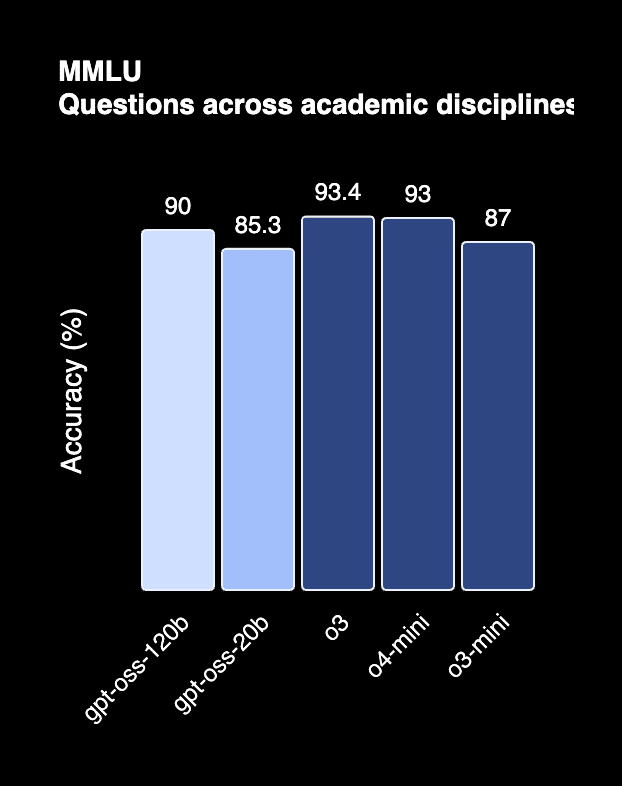

MMLU

一般的な学術知識を問うベンチマーク。gpt-oss-120bは90.0%を記録し、o4-mini (93.0%)に迫る性能です。

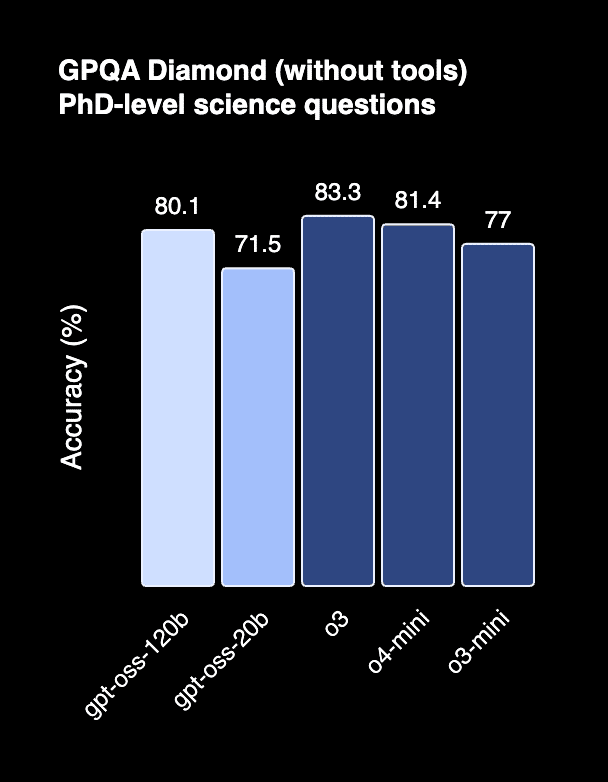

GPQA Diamond

博士レベルの科学的問題を評価。gpt-oss-120bは80.1%で、o4-mini (81.4%)に匹敵します。

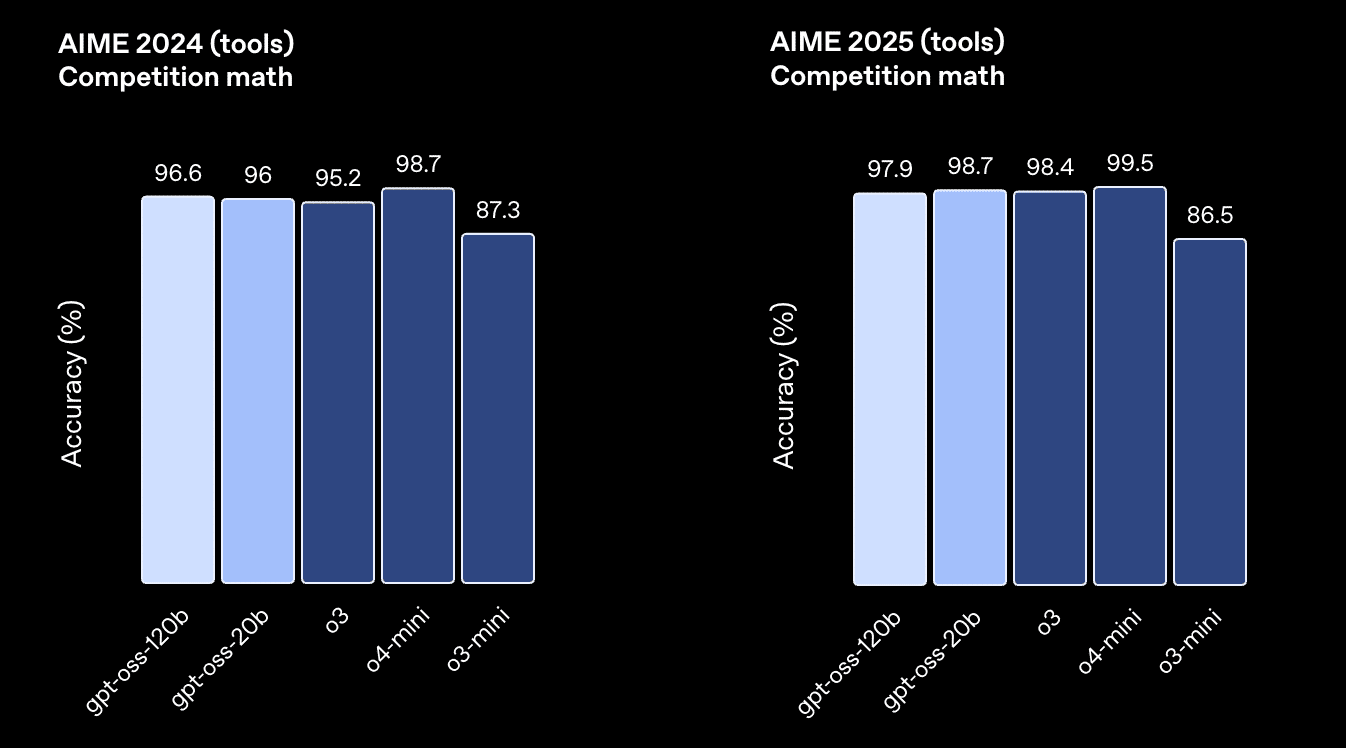

AIME

アメリカの数学コンテスト。gpt-oss-20bは2025年の問題でo3を上回る98.7%を記録しました。

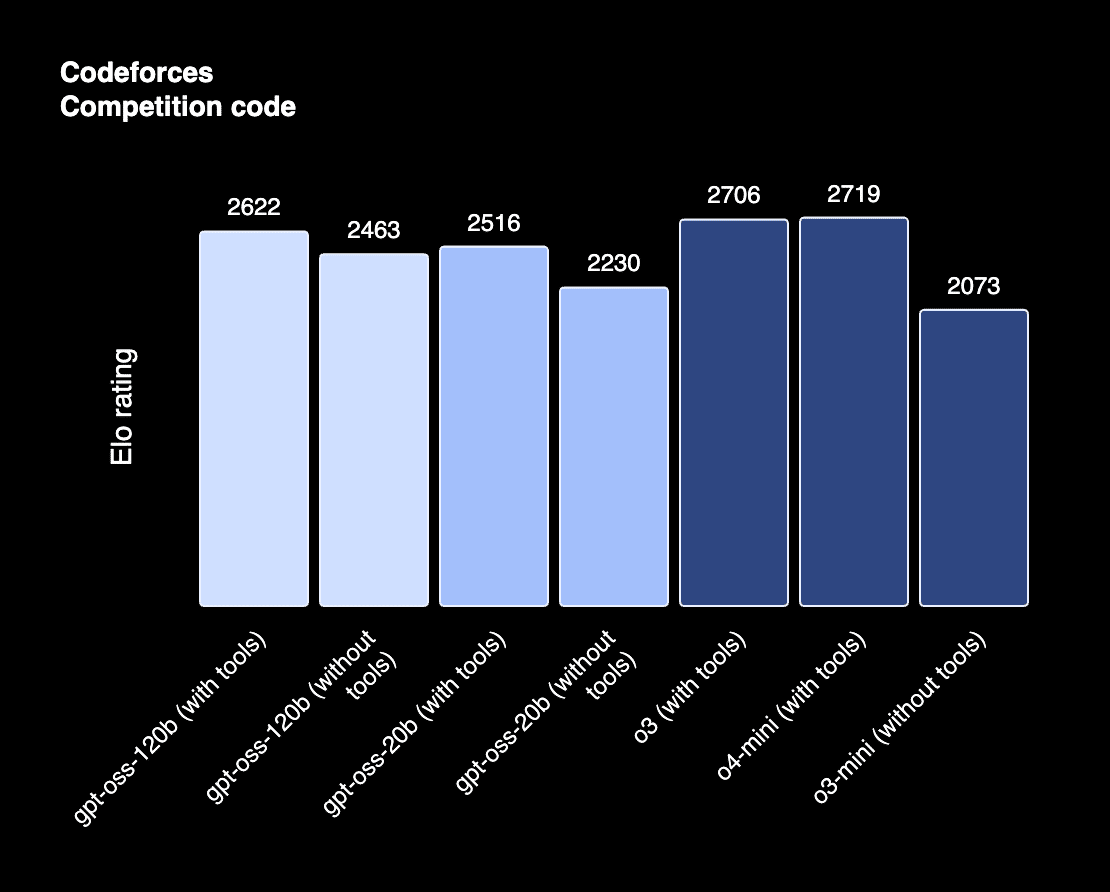

Codeforces

競技プログラミングの能力評価。gpt-oss-120bはEloレーティング2622を記録。

Humanity's Last Exam

多分野にわたる専門家レベルの質問。gpt-oss-120bは19%を記録し、o4-mini (17.7%)を上回りました。

安全性への取り組み

OpenAIは、リリースにあたり徹底した安全性評価を実施したと強調。また、モデルの安全性担保とエコシステム構築に向け2つの大規模イベントを発表しています。

① 賞金50万ドル、脆弱性発見コンテスト

まず、Kaggle上で賞金総額50万ドルをかけた「Red Teaming Challenge」を開催。世界中の研究者や開発者に`gpt-oss-20b`の脆弱性を探してもらい、オープンウェイトモデルの安全性向上に繋げる狙いです。審査員にはAnthropicや英国AI安全研究所のエキスパートも名を連ねています。

https://www.kaggle.com/competitions/openai-gpt-oss-20b-red-teaming/

② パートナー企業と開発ハッカソン

Hugging Face、NVIDIA、Ollamaといった主要パートナーと共に、6週間にわたる大規模な開発ハッカソンも同時に発表されました。ロボティクスからオフラインで動作するローカルエージェントまで、幅広いテーマで創造的なアプリケーションを募集。NVIDIA製の最新GPUなどが賞品として用意されています。

両方ともオンライン参加可能です。興味がある方はぜひチェックしてみてください!

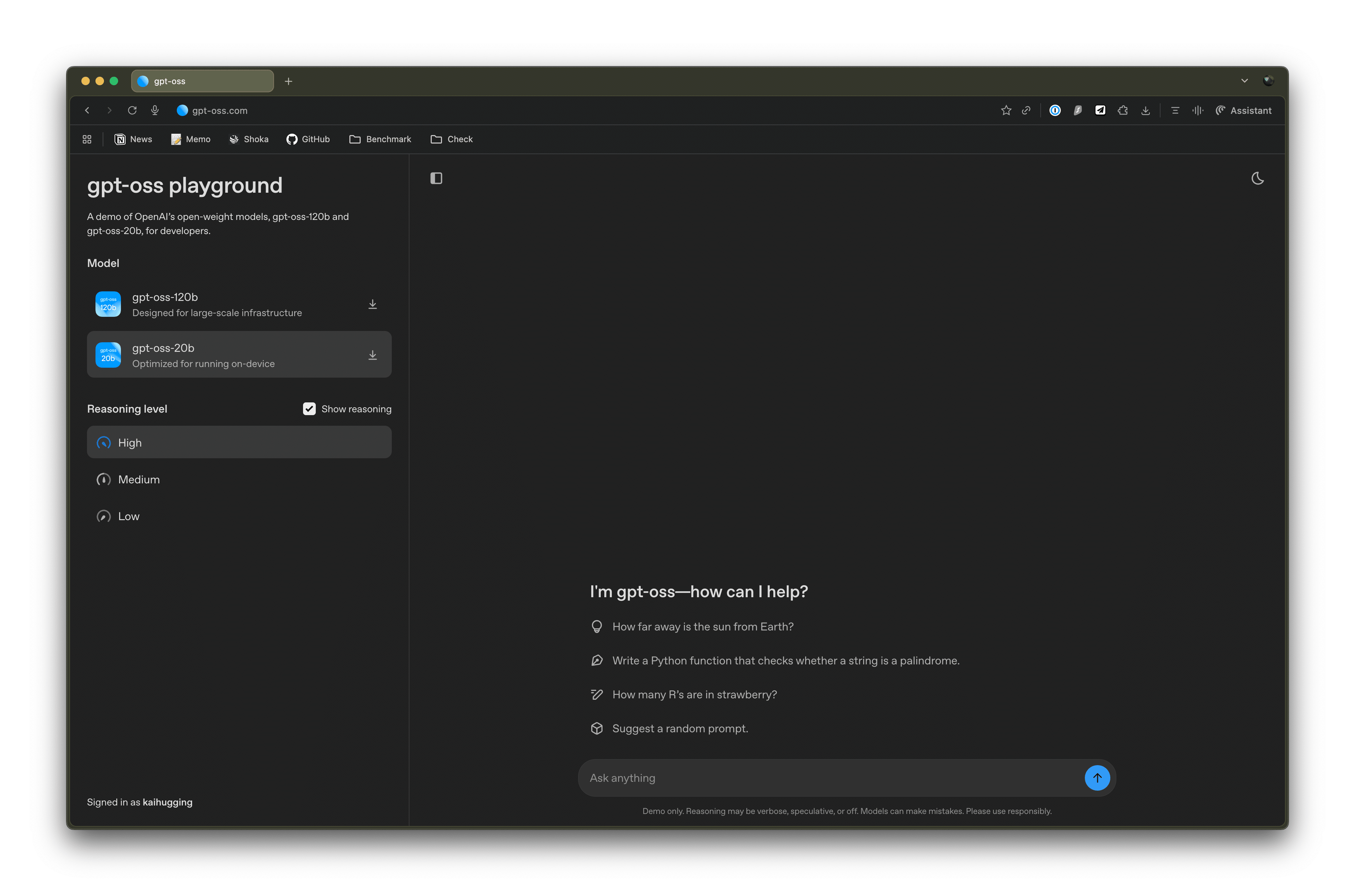

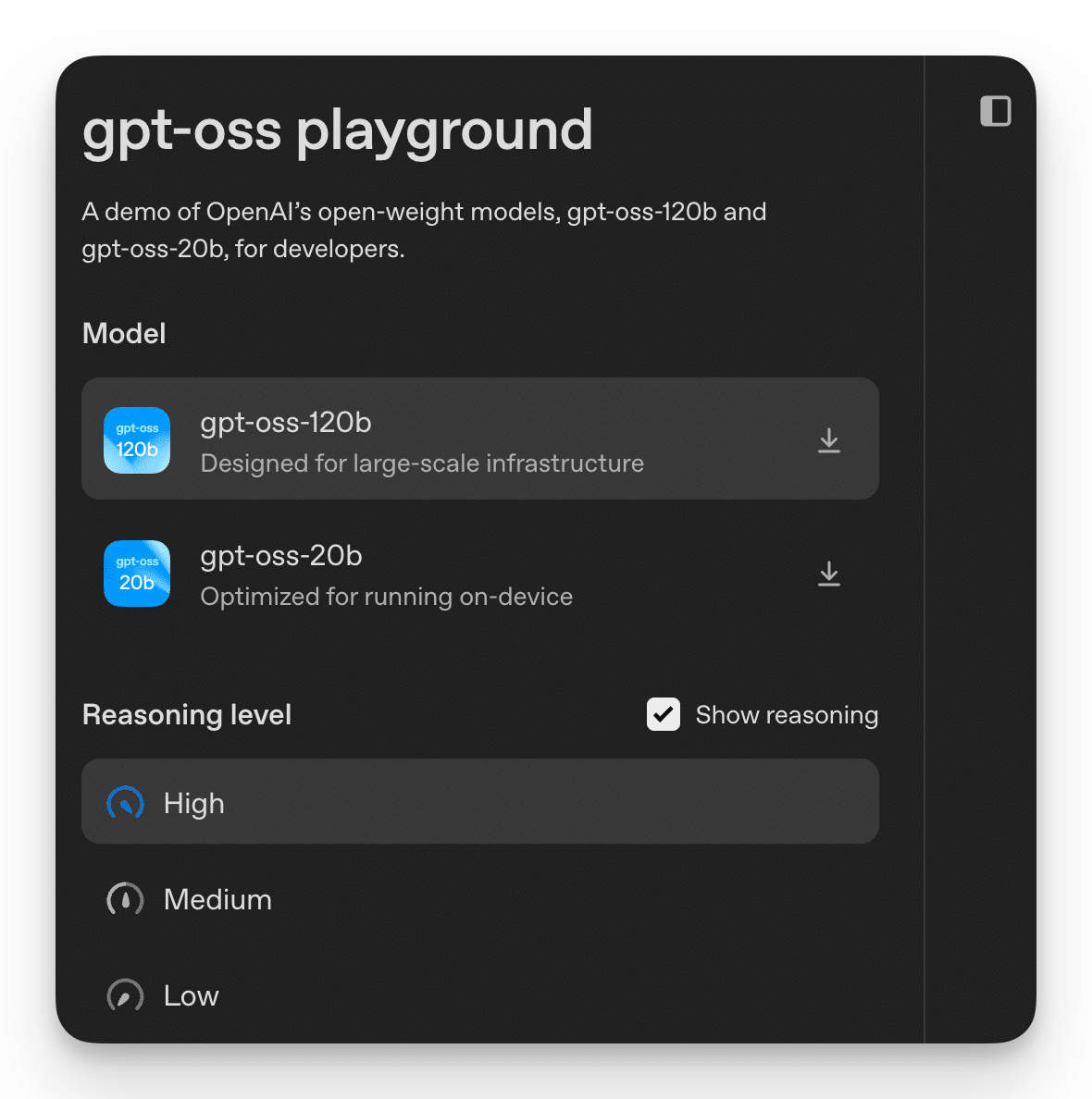

公式デモサイトで試す

モデルをすぐに試したい方は、OpenAIが用意した公式のデモサイトがおすすめです。

Hugging Faceアカウントでログインすれば、ブラウザ上で`gpt-oss`とチャットできます。

サイトの左側で`gpt-oss-120b`と`gpt-oss-20b`のモデル切り替えや、推論レベル(Reasoning level)の調整も可能です。

ローカルでも試してみた

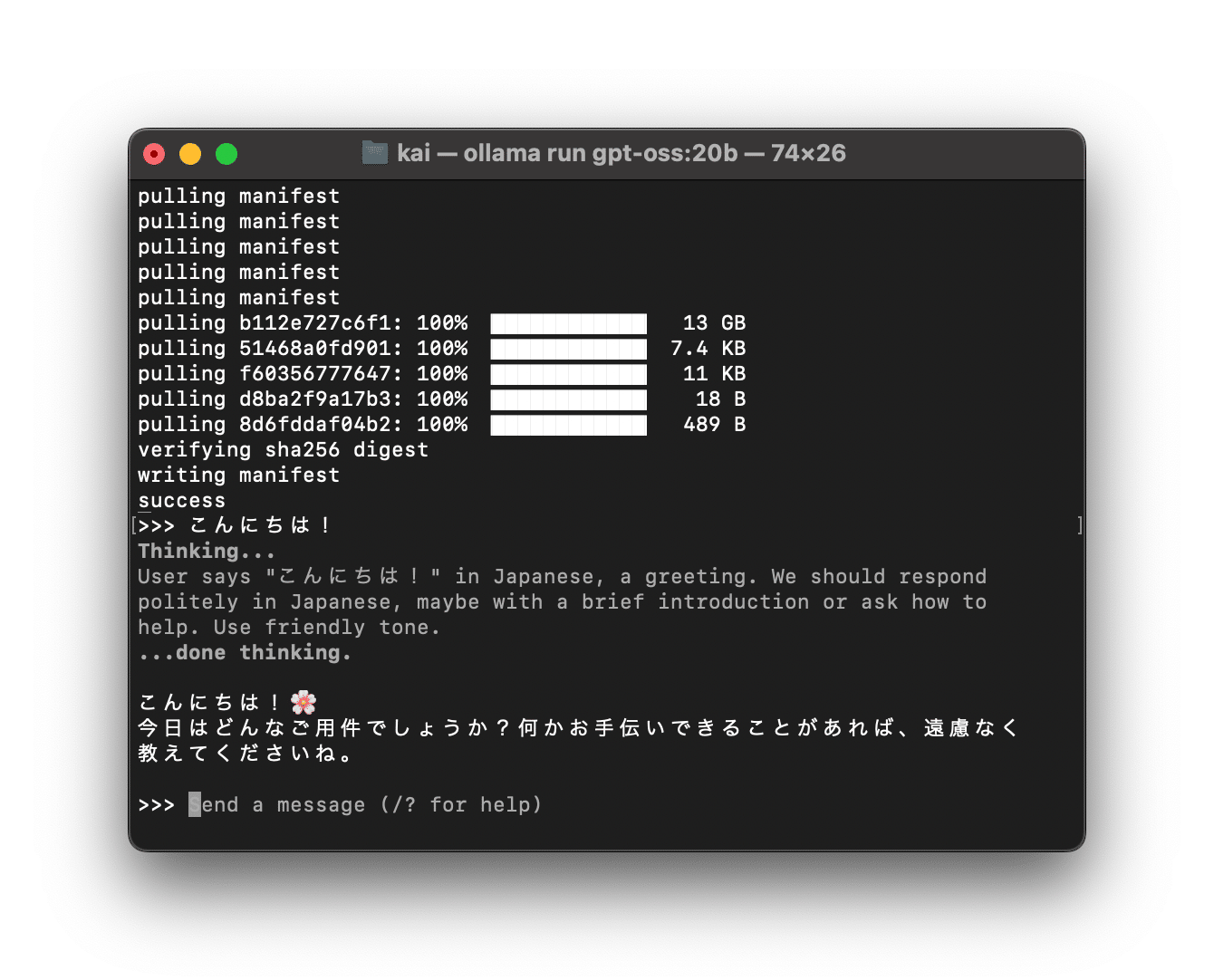

ローカル環境で試したい方は、最近新しく登場したOllamaアプリを使って簡単に`gpt-oss`を試せます。

公式サイトからOllamaをインストールし、ターミナルで下記コマンドを実行するだけ。

ollama pull gpt-oss:20b

ollama run gpt-oss:20b>>> Send a message (/? for help) と表示されれば準備完了です。

筆者の環境(MacBook Pro, Memory 48 GB, Apple M4 Max)でも、gpt-oss-20bは非常に快適に動作しました。

以下の動画は等倍速です。これくらいのスピードで回答してくれます。

まとめ

満を持して発表されたOpenAIの「gpt-oss」は、市場の期待を裏切らない高性能なオープンウェイトモデルでした。特に、ローカル環境で実行できる点は、セキュリティを重視する多くの日本企業にとって、導入を検討する大きな追い風となるでしょう。

Hugging Face、Microsoft、NVIDIAなど多くのパートナーも既に対応を表明しており、エコシステムの拡大は確実です。

さらに、サム・アルトマンCEOは今週後半に「GPT-5」と目される更なる発表を控えていると示唆しており、今回のリリースは、来るべきAIの新しい波に向けた序章に過ぎないのかもしれません。OpenAIの次の一手から、ますます目が離せなくなりました。

ローカルLLMを動かすにはLM Studioもおすすめです

https://agi-labo.com/articles/n1f74453cd24c

公式リソース

GitHub: openai/gpt-oss

Hugging Face: gpt-oss-120b / gpt-oss-20b

デモサイト: gpt-oss.com